以下講一些有關stable diffusion webui的幾個小操作,都不難,也都很實用,也許其實你早就知道了,這些都不是什麼驚奇的事,但我發現似乎並不是所有人都知道這些事。

這些真的都是一些雞毛蒜皮的小事,不足以獨立寫成一篇教學文章,所以我就簡單的匯整一下就好。(冷知識通常是指聽到會覺得新奇但不太有用處的偏門知識,所以我講的這些應該要說是暖知識才對。)

1.自動抓SDW圖片檔的prompt

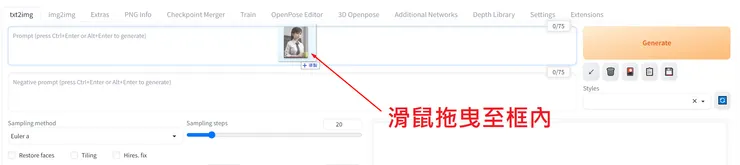

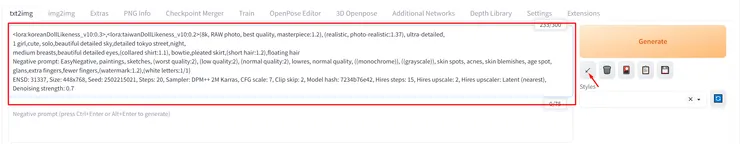

當你用了一些特定的prompt產出一些好圖後,你會特地把那些prompt存成文字紀錄下來嗎?或是用使用SDW內建的PNG Info功能去抽取圖片的prompt內容?

其實只要把圖片檔用滑鼠拖曳到prompt框後就會自動還原出所有繪圖設定。

再點擊右側的箭頭按鈕即會自動發配所有設定值,不只是prompt,連細部設定都自動配好了。

2.自動抓civitai網站中的圖片prompt

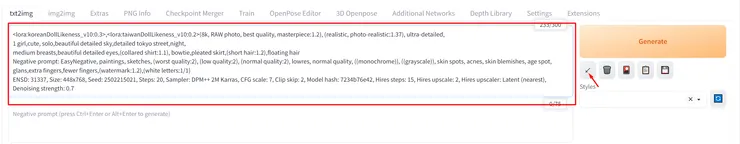

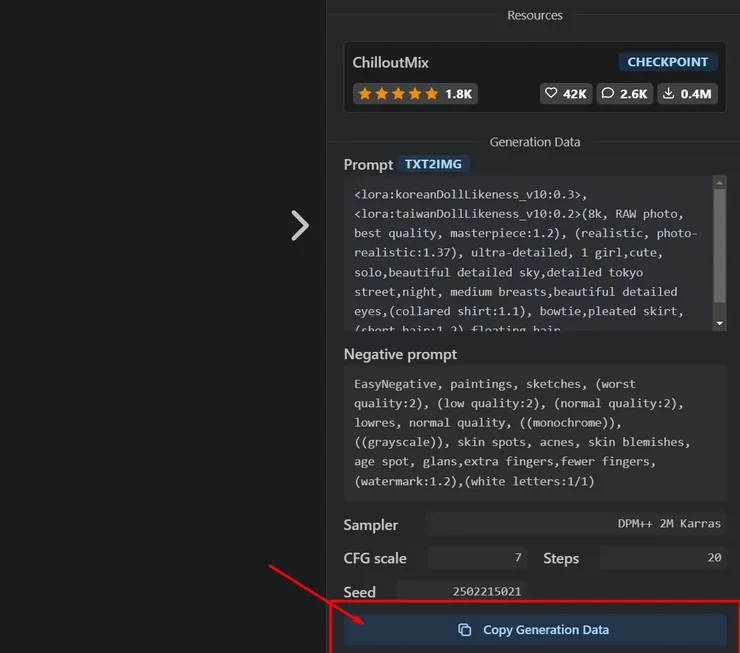

在civitai網站中,網友分享的出圖設定,我看有些人都是自己一段一段複製貼上,其實只要點擊這個按鈕即可複製所有繪圖設定。

與第一項內容雷同,接著只要把內容貼到SDW的prompt框後再點擊右側的箭頭按鈕即會自動發配所有設定值,不只是prompt,連細部設定都自動配好了。

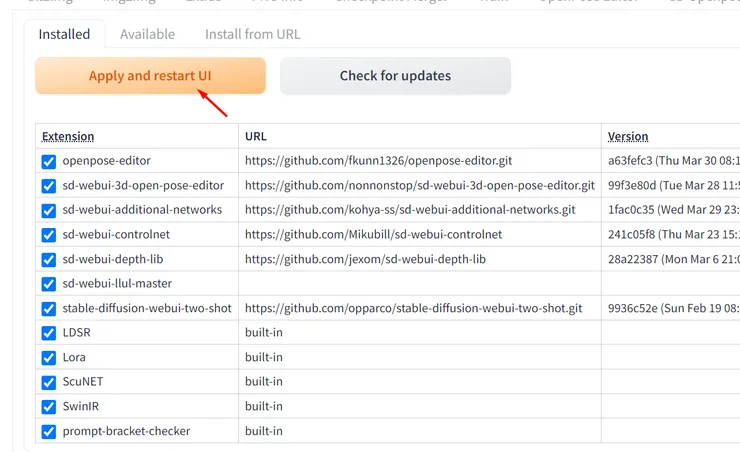

3.移除沒用的外掛(extensions)

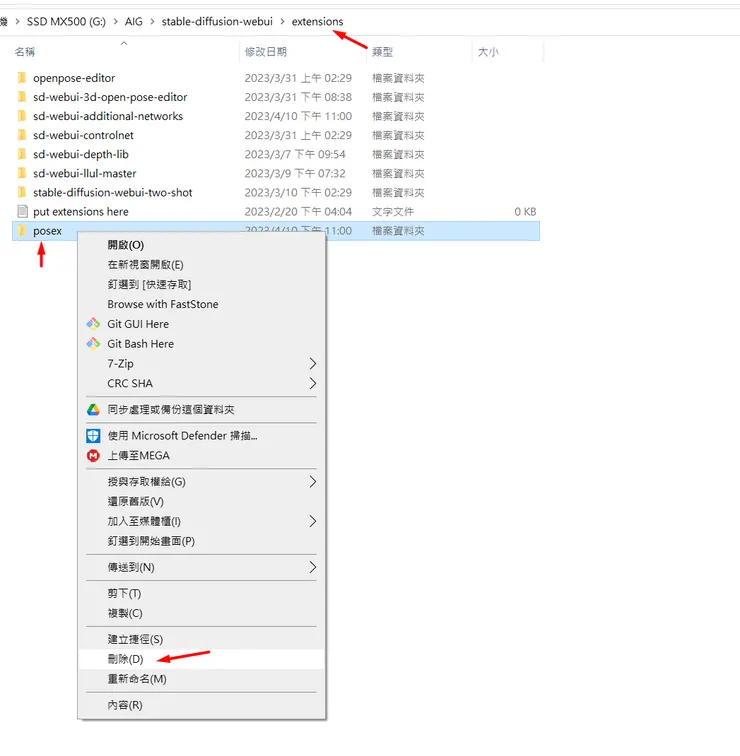

之前是不是一時手癢已經裝了很多廢外掛?想要移除?

移除方法其實很簡單,只是大多數的人都將錯就錯懶得移了。

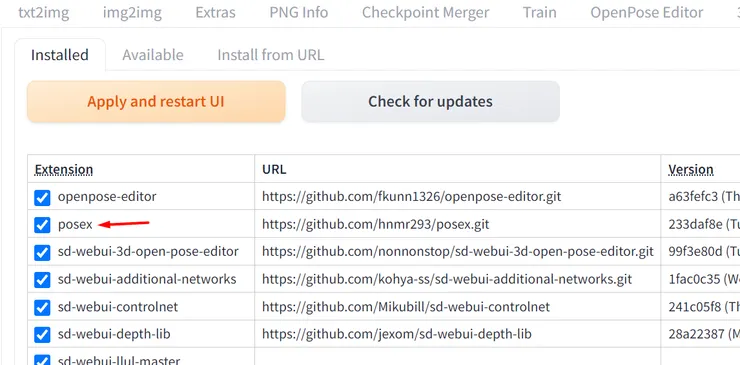

例如我想移除posex這個外掛的話:

只要直接到SDW安裝資料夾\extensions之下刪除你不想要的那個外掛資料夾就好:

然後再回到外掛清單,點擊Apply and restart UI按鈕或是直接重啟整個SDW即可,這樣被刪掉的外掛就會消失了:

4.簡易的繪圖加速方法(xformers)

只要在SDW執行前先啟用xformers就可以加快繪圖速度,聽說不太有負面影響,是個簡單輕鬆零成本的的加速法,也有降低顯卡記憶體(VRAM)耗用的好處。

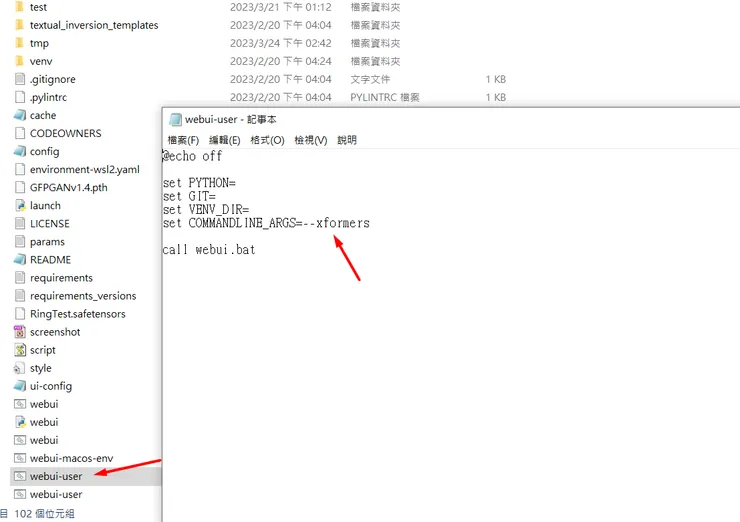

具體方法是把SDW資料夾下的webui-user.bat這個執行檔用文字開啟,然後在COMMANDLINE_ARGS=的後面加上—xformers即可:

我簡單的測試一下,繪製512*768的圖,採樣方式刻意選最慢的DPM adaptive,step設25步。

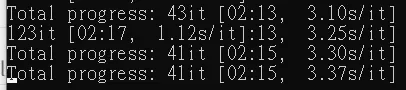

無開啟xformers的情況下,畫了兩次分別是133秒與135秒:

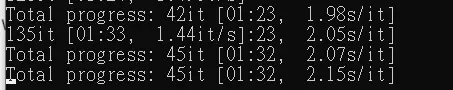

有開啟xformers的情況下,畫了兩次分別是83秒與92秒:

據其它網友的測試,比較弱的顯卡進步幅度會較明顯,若顯卡本來就不錯則差異不會太大,但有開就有差。

5.把單機版SDW分享給朋友一起用

想要把你辛苦建立好的電腦版SDW分享給外面的朋友同樂,或是想從自己的手機躺著輕鬆玩嗎?

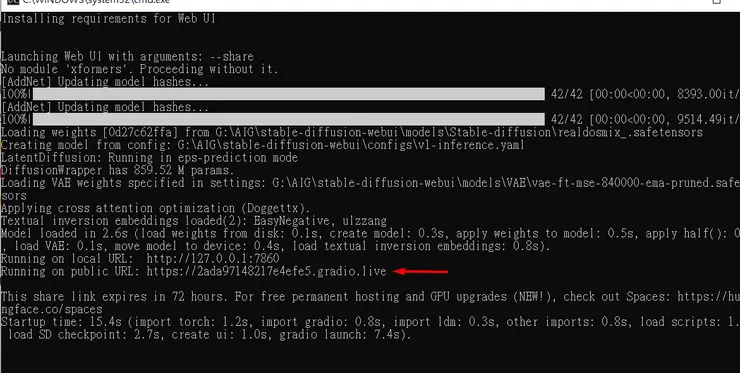

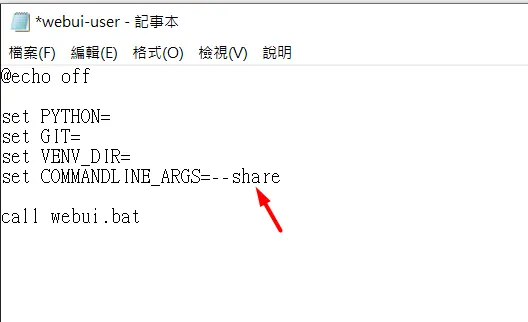

不需要辛苦的自己架網站,只要在webui-user.bat的執行參數加上—share即可,加入方法與第四項提到的方法一樣:

然後啟動SDW後,在指令介面它會給你一組gradio.live結尾的超長亂碼網址,其它人使用這串網址便可以從其它電腦或是手機來連線到你的SDW介面一起畫圖。這組網址的最長時效是72小時。

如果是多人一起畫的情況下,就會有排隊現象,一張畫好才會再接著畫下一張。