我們在「【MLOps - MLflow】AI模型實驗管理的超入門簡介」有介紹到模型實驗的追蹤管理平台, 雖然可以幫助我們自動化記錄實驗參數、模型…等數據, 但我們也會希望模型的訓練可以更加的自動化, 而Airflow正好就具備流程設計與管理的功能, 我們可以彈性的設計在某個時間點從某個數據集自動訓練一個模型, 這正是讓我們的模型生產工業化的重要工具之一。

付費限定

【🔒 MLOps - Airflow】工作流自動化平台的超入門簡介

更新 發佈閱讀 5 分鐘

以行動支持創作者!付費即可解鎖

本篇內容共 1810 字、0

則留言,僅發佈於🔒 阿Han的軟體心法實戰營你目前無法檢視以下內容,可能因為尚未登入,或沒有該房間的查看權限。

留言

阿Han的沙龍

162會員

332內容數

哈囉,我是阿Han,是一位 👩💻 軟體研發工程師,喜歡閱讀、學習、撰寫文章及教學,擅長以圖代文,化繁為簡,除了幫助自己釐清思路之外,也希望藉由圖解的方式幫助大家共同學習,甚至手把手帶您設計出高品質的軟體產品。

阿Han的沙龍的其他內容

2024/12/11

我們在「【🔒 MLOps - Airflow】使用docker compose架設Airflow」教您如何使用docker compose架設一個Airflow環境, 接著我們要教您如何進到容器內開發DAG, 正所謂工欲善其事必先利其器, 就是要先把事前先把工具給整治好, 讓後續的作業順利進行,

2024/12/11

我們在「【🔒 MLOps - Airflow】使用docker compose架設Airflow」教您如何使用docker compose架設一個Airflow環境, 接著我們要教您如何進到容器內開發DAG, 正所謂工欲善其事必先利其器, 就是要先把事前先把工具給整治好, 讓後續的作業順利進行,

2024/11/13

我們在「【🔒 MLOps - Airflow】使用docker compose架設Airflow」有教您如何使用Docker來架設Airflow的環境, 而這個章節我們準備在DAG的流程中設計一個呼叫Docker去執行作業的節點, 這對於我們容器化的工作流會非常有幫助, 而且運行過程中也減少對主機

2024/11/13

我們在「【🔒 MLOps - Airflow】使用docker compose架設Airflow」有教您如何使用Docker來架設Airflow的環境, 而這個章節我們準備在DAG的流程中設計一個呼叫Docker去執行作業的節點, 這對於我們容器化的工作流會非常有幫助, 而且運行過程中也減少對主機

2024/10/30

為什麼我們只推薦docker的環境? 因為透過容器化可以讓我們各個組件安裝的套件各自獨立, 不會發生早期常常衝突的狀況, 當然我們也可以用conda來隔開, 但它的層面僅限於python環境, 我們需要的是整個os環境, 因此docker會是我們優先考慮的選項之一。

👉 在我們開始之前…

2024/10/30

為什麼我們只推薦docker的環境? 因為透過容器化可以讓我們各個組件安裝的套件各自獨立, 不會發生早期常常衝突的狀況, 當然我們也可以用conda來隔開, 但它的層面僅限於python環境, 我們需要的是整個os環境, 因此docker會是我們優先考慮的選項之一。

👉 在我們開始之前…

你可能也想看

這是一場修復文化與重建精神的儀式,觀眾不需要完全看懂《遊林驚夢:巧遇Hagay》,但你能感受心與土地團聚的渴望,也不急著在此處釐清或定義什麼,但你的在場感受,就是一條線索,關於如何找著自己的路徑、自己的聲音。

這是一場修復文化與重建精神的儀式,觀眾不需要完全看懂《遊林驚夢:巧遇Hagay》,但你能感受心與土地團聚的渴望,也不急著在此處釐清或定義什麼,但你的在場感受,就是一條線索,關於如何找著自己的路徑、自己的聲音。

我想要一天分享一點「LLM從底層堆疊的技術」,並且每篇文章長度控制在三分鐘以內,讓大家不會壓力太大,但是又能夠每天成長一點。

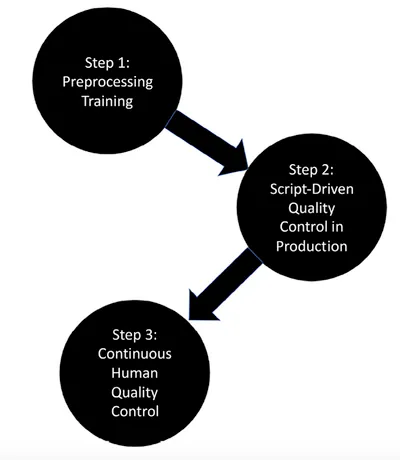

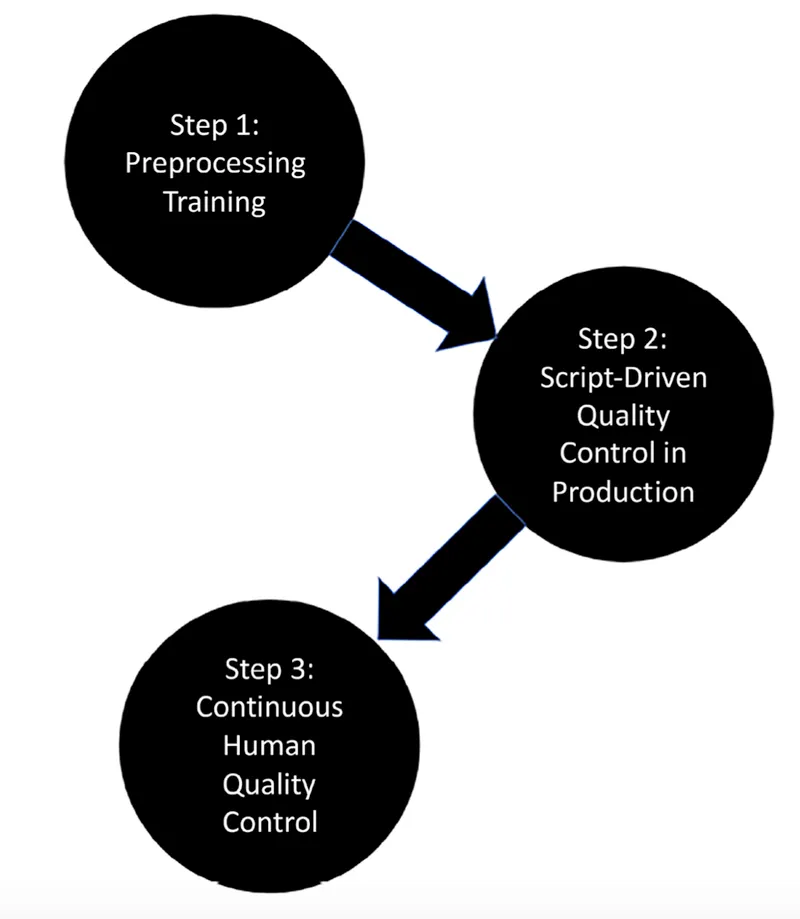

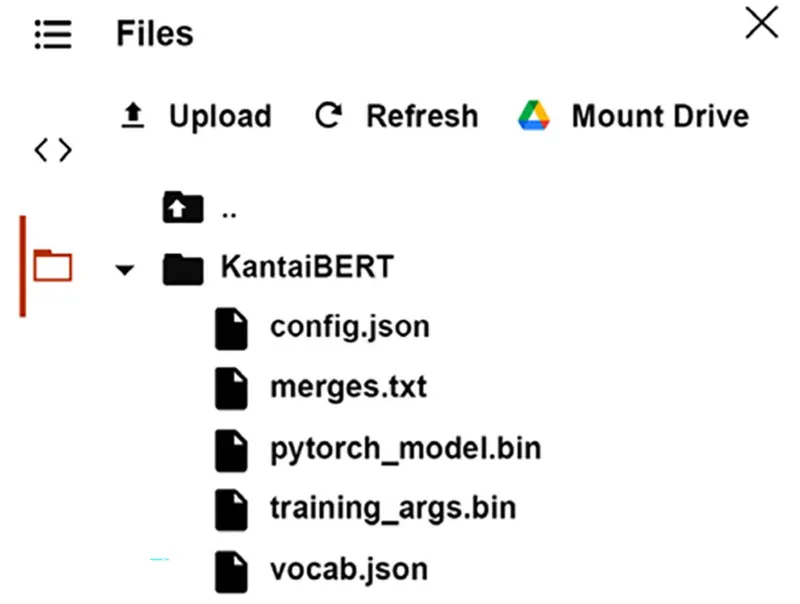

Transformers 將逐漸接管大多數複雜的自然語言處理任務,然而,人類的干預仍然是必不可少的,正確的方法是訓練一個 Transformers,實現它,控制輸出,並

我想要一天分享一點「LLM從底層堆疊的技術」,並且每篇文章長度控制在三分鐘以內,讓大家不會壓力太大,但是又能夠每天成長一點。

Transformers 將逐漸接管大多數複雜的自然語言處理任務,然而,人類的干預仍然是必不可少的,正確的方法是訓練一個 Transformers,實現它,控制輸出,並

背景:從冷門配角到市場主線,算力與電力被重新定價

小P從2008進入股市,每一個時期的投資亮點都不同,記得2009蘋果手機剛上市,當時蘋果只要在媒體上提到哪一間供應鏈,隔天股價就有驚人的表現,當時光學鏡頭非常熱門,因為手機第一次搭上鏡頭可以拍照,也造就傳統相機廠的殞落,如今手機已經全面普及,題

背景:從冷門配角到市場主線,算力與電力被重新定價

小P從2008進入股市,每一個時期的投資亮點都不同,記得2009蘋果手機剛上市,當時蘋果只要在媒體上提到哪一間供應鏈,隔天股價就有驚人的表現,當時光學鏡頭非常熱門,因為手機第一次搭上鏡頭可以拍照,也造就傳統相機廠的殞落,如今手機已經全面普及,題

《轉轉生》(Re:INCARNATION)為奈及利亞編舞家庫德斯.奧尼奎庫與 Q 舞團創作的當代舞蹈作品,結合拉各斯街頭節奏、Afrobeat/Afrobeats、以及約魯巴宇宙觀的非線性時間,建構出關於輪迴的「誕生—死亡—重生」儀式結構。本文將從約魯巴哲學概念出發,解析其去殖民的身體政治。

《轉轉生》(Re:INCARNATION)為奈及利亞編舞家庫德斯.奧尼奎庫與 Q 舞團創作的當代舞蹈作品,結合拉各斯街頭節奏、Afrobeat/Afrobeats、以及約魯巴宇宙觀的非線性時間,建構出關於輪迴的「誕生—死亡—重生」儀式結構。本文將從約魯巴哲學概念出發,解析其去殖民的身體政治。

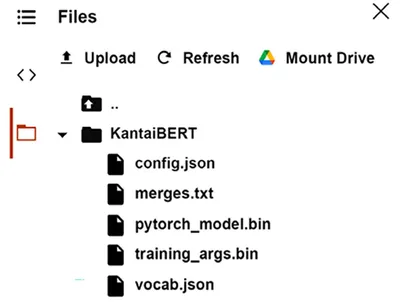

我想要一天分享一點「LLM從底層堆疊的技術」,並且每篇文章長度控制在三分鐘以內,讓大家不會壓力太大,但是又能夠每天成長一點。

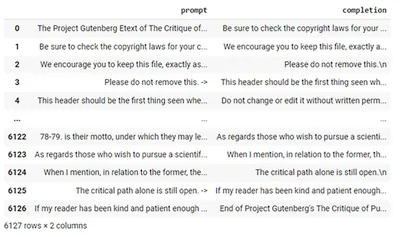

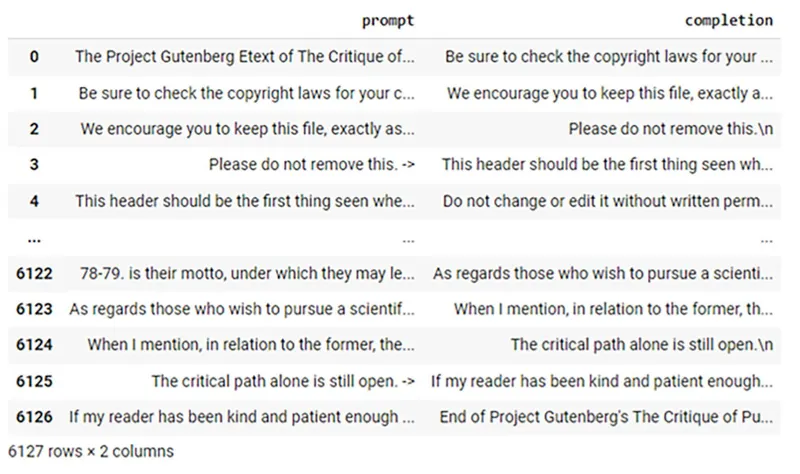

整理目前手上有的素材:

準備資料集:AI說書 - 從0開始 - 162 | 準備Pretrain模型需要的資料

準備必備函數庫:AI說書 - 從0開始 - 163

我想要一天分享一點「LLM從底層堆疊的技術」,並且每篇文章長度控制在三分鐘以內,讓大家不會壓力太大,但是又能夠每天成長一點。

整理目前手上有的素材:

準備資料集:AI說書 - 從0開始 - 162 | 準備Pretrain模型需要的資料

準備必備函數庫:AI說書 - 從0開始 - 163

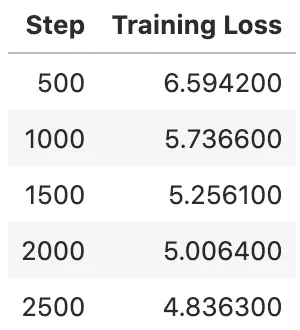

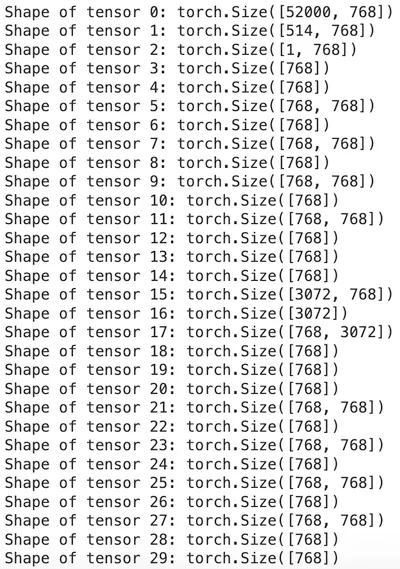

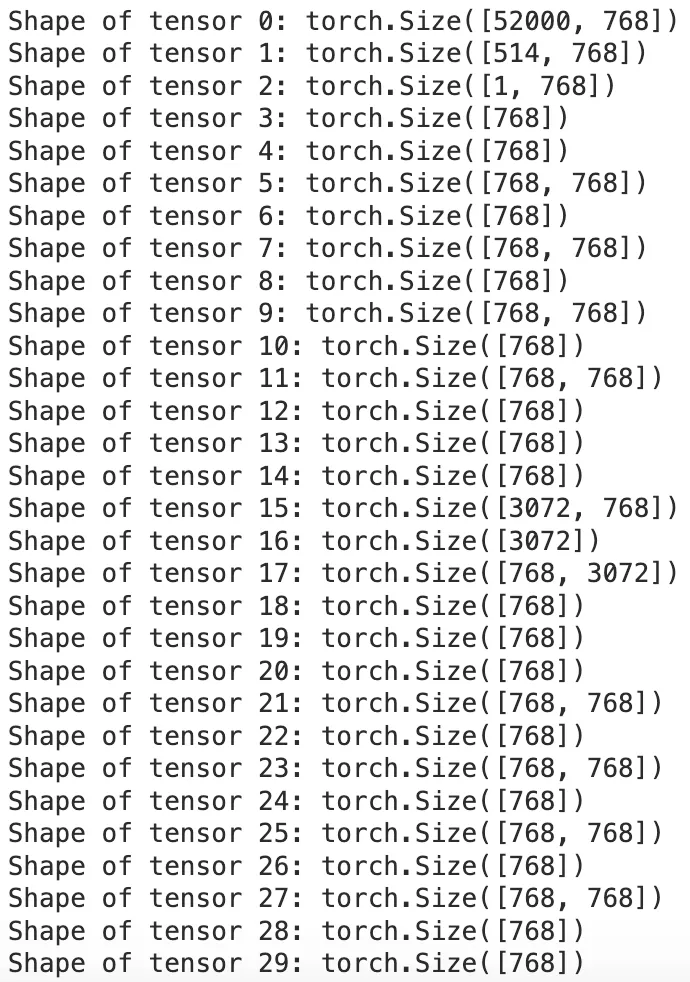

我想要一天分享一點「LLM從底層堆疊的技術」,並且每篇文章長度控制在三分鐘以內,讓大家不會壓力太大,但是又能夠每天成長一點。

先列出目前擁有的材料:

微調 GPT 模型引言:AI說書 - 從0開始 - 229 | 微調 GPT 模型引言

微調 GPT 模型的前置步驟:AI說書 - 從0開始

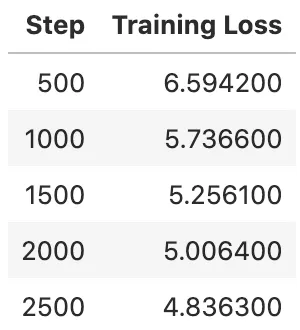

我想要一天分享一點「LLM從底層堆疊的技術」,並且每篇文章長度控制在三分鐘以內,讓大家不會壓力太大,但是又能夠每天成長一點。

先列出目前擁有的材料:

微調 GPT 模型引言:AI說書 - 從0開始 - 229 | 微調 GPT 模型引言

微調 GPT 模型的前置步驟:AI說書 - 從0開始

我想要一天分享一點「LLM從底層堆疊的技術」,並且每篇文章長度控制在三分鐘以內,讓大家不會壓力太大,但是又能夠每天成長一點。

先列出目前擁有的材料:

微調 GPT 模型引言:AI說書 - 從0開始 - 229 | 微調 GPT 模型引言

微調 GPT 模型的前置步驟:AI說書 - 從0開始

我想要一天分享一點「LLM從底層堆疊的技術」,並且每篇文章長度控制在三分鐘以內,讓大家不會壓力太大,但是又能夠每天成長一點。

先列出目前擁有的材料:

微調 GPT 模型引言:AI說書 - 從0開始 - 229 | 微調 GPT 模型引言

微調 GPT 模型的前置步驟:AI說書 - 從0開始

我想要一天分享一點「LLM從底層堆疊的技術」,並且每篇文章長度控制在三分鐘以內,讓大家不會壓力太大,但是又能夠每天成長一點。

整理目前手上有的素材:

準備資料集:AI說書 - 從0開始 - 162 | 準備Pretrain模型需要的資料

準備必備函數庫:AI說書 - 從0開始 - 163

我想要一天分享一點「LLM從底層堆疊的技術」,並且每篇文章長度控制在三分鐘以內,讓大家不會壓力太大,但是又能夠每天成長一點。

整理目前手上有的素材:

準備資料集:AI說書 - 從0開始 - 162 | 準備Pretrain模型需要的資料

準備必備函數庫:AI說書 - 從0開始 - 163

我想要一天分享一點「LLM從底層堆疊的技術」,並且每篇文章長度控制在三分鐘以內,讓大家不會壓力太大,但是又能夠每天成長一點。

先列出目前擁有的材料:

微調 GPT 模型引言:AI說書 - 從0開始 - 229 | 微調 GPT 模型引言

微調 GPT 模型的前置步驟:AI說書 - 從0開始

我想要一天分享一點「LLM從底層堆疊的技術」,並且每篇文章長度控制在三分鐘以內,讓大家不會壓力太大,但是又能夠每天成長一點。

先列出目前擁有的材料:

微調 GPT 模型引言:AI說書 - 從0開始 - 229 | 微調 GPT 模型引言

微調 GPT 模型的前置步驟:AI說書 - 從0開始

本文分析導演巴里・柯斯基(Barrie Kosky)如何運用極簡的舞臺配置,將布萊希特(Bertolt Brecht)的「疏離效果」轉化為視覺奇觀與黑色幽默,探討《三便士歌劇》在當代劇場中的新詮釋,並藉由舞臺、燈光、服裝、音樂等多方面,分析該作如何在保留批判核心的同時,觸及觀眾的觀看位置與人性幽微。

本文分析導演巴里・柯斯基(Barrie Kosky)如何運用極簡的舞臺配置,將布萊希特(Bertolt Brecht)的「疏離效果」轉化為視覺奇觀與黑色幽默,探討《三便士歌劇》在當代劇場中的新詮釋,並藉由舞臺、燈光、服裝、音樂等多方面,分析該作如何在保留批判核心的同時,觸及觀眾的觀看位置與人性幽微。

我想要一天分享一點「LLM從底層堆疊的技術」,並且每篇文章長度控制在三分鐘以內,讓大家不會壓力太大,但是又能夠每天成長一點。

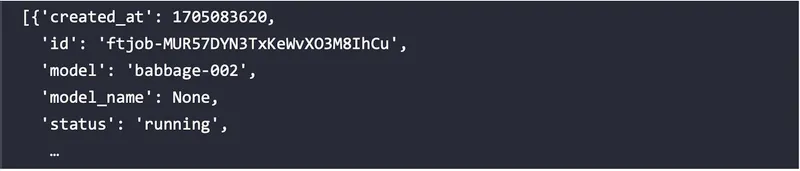

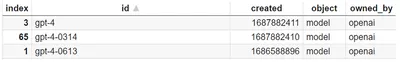

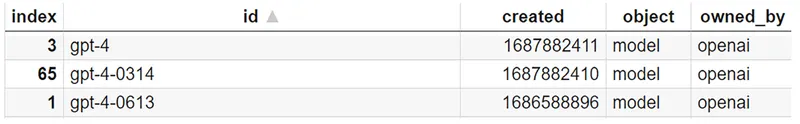

隨著此列表和數量的不斷發展,定期驗證該列表以及 OpenAI 的文檔(模型和棄用頁面)是一種很好的做法:

import pandas as pd

model_dat

我想要一天分享一點「LLM從底層堆疊的技術」,並且每篇文章長度控制在三分鐘以內,讓大家不會壓力太大,但是又能夠每天成長一點。

隨著此列表和數量的不斷發展,定期驗證該列表以及 OpenAI 的文檔(模型和棄用頁面)是一種很好的做法:

import pandas as pd

model_dat

我想要一天分享一點「LLM從底層堆疊的技術」,並且每篇文章長度控制在三分鐘以內,讓大家不會壓力太大,但是又能夠每天成長一點。

整理目前手上有的素材:

準備資料集:AI說書 - 從0開始 - 162 | 準備Pretrain模型需要的資料

準備必備函數庫:AI說書 - 從0開始 - 163

我想要一天分享一點「LLM從底層堆疊的技術」,並且每篇文章長度控制在三分鐘以內,讓大家不會壓力太大,但是又能夠每天成長一點。

整理目前手上有的素材:

準備資料集:AI說書 - 從0開始 - 162 | 準備Pretrain模型需要的資料

準備必備函數庫:AI說書 - 從0開始 - 163