我想要一天分享一點「LLM從底層堆疊的技術」,並且每篇文章長度控制在三分鐘以內,讓大家不會壓力太大,但是又能夠每天成長一點。

整理目前手上有的素材:

- 準備資料集:AI說書 - 從0開始 - 162 | 準備Pretrain模型需要的資料

- 準備必備函數庫:AI說書 - 從0開始 - 163 | 準備Pretrain模型需要的函數庫

- Tokenizer 前言:AI說書 - 從0開始 - 164 | Tokenizer 前言

- 訓練自己的 Tokenizer:AI說書 - 從0開始 - 165 | 訓練自己的Tokenizer

- 保存訓練好的 Tokenizer:AI說書 - 從0開始 - 166 | 保存訓練好的 Tokenizer

- Tokenizer 使用方式:AI說書 - 從0開始 - 167 | Tokenizer 使用方式

- GPU 及 CUDA 確認:AI說書 - 從0開始 - 168 | GPU 資源確認

- 編輯模型的 Config 檔:AI說書 - 從0開始 - 169 | 編輯模型的 Config 檔

- 初始化模型:AI說書 - 從0開始 - 170 | 初始化模型

- 模型參數探索:AI說書 - 從0開始 - 171 | 模型參數探索

繼 AI說書 - 從0開始 - 171 | 模型參數探索,繼續更深入的模型參數探索:

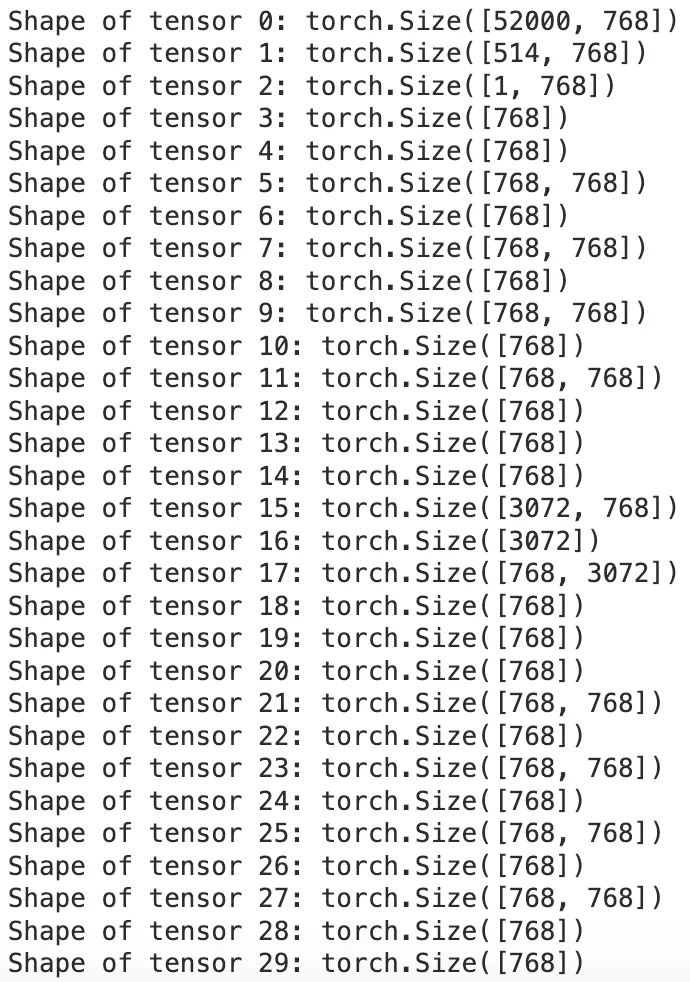

LP = list(model.parameters())

for i, tensor in enumerate(LP):

print(f"Shape of tensor {i}: {tensor.shape}")

總共有 106 組,節錄部分結果如下:

舉出幾組參數來說明:

- [52000, 768] : 可以是 Embedding 矩陣,詳見 AI說書 - 從0開始 - 164 | Tokenizer 前言 以及 AI說書 - 從0開始 - 169 | 編輯模型的 Config 檔 ,這裏要能察覺 768 / 12 = 64 ,其中 12 是 Head 個數

- [514, 768]:可以是 Positional Embedding 矩陣,詳見 AI說書 - 從0開始 - 169 | 編輯模型的 Config 檔,512 個 Token 外加 Start / End Token

- [1, 768]:可以是 <cls> Token 的 Embedding