Be S.U.R.E. Before You Share (確定之後再分享)

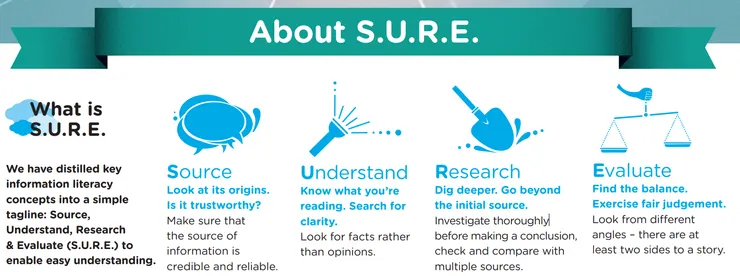

S.U.R.E. 包含四個步驟:

資訊來源(Source)

檢視資訊原始來源是否值得信賴?確定資訊來源是可信的(credible)且可信賴的(reliable)。

瞭解(Understand)

熟悉你正在閱讀的資訊,進一步檢索以求釐清。尋求事實而非看法。

研究(Research)

進一步鑽研,除了最初的資訊(或是你正在閱讀的這份資訊)外找尋更多的線索。在你下自己的結論之前多方仔細探究,查核與比較來自多個來源的資訊。

評估(Evaluate)

取得平衡,做成公平的判斷。從多角度檢視,畢竟故事至少總有兩面。

說來,在各類社群媒體充斥的今天,太容易轉發PO文了!在轉發之前先確定一下吧。又或者,沒有把握就不要轉發。

Samantha在她的演講裡進一步把S.U.R.E和生成式AI產生的資訊相連結:

- 資訊來源(Source):(1) 如果產生的內容有參考文獻,請針對參考文獻進行查檢。參考文獻是否與你給的提示詞(Prompt)相關?(2) 如果沒有參考文獻,請找出與你查找的主題相關的可信來源。

- 瞭解(Understand):產生的內容是事實或是看法?內容是否含糊不清?是否帶有偏見?

- 研究(Research):(1) 取決於你所查找的主題,要熟悉你可以透過甚麼管道進一步查找以確認生成式AI產生的內容。(2) 如果你在研究中想參考主題領域的新發現,請用圖書館所提供的權威資料庫。

- 評估(Evaluate):在你將生成式AI產生的內容與他人分享或使用在你的工作中之前,請進行判斷。