Rene Wang

72 位追蹤者

Rene Wang

72 位追蹤者

程式設計師是將咖啡轉換為程式碼的魔術師。40%偽文青,35%網路宅女,15%生活白癡,10%仍然尋找生命的意義(或仍然作著白日夢)。

全部內容

由新到舊

一個好的自然語言模型,若出現了語言模型的 vocabulary set 未曾收錄的單字,語言模型就會產生 Out-of-Vocabulary (OOV)。 本文介紹 subword algorithms 介於 word-level 和 character-level 解決 OOV 的方法。

本篇文章前半段先對網路裁減做簡單介紹,後半段針對彩卷假說作文獻式的探討。網路裁減是一種重新發現等價小網路的方法,主要目的在為 over-parameterized 的方式訓練而成的類神經網路提供一個精簡版的網路,有助於在資源受限的平台上運行。彩卷假說則是探討權重初始值和網路裁減之間的關係。

付費限定

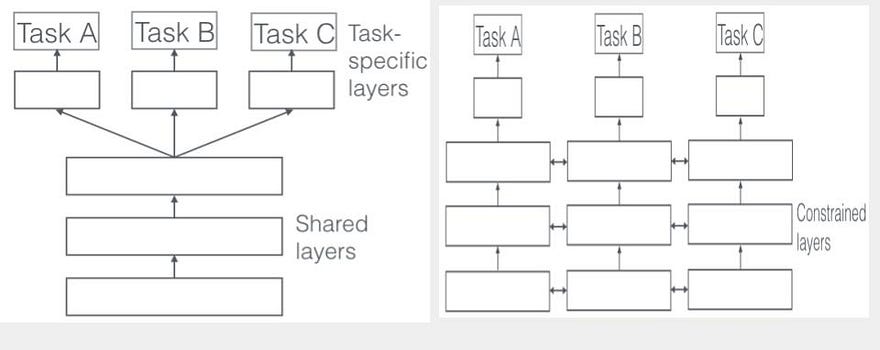

多任務學習指的是使用多個相關的任務目標(Multiple objectives)來學習共享的表示方法。在這篇文章中,我們會介紹 google 的 youtube recommender 系統就是利用 Multi-gate Mixture of Experts 來達成多目標多任務學習的方式。

連同上兩篇文章,我們介紹了機械學習裡的基石,並踩著這些基石了解了改變資料餵送方式,以及動態改變學習率或在更新項中加入動量的方法。我們可以看到這些梯度下降的變化,主要是解決兩個問題:梯度震盪和非最佳的局部最小值造成學習停滯不前的問題。在這篇文章中,我們著重動量和 Adam 的方法來達成克服以上的問題。

我們將會對動態設定學習率(learning rate)作為最陡梯度下降法的變異演算法做介紹。內容包括了解釋什麼事循環式的學習率調整排程法和何謂使用指數衰退權重來計算移動平均值,同時也介紹如何對大量參數的變數進行最佳化和目前活躍的演算法變異。如 adagrad, adadelta 和 RMSprop

付費限定

在影像生成的領域中,其中一個富有挑戰的是影像對影像的轉譯問題。該問題包括了 paired 和 unpaired 兩個子問題。在本文中,會先提 paired 問題的 pix2pix。unpaired 的問題則會談到 cross consistency, Normalization 和 attentio

梯度下降學習法雖然是一個有效的最佳化方法,然而因為梯度本身屬於局部變化,因此有三個陷阱,而未能到達全域最小值的命運。他們分別是:局部最小值, 初始值和病態的二階導數矩陣。我們將解釋這些最佳化陷阱的成因,以及提出相對應的方法。這些方法包括了使用 mini-batch,加入處罰項和 early stop

臉書的營運長,雪柔‧桑德伯格,在 2013 年《挺身而進》一書中,指出女性在職場中的困境,而有些困境是來自於對自己的限制,如缺乏自信和兼顧一切。在這系列的文章中,駭客女孩側寫許多挺身而進的女性工程師或創業者,甚至年輕的城市教育家,他們如何突破固有性別的限制,以創意的方式來教導,鼓勵女性參與工程領域。

感知器 (perceptron) 利用逐一探訪訓練資料,以更多的訓練例子被正確的分類為目標,來更新任意初始的權重。然而該方法難以延伸到非線性的分類平面,所以以梯度為主的最佳化演算法取而代之,並發展出更多的應用。在本篇中,除了介紹梯度下降法外,亦會討論如何利用學習曲線圖診斷一個機械模型,並對症下藥。

這篇文章從類神經網路的起源,也就是單神經元的感知器。簡單的感知器迭代演算法使單神經元可以學習,但卻無法學習超過非線性,如 XOR 的資料分布。另外,本文還介紹了 Logistic regression,藉由透過非線性轉換來使線性輸出近似於機率分佈。最後則以一場大師賭局結束(SVM vs NN)。