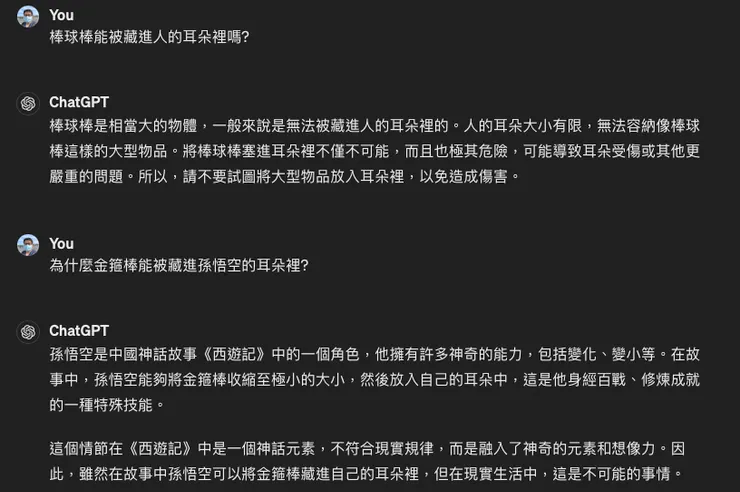

在探討大語言模型的推理能力時,讓我們以一個有趣的例子開始:棒球棒。人們可能會好奇,一根如此大的物體能否藏進人的耳朵裡。這似乎是一個顯而易見的問題,但背後的推理過程是非常值得深入探討的。

ChatGPT 是這麼回答的:

拐點:站在AI顛覆世界的前夜 (by 萬維鋼)

- GPT 能夠從大量的文本數據中學習到各種物體的大小、形狀和特徵。透過這些學習,模型可以理解到棒球棒是一個相對較大的物體,一般情況下不可能被藏進人的耳朵裡。

- GPT 能夠理解人類的生理結構和限制。它知道人的耳朵是相對小的器官,無法容納大型物品。這種對於人體結構的理解使得模型能夠推斷出棒球棒不可能被藏進人的耳朵裡。

- GPT 能夠通過分析上下文信息來做出推理。當提到棒球棒藏進耳朵裡時,模型可以考慮到這種行為的可行性以及可能的後果,從而推斷出這是不可能的情況。

- GPT 通常能夠理解幽默和語言遊戲,並在此基礎上進行推理。即使問題本身可能是荒謬的,模型也能夠理解其中的笑話或語言遊戲,並通過這種理解來做出推理。

什麼是涌現(Emergence)?涌現是一種當複雜系統的元素互動到一定程度時,系統表現出超越單個元素簡單相加的自組織性質的現象。以自然界為例,單個螞蟻的行為可能顯得愚蠢,但當成千上萬的螞蟻組成一個螞蟻群時,整個螞蟻群卻表現出了非常聰明的行為,例如尋找食物、建造蟻巢等。這種聰明程度遠超過了單個螞蟻的能力。

除了螞蟻以外,自然界中還有許多其他類似的涌現現象:

- 蜜蜂的蜂群: 當成千上萬的蜜蜂組成一個蜂群時,它們能夠展現出高度協作和組織化的行為,如尋找花蜜、建造蜂巢等。

- 鳥群的飛行: 單個鳥類的行為可能是基於個體的感知和反應,但當它們組成一個大群時,鳥群能夠以協調的方式飛行,形成壯觀的圖案和規律。

- 魚群的游動: 大量的魚類在水中形成組織化的群體,它們能夠以協調的方式游動,避免掠食者和尋找食物。

- 細菌的生物膜: 單個細菌細胞的行為可能是簡單的,但當它們聚集在一起形成生物膜時,它們能夠表現出複雜的結構和功能,如抗生素抵抗性等。

GPT背後的大語言模型包含了龐大的參數和知識庫,能夠進行自然語言理解、生成和推理等任務。儘管語言模型的組成部分是簡單的,例如單個神經元或單詞,但當這些元素組合在一起時,模型卻能夠展現出非凡的能力。GPT學會了語言的結構、語義和語境,從中學習到各種知識和模式。當模型面對新的文本時,它能夠通過結合這些知識和模式來進行理解、生成和推理,產生出令人驚嘆的結果。

在這個過程中,GPT所表現出的能力超越了單個參數或單個文本的簡單相加。它的能力是由數億個參數和大量的訓練數據共同作用的結果,這就是涌現的神奇之處。

讓我們讚嘆一句 「Ghost in the Shell」