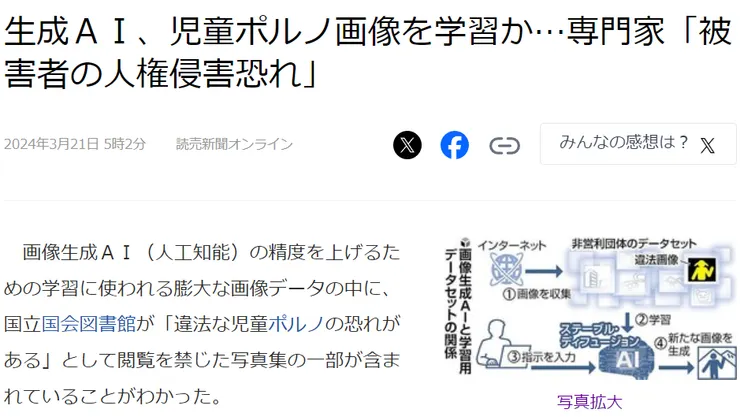

資料庫中蒐集了許多網路上的圖片資料進行學習

日本讀賣新聞調查,

https://news.livedoor.com/article/detail/26082456/

裡面含有1993年出版的少女裸體寫真集

當時日本並沒有相關法律禁止這類未成年裸體寫真集

直到1999年,日本實行兒童買春、兒童色情禁止法

這類寫真集才變成違法書籍。

雖然SD引擎預設有排除違法圖片,

但根據美國史丹福大學調查,

查出引擎學習資料裡有3226張涉嫌兒童色情的照片

大阪大學社會技術共創研究中心主任(風險學專家)岸本受訪表示,

生成AI是靠大量學習提升精密度,很難完全排除兒童色情。

AI企業必須要負起社會責任,向大眾說明引擎學習了哪些資料。

心得:

看赤松健的推特 有提到政府考慮要限制AI針對性學習漫畫家的畫風

感覺日本好像也要準備開始限制AI了