我們前一篇有介紹過「Cookieless時代趨勢來臨,與我們息息相關的隱私與行銷方式如何應對呢?」建議先行閱讀,裡面包含Cookie的基本觀念,以及為什麼要捨棄的原因,接下來才進入到本篇的主軸,將會針對FLoC的基本原理、是否能解決個人隱私議題為主軸進行探討。

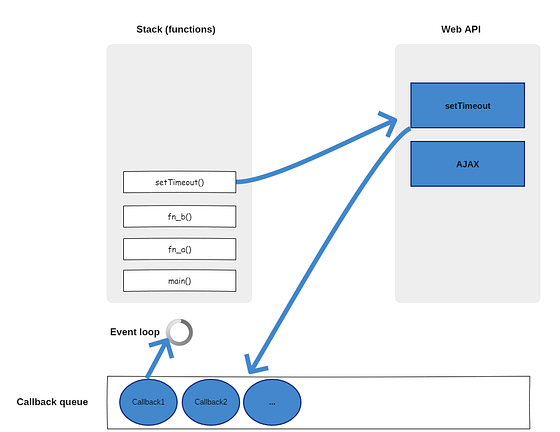

FLoC的全名是 Federated Learning of Cohorts,意思是透過 AI 的 federated learning(聯合學習),由Google推出的自家演算法,目的在於模糊掉個人數據與行為資料,以群體為概念,將類似瀏覽行為的用戶進行分群,產生一組群組識別碼,系統會根據每個群組所感興趣的主題進行標籤分類(美食、旅遊...),那這樣要如何進行廣告呢? 演算法會根據美個群組所感興趣的主題進行投放廣告,例如: 小明常常瀏覽旅遊網站,而其他瀏覽相同類型網站的使用者會被歸納到這個群組,而這個群組就被貼上🏷️旅遊的標籤, 因此平台就能將旅行社相關業者的廣告向這個群體進行推播,這就是Floc主要的運作模式。

主要讓活動記錄保留在用戶端,而不會發送到伺服器,之後可以建立起匿名的「群組」從而進行廣告投放。

聽起來是不是很棒,我們將自己隱身於群組之中,但試想假設我們的興趣本身就比較冷門,被歸類在一起的其他人可能是少數人,反而讓廣告可追蹤的範圍更侷限,廣告商透過一些演算法機制或許就能推敲出個人的興趣喜好,這樣就打破了原本Floc要解決的問題,因此才會出現反彈的聲浪,而Google也宣布預計放棄此套演算法。

下一個可能解決Floc缺陷的技術?

答案就是Google Topics,原理大致上與FLoC相似,最主要的差異就是加入了時間因子(保留3周...),並且將群組更加模糊化,避免被交叉比對,追朔描繪出個人隱私,相關的技術細節將留待下一章節進行探討。

結語

科技的演進過程中難免遇到一些缺陷之處,也應該反思,當我們在使用這些免費又優質的服務時,背後是否付出了什麼? 注意力、個資...等,都可能是我們無形中付出的資產,也越來越多人開始注重隱私,但是對於廣告商平台來說,如果無法知道銷售目標群的興趣,根本無法精準行銷,因此才會衍生這麼多技術迭代的過程,也看到了幾個中途失敗的技術,包括本文的FLoC也是Google準備放棄的一套具有爭議的演算法,對於我們來說,瞭解這些技術的演進過程,也能知曉當我們在使用網路的同時,背後這些平台商做了哪些事,讓我們自己能夠權衡要付出多少、付出的範圍、自身的權益。

資源參考

● https://unwire.pro/2022/01/28/google-16/news/

● https://www.itforce01.com/google提主題取代群組解救floc爭議下/

● https://blog.google/products/chrome/get-know-new-topics-api-privacy-sandbox/

🔔還沒成為Potato會員的朋友點這裡加入哦,撰寫文章還能挖礦打造被動收入 🔔

📝更多Web系列文章

● 關於Web的同源政策(Same Origin Policy)

● Web世界的邦交國政策 — 跨來源資源共用(Cross-Origin Resource Sharing, CORS)

● 你的資料如何被偷走? Web安全篇 - 跨站請求偽造(CSRF )

● 關於Web的安全內容政策 - Content Security Policy (CSP)