✍️ 文/未來的資料科學家練習生

你有沒有發現一件事?

- 拍照時,角度對了,臉就小一圈

- 整理資料時,有些數據方向「特別有代表性」

- 做模型時,我們常想抓出「真正重要的變化方向」

這些,其實都跟今天要介紹的主角有關──

👉 特徵值(Eigenvalue)與特徵向量(Eigenvector)

🧠 一、先別急,我們從一個神奇的等式開始:

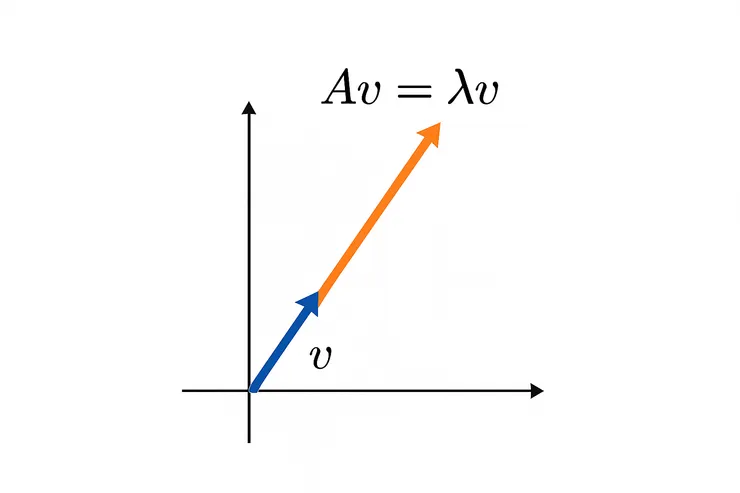

Av = λv

看不懂沒關係,我們一段段拆解。

- A:一個矩陣,像是對世界做出轉換(比如壓縮、旋轉、拉伸)

- v:一個向量,就是我們要觀察的方向

- λ(lambda):一個數字,表示 v 被放大了多少倍!

這個式子意思是:

📌 把向量 v 丟進矩陣 A 裡處理,它的方向不會改變,只是被放大或縮小了 λ 倍。

Av=λv 的向量視覺圖

🧲 二、特徵向量 vs. 特徵值:誰是誰?

- v 就是「特徵向量」:方向代表了這個世界裡不會被改變的主軸

- λ 是「特徵值」:代表這個方向被放大或縮小的程度

🧠 用生活比喻來說:

你是一張紙上的箭頭(向量),遇到一陣風吹來(矩陣 A)——

- 如果你是「特徵向量」,你會被風推動,但方向沒變,只是變長或變短

- 如果你不是特徵向量,風會把你吹歪方向

🧮 三、特徵分解(Eigendecomposition):把矩陣拆成有意義的部分!

特徵值和特徵向量最厲害的地方在於:

👉 他們可以幫我們把複雜的矩陣拆解成簡單的樣子!

這個拆法叫做 特徵分解(Eigendecomposition):

A = V × diag(λ) × V⁻¹

這句話的意思是:

- A:原本的矩陣

- V:裡面裝了所有特徵向量(排成一個矩陣)

- diag(λ):對角線上是每個特徵值,其它是 0(像一個特徵「比例尺」)

- V⁻¹:V 的反矩陣,用來還原原本的 A

🧠 用動畫比喻:

- V⁻¹ → 把你轉到特徵方向的世界

- diag(λ) → 在那個世界裡把每個方向放大縮小

- V → 把你轉回原來的世界

是不是有點像資料的「翻譯 → 編輯 → 翻譯回來」?

💡 四、資料科學家為什麼要學這個?

因為現實中的資料都很亂、很大、很複雜。

我們想要找出**「真正有代表性的方向」**,這時候:

- 特徵向量 → 告訴我們「資料在哪些方向最有變化」

- 特徵值 → 告訴我們「這個方向的重要程度」

這就是很多演算法(像主成分分析 PCA)背後的數學原理!

🔁 五、簡單複習一下!

🔹 特徵向量 v:被矩陣 A 作用後,方向不變

🔹 特徵值 λ:那個向量被放大(或縮小)了多少倍

🔹 特徵分解 A = V × diag(λ) × V⁻¹:把矩陣拆成「方向 × 比例 × 還原」的組合

🧠 小試身手:這是特徵向量嗎?

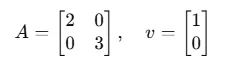

給你一個矩陣 A 和一個向量 v:

請問:

這個向量 v 是矩陣 A 的特徵向量嗎?

✅ 解題提示:

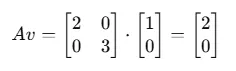

- 先計算 Av:

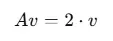

- 觀察 Av 是不是和原本的 v 方向相同(只有變長):

🎉 答案:

是的!這個向量是特徵向量,對應的特徵值是 λ = 2。

🚀 六、從今天開始,看懂資料的「本質方向」!

當你在玩資料分析、建模型時,不只是資料多、算力強就好。

更重要的是:

👉 你能不能「抓到最關鍵的方向」!

這就是特徵值與特徵向量的魅力。

📮 下篇我們來聊聊「PCA 主成分分析」是怎麼用這個原理,幫我們整理龐大的資料維度!

喜歡這系列內容嗎?追蹤這個專欄,讓我們一起從 0 到 1,慢慢成為資料科學家!