人工智慧帶來的挑戰

在人工智慧技術不斷發展的時代,確保人工智慧的安全性也至關重要。 雖然利用雲端資源強大的基礎架構建構的 AI 解決方案帶來了許多優勢,但也讓企業面臨一系列新的威脅。

部屬在雲端的 AI 系統除了擁有傳統系統的網路安全風險之外,同時也面臨四大主要層面的威脅,包括:- Model Manipulation and Evasion

模型操縱和逃逸策略涉及製作惡意的輸入或擾動,以利用 AI 模型中的漏洞。 諸如 prompt injection 和 model evasion 等技術可能導致模型產生有害/機敏/錯誤的內容,對 AI-driven 的應用程式構成風險。

- Application Compromise

破壞 AI-driven 的應用程式的包括服務阻斷攻擊、利用整合系統的漏洞取得權限並挾帶惡意的程式碼、使用模型逆向工程獲取智慧財產權或專有權利、取得對模型的控制,並採取超出授權的操作。

- Infrastructure for AI

針對 AI 應用程式基礎設施的威脅包括在模型訓練期間注入後門的 Model Backdooring、盜用模型的 Model Exfiltration 和操縱服務基礎設施並插入未經授權的模型的 Model Serving Compromise。

- Data

與資料相關的威脅包括敏感資訊的洩漏、訓練資料集的毒化,透過引導模型洩露機密資料等等。

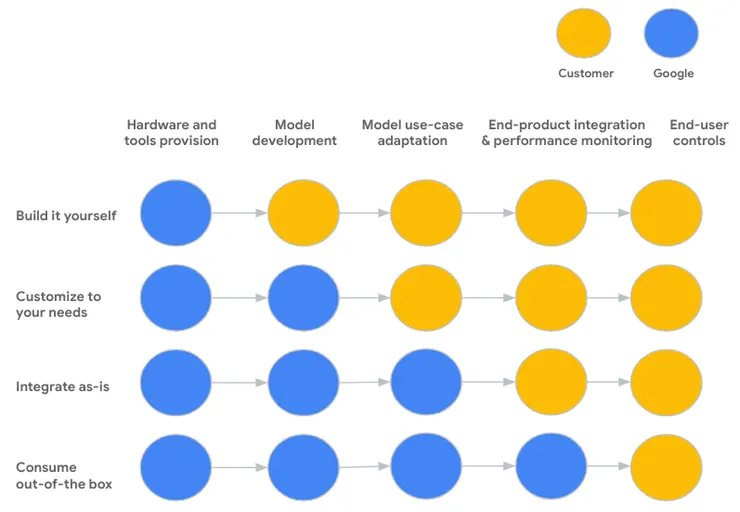

保護 Google Cloud 上的工作負載:共同責任模型

利用人工智慧的力量對於希望保持競爭力的企業至關重要,然而創新伴隨著責任與風險,在 Google Cloud 透過共同責任模型保護人工智慧系統和應用程式免受潛在風險和威脅。

在 Google Cloud 的方面:

在 Google Cloud 方面需確保:

- 基礎架構的安全,例如資料中心、網路和作業系統等等。

- 平臺的安全,例如加密、漏洞管理以及身分識別和存取管理(IAM)控制等等。

- 平台的合規性,例如遵守 FedRAMP、HIPAA 和 PCI DSS 等行業標準,進一步確保 Google Cloud 對使用者資料隱私和安全的承諾。

在使用者的方面:

雖然 Google Cloud 承擔了一部分安全責任,但使用者也須確保:

- 使用身分和存取管理 (IAM) 最佳實踐,控制對雲端資源和企業資料的存取

- 配置網路安全控制,例如 VPC segmentation、firewall rules、WAF protection 和 API management

- 保護應用程式,例如實踐安全編碼、更新版本和定期漏洞測試

- 實施資料安全措施,例如加密、資料遺失防護 (DLP) 和適當的資料生命週期管理

- 建立日誌記錄、監控和事件回應計畫

配合 Google Cloud 的 Google’s Secure AI Framework(人工智慧安全框架) 解決特定的 AI 系統風險,透過結合第一手情報、專業知識和創新服務,為使用者提供緩解各種威脅和風險的工具。

Google Cloud 提供的最佳實踐解決方案

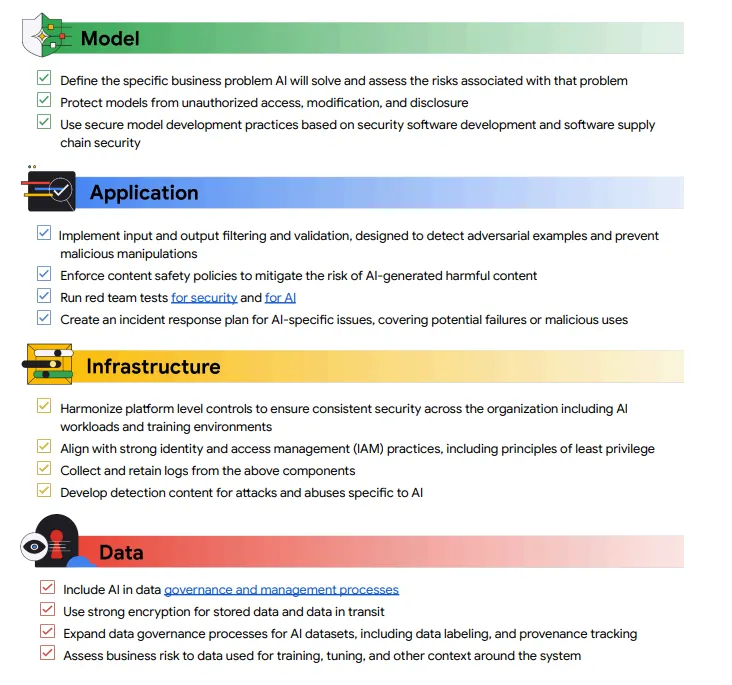

以下會針對人工智慧帶來的四大主要層面的威脅整理在 Google Cloud 解決方案:

Model Security

- Vertex AI Platform: 為訓練和部署人工智慧模型提供安全的託管環境

- Cloud IAM (Identity and Access Management): 控制對模型的訪問,確保只有授權使用者才能存取

Application Security

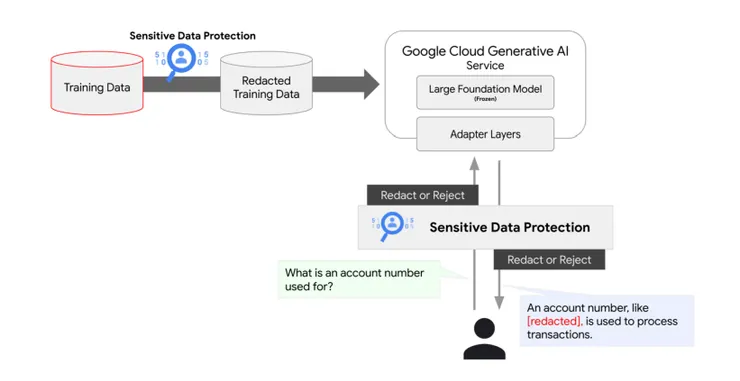

- Sensitive Data Protection: 識別/保護/匿名化 AI 應用程式中的敏感數據,並在模型提供回應前,識別是否含有機敏資訊。

- Web Security Scanner: 掃描應用程式程式碼中的漏洞和潛在安全風險。

- Cloud Armor: 提供 WAF 和阻止 DDoS 的能力,保護應用程式遭受第七層的攻擊。

Infrastructure Security

- VPC Service Controls: 圍繞雲端資源建立數位圍籬,防止未經授權的存取。

- Cloud Build and Artifact Registry: 透過建立和掃描( Container Analysis API )容器中的漏洞來保護軟體供應鏈。

Data Security

- Encryption at Rest: 使用加密儲存在 Google Cloud 的數據,提供額外的安全層。

- Sensitive Data Protection: 識別和保護資料集中的敏感數據,確保遵守隱私法規。

- Cloud Key Management Service (Cloud KMS): 管理用於保護資料的加密金鑰,實現具有細粒度的存取控制。

Logging, Detection, and Response

- Cloud Logging: 收集應用程式和基礎架構的日誌,以及審計日誌(audit log),從而實現安全事件的監控和分析。

- Security Command Center: 為工作負載提供資安事件控制和威脅警報,從而實現主動威脅偵測和處理。

- Container Threat Detection: 監控容器化的工作負載是否有 runtime 的即時攻擊,進而增強Kubernetes 環境中的安全性。

總結

人工智慧的出現協助企業創造下一波的成長紅利,但是也導致資安上的諸多挑戰,本篇整理 Best Practices for Securely Deploying AI on Google Cloud 和相關參考資料,希望藉由各種解決方案和最佳實踐,在使用人工智慧的同時也減少其帶來的安全性風險。

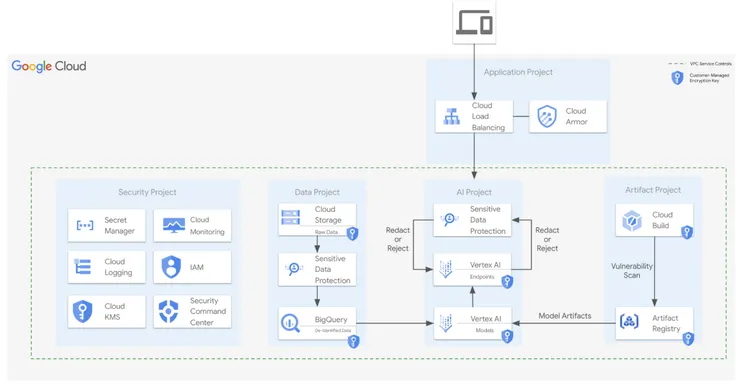

Google Cloud 上 AI 應用程式架構:

● 使用Cloud Armor 管理外部流量。

● 利用 Sensitive Data Protection 識別敏感資料並決定接受或拒絕輸入和輸出。

● 使用 Cloud KMS 加密敏感資料和容器映象檔。

● 使用 VPC Service Controls 保護您的基礎架構。

● 利用 Cloud IAM 維持精細的身分存取管理政策。

● 透過日誌、監控和警報管理環境內的資安事件。

本文統整了如何安全地使用 AI 在 Google Cloud的最佳實踐,如果你喜歡這篇文章歡迎幫我按愛心鼓勵一下喔!~閱讀愉快!~

參考資料

白皮書

- Best Practices for Securely Deploying AI on Google Cloud

- Why Red Teams Play a Central Role in Helping Organizations Secure AI Systems

- Principles and best practices for data governance

- Cybersecurity Forecast 2024

- Google’s Secure AI Framework

- Secure AI Framework Approach

- Securing AI: Similar or Different?

Google Cloud 部落格