Multimedia Computing & Telecommunication Lab

目錄

一、引言:超越生成,賦予AI知識與信任

二、RAG的核心原理與架構

2.1基礎RAG:工作流程與核心組件

2.2進階RAG:架構演進與優化策略

三、RAG 在不同領域的應用案例

3.1企業知識管理與運營

3.2客戶服務與支援

3.3金融服務

3.4醫療保健

3.5法律科技

3.6教育與研究

四、RAG的挑戰、評估與未來趨勢

4.1當前核心挑戰與應對策略

4.2未來發展趨勢與展望

一、引言:超越生成,賦予AI知識與信任

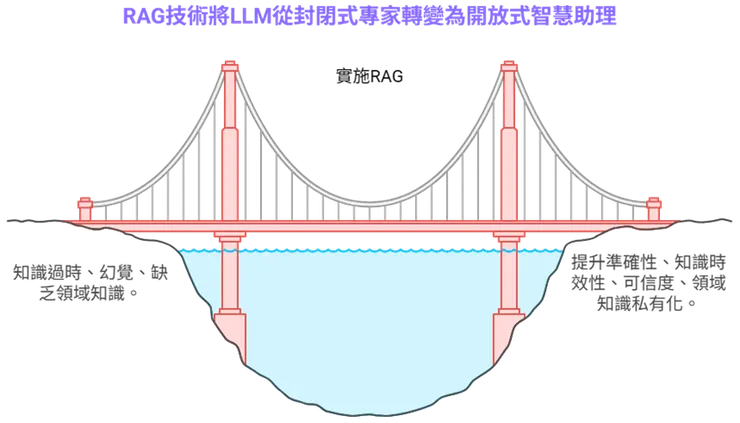

自2022年底ChatGPT問世以來,大型語言模型(Large Language Models, LLMs)以前所未有的速度滲透到社會的各個層面,其強大的自然語言理解與生成能力,預示著一場深刻的生產力革命。然而,隨著應用的普及,LLMs的固有缺陷也日益凸顯。這些模型如同一個博聞強記但記憶停留在過去某個時間點的「封閉式專家」,其知識完全依賴於預訓練數據集。這導致了三大核心問題:知識過時(Outdated Knowledge)、幻覺(Hallucination)以及缺乏特定領域知識(Lack of Domain-Specific Knowledge)。

LLMs在生成看似流暢自信的回答時,可能與現實世界的事實相悖,或憑空捏造信息,這種現象被稱為「幻覺」(Ji et al., 2023)。在醫療、金融、法律等對事實準確性要求極高的領域,幻覺不僅會削弱用戶信任,更可能引發災難性後果。此外,企業若希望利用LLM處理內部私有數據,直接將其用於模型訓練不僅成本高昂,還面臨嚴峻的數據安全與隱私風險。

為了解決這些根本性挑戰,學術界與產業界共同探索出了一條極具潛力的技術路徑——檢索增強生成(Retrieval-Augmented Generation, RAG)。RAG的核心想法極為精煉,即「先檢索,後生成」(Retrieve-then-Generate)。它將LLM強大的生成能力與外部權威知識庫的實時性、準確性相結合,構建了一個開放式的智能系統(經濟部產業技術司,2025)。在回應使用者查詢時,RAG系統首先從指定的知識庫(如企業內部文檔、數據庫、實時新聞源)中檢索最相關的信息片段,然後將這些信息作為上下文(Context)提供給LLM,引導其生成有憑據、準確且可追溯的答案。

RAG的出現,不僅是一種技術上的優化,更是一種範式轉變。它將LLM從一個封閉的「知識黑箱」轉變為一個能夠動態接入外部世界的「開放式智慧助理」。這種架構帶來了顯著的優勢:

- 提升準確性與減少幻覺:通過將答案「錨定」在檢索到的事實依據上,RAG 極大地降低了模型產生幻覺的機率(Dataworkz, 2025)。

- 保證知識的時效性:知識庫可以獨立於LLM進行實時更新,確保系統能夠提供最新的信息,而無需耗費巨資重新訓練模型(AWS)。

- 增強可信度與可解釋性:RAG系統可以展示答案的來源引用,允許使用者追溯和驗證信息的真實性,這對於建立用戶信任十分重要(Evidently AI)。

- 實現領域知識的私有化應用:企業可以安全地將內部敏感數據構建成私有知識庫,讓RAG系統在不洩露數據的前提下,提供基於企業自身知識的智能服務(UML中國)。

自2020年由Lewis等人首次提出以來(Lewis et al., 2020),RAG技術的研究呈現出爆炸性增長。根據學術論文數據庫的統計,相關論文數量在2023年後急劇攀升,迄今,光在ArXiv上發布有RAG在標題中的論文就超過八百篇(arXiv官網,2025),顯示出其在學術界和產業界的極高熱度。

本報告旨在為對RAG技術已有基礎了解的開發者與研究人員,提供一份全面而深入的系統性指南。我們將從RAG的核心原理與基礎架構出發,逐步深入到為解決實際問題而生的進階優化策略與架構演進。隨後,我們將通過剖析來自金融、醫療、法律、客戶服務等多個領域的真實商業案例,展示RAG的落地價值與實踐經驗。最後,本報告將系統性地梳理RAG當前面臨的核心挑戰,介紹前沿的評估體系,並展望其與智能體(Agent)、多模態技術融合的未來發展趨勢。希望通過這份報告,能夠幫助讀者構建對RAG技術從理論到實踐、從現狀到未來的完整認知體系。