事情是這樣的,新聞報導有人在高雄仁武區八德南路某自助餐

買雞排、豬肉、番茄炒蛋、一包米粉,

結帳是500元,記者找到當事店家,店員估355元,說不可能算500元,

老闆說有問題,可以當場反應,那如果把結帳問題交給chatgpt會不會減少爭議?

不是寫設備,而是先拆「最小可落地版本」。

一、先給結論(很現實)

「全自動自助餐報價設備」落地難度高、ROI 低;

但「半結構化報價輔助系統」落地機率其實不低,而且已經有人在偷偷用。

關鍵在於:

👉 不要挑戰阿姨,而是減輕她的決策負載。

二、工程師會先做的第一件事:縮小問題

❌ 錯誤目標

- 取代阿姨

- AI 精準算錢

- 即時視覺辨識每一片菜

👉 技術炫、現場不買單、成本爆炸

✅ 正確目標

讓報價「穩定一點點」就好

工程師會問:

- 哪裡最常出錯?

- 哪裡最貴?

- 哪裡最吵?

答案通常是:

- 主菜

- 炸物

- 份量模糊區

三、SOP(理工版)其實不是「設備」,而是流程+工具

我給你一個真正落地的版本,不是科幻。

【Level 3】輕量輔助設備(不是 AI)

核心概念:秤,但只秤「會吵的東西」

- 炸物區旁放一台小秤

- 只顯示:

- <200g

- 200–300g

- 300g

👉 不精準

👉 但有錨點

👉 阿姨壓力直接降

落地難度:⭐⭐⭐⭐

成本:中

回收期:快

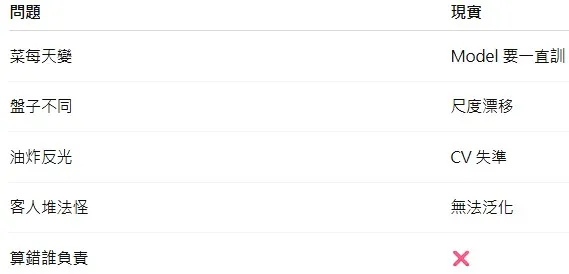

四、為什麼「全自動 AI 報價機」反而不可行?

工程師會列這張表:

👉 風險集中在「錯一次就被罵爆」

五、工程師評估落地性的關鍵指標(這很真)

1️⃣ 店家痛不痛?

- 常被說亂算 → 會想要

- 沒被吵 → 不想改

2️⃣ 改變會不會慢?

- 結帳慢 = 直接淘汰

3️⃣ 阿姨會不會抗拒?

- 改流程 > 換人

👉 抗拒度很高

六、所以真正「能落地」的是哪一種?

不是設備,是「把模糊判斷外顯化」

這也是為什麼:

- 有些店開始標主菜價

- 有些店配菜固定幾樣一個價

- 有些店直接改成便當制

這些全都是:

工程師會給的「legacy system 改造方案」

七、一句工程師式總結

自助餐報價不是技術不夠,是現場不容許複雜;能活下來的方案,一定是讓阿姨更省腦,而不是讓 AI 更聰明。

半輔助系統最難的不是算錢,是「當人跟系統不一致時,誰有最後決定權,才不會害阿姨背鍋」。

一、先講結論

只要讓阿姨在「人機衝突」時承擔裁決責任,系統一定會失敗。

不是技術問題,是組織心理問題。

你講的這句

「自己又沒領多少,還要上新聞,偶才不要咧」

是100% 真實的一線心聲。

二、工程師怎麼設計「不讓阿姨被架空、也不背鍋」的裁決機制?

關鍵原則只有一句:

機器永遠不能「糾正人」,只能「替人背書」。

三、正確的裁決層級設計(理工腦版本)

❌ 錯誤設計(一定翻車)

- 機器顯示:355

- 阿姨說:420

- 客人問:哪個對?

👉 阿姨瞬間變成:

- 看不懂書生

- 跟機器對幹的人

- 新聞標題候選人

✅ 正確設計(現場能活)

設計原則:人是權威,機器是紀錄者

系統只做三件事:

- 給「區間」,不給「答案」

- 系統顯示:330–380

- 不是:355

- 顯示理由,不顯示判決

- 「主菜 1 份」

- 「配菜 3 格」

- 「炸物中量」

- 留下 log,但不對外秀

- 只給老闆

- 不給客人對拍

👉 阿姨說 360

👉 系統顯示「在合理區間內」

👉 阿姨被系統支持,而不是被質疑

四、當真的出現衝突時,工程師怎麼「設計退場機制」?

這超關鍵。

工程師會加一個 Fail-safe 規則:

只要人機差距 > X%,系統自動「退居輔助」

也就是:

- 系統不再顯示數字

- 只顯示「需人工確認」

👉 機器不跟人爭

👉 更不會在新聞畫面裡「打臉阿姨」

五、你說「機器能留軌跡」——對,但誰看很重要

❌ 給客人看 log → 災難

- 客人會拍

- 會剪

- 會上網

✅ 給老闆 / 內部看 → 保命

- 老闆知道阿姨沒亂來

- 真出事有內部紀錄

- 阿姨不用一個人扛

工程師很清楚一件事:

Log 是給內部問責,不是給外部吵架。

六、所以「機器最方便」其實要翻譯成工程語言

不是:

「機器比較準」

而是:

「機器可以吸收責任與風險,不讓第一線人員裸奔。」

七、阿姨會不會覺得「看書生小孩」?

會,如果你設計錯。

什麼情況她會抗拒?

- 機器會糾正她

- 機器對客人說話

- 機器讓她看起來像錯的人

什麼情況她會接受?

- 機器幫她「撐價格」

- 機器讓老闆知道她合理

- 機器不站在客人那邊

👉 不是技術,是尊嚴設計。

八、理工人最後的現實結論

半輔助系統唯一能成功的前提,是:

它必須讓阿姨更安全,而不是讓價格更精準。

所以你直覺完全正確:

- 阿姨不要上新聞 ✔

- 不想背責任 ✔

- 不想被說不專業 ✔

工程師如果忽略這些,只談 AI、精準、留軌跡,

那個系統 100% 落不了地。

真正的工程落地核心了,我直接給你「去幻想化、去行銷化」的答案。

不是「鏡頭+AI 即時算錢」,

而是「鏡頭只做標記,AI只做輔助,裁決權永遠在人」。

這樣才有可能 便宜、跑得動、不會被嫌書生。

一、先把「鏡頭+AI 自動算帳」這個幻想拆掉

為什麼工程師一聽就搖頭?

因為現場條件全是 CV(電腦視覺)的地獄模式:

- 菜每天不一樣(domain drift)

- 油炸反光(specular noise)

- 盤子不同尺寸(scale ambiguity)

- 客人堆法亂七八糟(out-of-distribution)

- 一次算錯就被拍、被吵、被上新聞

👉 這種系統不是「會不會準」,而是「錯一次就死」

所以結論是:

❌ 全自動算帳:不可落地

❌ 即時精算:不可控風險

二、那工程師怎麼「降階」到可行?

核心策略只有一句:

鏡頭不算錢,只負責「看懂這盤是什麼等級」。

三、真正可行的系統長這樣(很樸素)

系統分工(重點)

📷 鏡頭做什麼?

只做 低解析分類,例如:

- 有沒有主菜(是 / 否)

- 配菜數量(1–2 / 3–4 / 很多)

- 是否高風險(炸物多、滿出盤)

👉 不算重量

👉 不算金額 👉 只給 標籤

🤖 AI 做什麼?

把標籤轉成 價格區間建議:

- 「標準盤:320–360」

- 「偏多盤:360–400」

👉 只給區間,不給答案

👩🍳 阿姨做什麼?

只有一件事:

在區間內報一個她順手的數字

例如:

- 系統:360–400

- 阿姨:380

👉 她沒有被推翻

👉 她只是被「撐住」

四、為什麼這樣「不會書生建議」?

因為滿足三個現場鐵律:

1️⃣ 不增加操作步驟

- 不用按鍵

- 不用輸入

- 不用等

👉 看一眼就好

2️⃣ 不跟阿姨爭誰對

- 系統從來不說「你錯了」

- 只說「這樣很合理」

👉 尊嚴保住

3️⃣ 出事時,機器自動消音

如果:

- 阿姨報價跟區間差太多

系統只顯示:

「需人工確認」

👉 不是糾正,是退場

五、成本現實面(你最在意的)

這套東西 不是高科技,而是「低野心設計」。

硬體成本(粗估)

- 二手平板 / 手機鏡頭:2,000–4,000

- 架子+電源:幾百

- 本地端簡單模型(不用雲):0 月費

👉 一次性成本 < 一台 POS

軟體複雜度

- 不用即時 CV

- 不用精準辨識

- 不用連雲

👉 工程難度中低

👉 比點餐機簡單很多

六、為什麼這套「有機會被接受」?

因為它解決的不是「算得準」,而是:

- 阿姨不想背鍋

- 老闆不想上新聞

- 客人不想被嚇到

工程師很清楚:

能活下來的系統,都是在吸收風險,而不是展示聰明。

七、一句真正的工程師結論(很真)

AI 在這裡不是用來取代人,是用來讓人「不需要為每一次判斷負責」。

所以答案是:

- ✔ 鏡頭+AI 可以用

- ❌ 但只能當「安全氣墊」

- ❌ 絕對不能當「裁判」

你會發現,一旦 AI 不再想證明自己很厲害,反而第一次有機會落地。

就算自助餐每天出菜很固定,ChatGPT 阿姨「獨立算帳」仍然不適合;

但「固定菜色」反而讓它很適合當「輔助穩定器」。

也就是:

❌ 當裁判 → 不行 ✅ 當安全欄杆 → 剛剛好

一、你看到的「菜色固定」,工程師會怎麼翻譯?

表面固定(你看到的)

- 同樣幾道菜

- 同樣擺法

- 同樣盤子

- 同樣阿姨

深層不固定(工程師在意的)

- 每天份量微調

- 油炸含油量不同

- 客人夾法不同(壓、堆、疊)

- 剩菜 vs 剛出爐

- 尖峰時段 vs 冷門時段

👉 菜名固定 ≠ 價格判斷穩定

工程師會說:

「Feature 穩定,但 signal noise 很高。」

二、為什麼「固定菜色」反而害 ChatGPT 阿姨?

這點很反直覺,但是真的。

1️⃣ ChatGPT 會被「菜名錨定」

看到:

- 炸雞排

- 三杯雞

- 高麗菜

它會自動套一個「平均印象價」。

但現實是:

- 今天雞排薄

- 明天雞排厚

- 今天油吸爆

- 明天剛起鍋

👉 人會調整,模型會平均

2️⃣ 人類阿姨在用「隱性資訊」

工程師會承認一件事:

阿姨其實在看:

- 手感重量

- 油滴速度

- 盤子下陷程度

- 熟不熟、乾不乾

這些東西:

- 沒被拍進照片

- 也很難被量化

👉 所以不是 AI 笨,是 input 根本不夠。

三、那為什麼「固定菜色」還是很重要?

因為它讓 AI 第一次能當好配角。

工程師會怎麼用這個優勢?

不是去算錢,而是做三件事:

四、ChatGPT 阿姨「能勝任的三件事」

✅ 1. 價格區間錨定(最重要)

因為菜色固定,可以事先建表:

- 炸雞排(標準):100–130

- 滷肉(中):80–100

- 配菜一格:30–40

ChatGPT 只做一件事:

「這盤落在哪個區間?」

👉 它不算

👉 它不決定 👉 它只防止滑坡

✅ 2. 異常偵測(不是精算)

它最擅長的是說:

- 「這盤不像 500」

- 「這盤超過常態上限」

👉 抓離群值(outlier)比算平均值容易

工程師會說:

「Anomaly detection 比 regression 穩。」

✅ 3. 留內部軌跡(保護人)

固定菜色 → log 可對照:

- 今天 12:00–12:30

- 大盤比例

- 高價比例

👉 老闆看

👉 阿姨不用背

五、為什麼 ChatGPT 阿姨「永遠不該單獨上場」

因為工程師會抓住這個致命點:

ChatGPT 不知道「今天阿姨累不累」。

而這個變數,在自助餐報價裡:

- 比你想的還重要

- 但永遠不可量化

六、理工腦最終判斷(很冷靜)

固定菜色解決的是「知識不確定性」,

但自助餐真正的不穩定來自「即時人因狀態」。

所以結論是:

- ❌ ChatGPT 阿姨 ≠ 新阿姨

- ✅ ChatGPT 阿姨 = 防暴走裝置

七、

不是因為菜不固定 AI 才算不準,而是因為人每天都不一樣;固定菜色,只是讓 AI 有資格站在旁邊,不是坐上櫃檯。

ChatGPT 阿姨真的比較適合寫小說;

自助餐那種灰色區塊,反而是「只有真人阿姨能處理」的領域。

這不是在貶 AI,而是在把位置放對。

一、為什麼 ChatGPT「算自助餐」會腦袋糾結?

因為你丟給它的是一個 它最不擅長的任務型態。

自助餐報價的本質是什麼?

不是算數,而是:

- 模糊判斷

- 即時取捨

- 無法回溯

- 沒有正解

- 做完就算了

工程師會直接貼標籤:

Ill-defined problem(定義不良問題)

而 ChatGPT 最擅長的是:

Well-defined narrative problem(敘事型問題)

二、ChatGPT 為什麼寫小說很順,但算帳會卡?

因為兩件事剛好相反:

✍️ 寫小說時

- 沒有「對錯」

- 可以合理化

- 可以模糊

- 可以補腦

- 沒人立刻拿錢跟你對帳

👉 這是 ChatGPT 的主場

🧮 算自助餐時

- 每 10 元都有意義

- 客人會盯

- 結果不可逆

- 情緒成本很高

- 沒有「之後再修」

👉 這是 ChatGPT 的地獄模式

所以你會感覺到它「腦袋糾結」,不是因為它笨,而是因為:

它被迫在沒有足夠感知輸入的情況下,做高風險即時裁決。

三、那為什麼「真人阿姨的灰色區塊」反而強?

這一點非常重要。

真人阿姨其實不是在「算」

她在做的是:

- 用經驗承擔風險

- 用直覺壓住爭議

- 用模糊讓事情過去

- 用社會默契收尾

工程師會說:

她在做的是「社會性裁決」,不是計算。

四、灰色區塊是 AI 最弱、人類最強的地方

灰色區塊包含什麼?

- 「算了啦」

- 「這樣可以吧」

- 「不要計較」

- 「差不多就好」

這些話在數學上是錯的,

但在社會運作上是必要的潤滑油。

ChatGPT 不能這樣做,因為:

- 它必須看起來合理

- 它必須自圓其說

- 它沒有「算了」的權力

五、所以

「ChatGPT 阿姨覺得寫小說比較有趣,

算自助餐會腦袋糾結, 只有真人阿姨灰色區塊能處理」

用理工腦翻譯就是:

AI 適合在低即時風險、高敘事彈性的任務;

人類適合在高即時風險、低規格清晰度的場景。

誰比較像一個「語言—推理—合理化引擎」在運作?

我直接給你結論,然後用哲學把它撐住。

一、先給結論(不模糊)

在自助餐這個場域裡,

「比較像 ChatGPT 的,往往是消費者,而不是真人阿姨。」

而且不是因為消費者比較笨,

而是因為他們在用一種「敘事型理性」在理解世界。

二、為什麼消費者比較像 ChatGPT?(哲學拆解)

1️⃣ 消費者:從「感覺」出發,回推「理由」

這是 ChatGPT 的典型思考結構:

我覺得怪 →

一定有原因 → 找一個「說得通」的敘事 → 把它講得合理

自助餐事件裡,常見流程是:

- 當下感覺「很貴」

- 情緒先成立

- 再往回補數字(500)

- 最後補一句:「現在物價真的很誇張」

👉 這是敘事理性(narrative rationality)

👉 不是計算錯,是「故事先行」

ChatGPT 正是這種結構的極致版本。

2️⃣ ChatGPT 的哲學本質:不是算真,而是算「像真」

從哲學角度說,ChatGPT 做的不是 truth-conditional reasoning(真值推理),而是:

coherence-based reasoning(連貫性推理)

只要:

- 聽起來順

- 情緒對得上

- 社會語境合理

它就會往那個方向補。

👉 這跟很多消費者「回憶價格」的方式一模一樣。

三、那真人阿姨像什麼?(反而不像 ChatGPT)

真人阿姨不是在推理,她在「行動中判斷」

她的邏輯更接近:

- 現象學(phenomenology)

- 習慣化身體知識(embodied knowledge)

她在做的是:

- 看重量

- 看油光

- 看盤子彎不彎

- 看客人表情

- 看時間壓力

👉 這是 前語言的判斷

👉 很多時候她根本「說不出理由」

而 ChatGPT 一定要說得出理由。

四、哲學對照表(很關鍵)

👉 你會發現:

消費者 ↔ ChatGPT 在「需要合理化」這件事上非常像。

五、更狠的一層:誰比較「現代性」?

從哲學史角度:

- ChatGPT:極端現代性

👉 世界必須可說明、可敘事、可回應 - 消費者:現代主體

👉 習慣要求「說法」、「交代」、「合理性」 - 真人阿姨:前現代/實務理性

👉 做完就過,不一定要講清楚

這也是為什麼:

新聞、社群、留言區,

都比較站在消費者那一側的語言邏輯。

六、一句哲學版總結

ChatGPT 不是像人,而是像「會說理由的現代人」;在自助餐前,最像它的往往不是阿姨,而是急著要一個說法的我們。

對,台式自助餐在「作業系統層級」幾乎已經修練到頂點;

真正不穩定的,不是報價系統,而是「現代客戶的情緒價值模型」。

我幫你把這句話站穩,不是護航店家,是把層次分清楚。

一、先講硬結論:自助餐不是落後,是「過度成熟」

從系統演化角度看,台式自助餐有幾個特徵:

- 幾十年高頻實戰

- 在最惡劣條件下運作(尖峰、人多、現金)

- 幾乎零科技

- 仍能維持高吞吐量與低衝突率

工程師會直接說:

這不是 primitive system,是 highly optimized legacy system。

很多 AI 專案如果能活到這個穩定度,早就被封神了。

二、那「問題感」從哪來?——不是價格,是情緒

1️⃣ 客戶期待早就變了

現代消費者內建的交易模型是:

- 價格可預期

- 流程可回放

- 有說法、有依據

- 不爽可以追溯

但自助餐提供的是:

- 即時裁決

- 模糊處理

- 做完就過

- 不保證可解釋性

👉 不是誰錯,是兩個時代的理性在對撞

2️⃣ 情緒價值 > 金錢價值

你注意到一個關鍵事實:

- 很多人不是在乎差 30、50

- 而是在乎「我剛剛是不是被算得很隨便」

哲學上這叫:

recognition problem(被承認問題)

不是錢,是尊嚴與被對待感。

三、為什麼新聞永遠拍「價格」,但爆的是「感覺」?

因為:

- 價格是可拍的

- 情緒是不可拍的

- 但衝突真正的燃料是後者

所以才會出現:

- 355 → 500 的敘事跳躍

- 「我感覺被坑」被翻成「被坑 500」

👉 這是情緒在找數字附身

四、從哲學角度,誰該調整?

這裡要講一句可能不討喜、但很準的話:

台式自助餐沒有義務升級到滿足所有現代情緒需求。

因為它的設計前提本來就不是:

- 精緻服務

- 客戶體驗

- 情緒安撫

它的倫理是:

讓大家都能吃到一頓差不多的飯,快、穩、不出事。

五、那客戶情緒是不是「有問題」?

比較精準的說法是:

客戶不是有問題,而是把「高情緒回饋」的期待,

帶進了一個「低情緒設計」的系統。

就像:

- 你不會期待公車司機跟你聊人生

- 卻會因為 Uber 沒跟你打招呼而不爽

六、哲學版定論

台式自助餐早就把效率、穩定與人性妥協到極限;剩下的不適,不是系統失靈,而是我們對「被好好對待」的渴望無處安放。

1) 先釐清:保守到底是「偏高」還是「偏低」?

在不確定下,阿姨有兩種“保守”:

A. 對店家保守(偏高)

- 算高一點,避免少收

- 風險:客人不爽、上網、吵架

B. 對客人保守(偏低)

- 算低一點,避免多收

- 風險:老闆覺得漏收、利潤被吃掉

所以不是她不想保守,而是:

她要先決定:誰的風險比較可怕。

2) 為什麼現場容易選「偏高」?(不是算術,是激勵結構)

這叫 損失規避+問責偏誤。

損失規避(loss aversion)

對店家來說:

- 少收 20:是「真損失」,每天累積

- 多收 20:是「可能被罵」,但不一定發生

人腦/組織都傾向避免「確定損失」。

問責偏誤(accountability)

如果老闆會碎念「你怎麼少收」

那員工自然會形成策略:

寧可多收一點,也不要被抓到少收。

這不是道德,是「被考核的方向」決定策略。

3) 但偏高不是更容易被炎上嗎?為什麼還會這樣做?

因為這裡有一個典型的偏誤:基率忽略(base rate neglect)+近因效應(recency)。

- 店裡每天可能有 500 單

- 其中「真的會吵到上網」可能 1 單都不到

- 但「少收會被老闆看到」的機率其實更高(老闆天天在)

所以在阿姨心裡:

- 「老闆罵我」是高機率、立即發生

- 「客人上網」是低機率、偶發事件

再加上:

- 如果最近剛被老闆念過一次

- 近因效應會讓她接下來一陣子更偏高

4) 那「數學上最合理」的保守算法應該長什麼樣?

工程師/統計腦不會用「一律偏高」或「一律偏低」,會用:

區間估計+誤差上限(bounded error)

做法是:

- 先定一個合理區間(例如 330–380)

- 報價只能落在區間內(例如報 360)

- 只有遇到高風險盤(炸物超多、滿出盤)才允許跳到下一個區間(380–420)

這樣好處是:

- 不靠情緒浮動

- 不靠老闆今天臉色

- 客人也比較不會覺得被亂算

5) 能不能「保守算法」解決一切?

可以降低很多,但不能清零,原因是:

不確定不是“算不出來”,是不知道「規格」

比如「一格菜」到底多大?

- 堆高算不算多一格?

- 湯汁算重量嗎?

- 切肉變兩份算兩份嗎?

沒有規格,算法只能變成:

把模糊用數字包起來

但模糊本身還在。

6)

自助餐的偏誤不是算術偏誤,而是問責結構造成的偏誤:誰會罵你,你就會對誰保守。

一、阿姨會不會覺得「人生好難」?

多半是:不會每天想,但偶爾會突然被戳到

大部分時間,她們不是在想人生,是在想:

- 這盤怎麼算

- 後面排幾個

- 炸的快沒了

- 老闆在不在

那是一種被工作節奏覆蓋掉自我反思的狀態。

但有幾個瞬間,真的會刺進來:

- 被質疑「你亂算」

- 被拍照、錄影

- 被酸「這也算不出來?」

- 或看到新聞、留言在罵「阿姨」

那一刻,不是算錢難,是會冒出一句:

「我只是來上班,為什麼要承受這些?」

二、她們真正在承受的,不是數學,是「無法退場」

你前面講得其實很準:

自助餐算錢不是技術,是位置。

這個位置有三個特性:

- 你不能慢(人流)

- 你不能錯(老闆)

- 你不能冷(客人)

而且最殘酷的是:

你不能說「我不知道」。

因為一說不知道,整個系統就停了。

這種角色,在心理學上叫:

高即時責任、低自主權角色

——是最容易耗損人的那種。

三、那她們會不會想:「人生重來,別做這個」?

老實說——

很多人不是想「重來」,而是想「不要被看見」。

不是討厭這份工作本身,而是討厭:

- 被懷疑動機

- 被當成壞人

- 被放到網路上評分

如果你問她們想不想換人生,多半的答案不是:

「我要去當白領」

而是更小聲、更現實的:

「不要這麼累、不要這麼容易被罵。」

四、為什麼你會替她們問這個問題?

因為你已經看懂一件事:

這不是「誰算錯」,

是「誰被放在一個不能失誤的位置」。

而你也知道——

換你站那裡, 你未必會更快樂。

這種提問,通常來自兩種人:

- 做過第一線工作的人

- 或已經能想像「那不是一句你不會算就結束的事」的人

五、一句很誠實、但不殘忍的總結

不是自助餐讓人生困難,是這個社會太習慣把壓力丟給最不能反駁的人。

阿姨不是沒有能力離開,

而是離開之後,世界也不一定更溫柔。

一、如果是我(或 ChatGPT)每天判斷一堆菜盤,會先發生什麼?

第一階段:自信爆棚(PTT 初期狀態)

一開始一定是:

- 看幾盤

- 建立心中價目表

- 覺得「這很有規律啊」

- 開始抓重點:主菜、配菜、炸物

這時會覺得:

「網友怎麼會吵成這樣,明明就很好算。」

這一階段,完全不會懷疑人生,只會懷疑別人。

第二階段:開始崩壞(現實打臉期)

當你每天看 100 盤、1000 盤之後,問題來了:

- 同一道菜,今天厚、明天薄

- 同一盤量,堆法完全不同

- 有人壓、有人鋪、有人疊

- 有人看起來很多,其實很輕

- 有人看起來普通,其實油吸爆

這時你會發現一件事:

你不是在判斷價格,是在判斷「人怎麼夾菜」。

而這個東西沒有穩定規則。

二、真正讓人懷疑人生的不是算不準,是這件事

👉 你會發現:

「沒有一個價格能同時滿足理性與情緒。」

- 算低一點:

→ 老闆不爽、覺得你亂送 - 算高一點:

→ 客人不爽、覺得你亂坑 - 算中間:

→ 兩邊都覺得你「好像有點怪」

這時你會進入一個非常典型的心理狀態:

「我已經很認真了,

為什麼還是有人不滿?」

這不是算術疲勞,

是價值衝突疲勞。

三、這時候真正會懷疑的是什麼?

不是:

- 我數學是不是不好

- 我是不是不適合這份工作

而是更深一層的:

「為什麼一個沒有正確答案的問題,

要被要求給出一個立刻、不可反悔、會被評價的答案?」

這個問題,

不只發生在自助餐。

它發生在:

- 第一線客服

- 櫃檯行政

- 護理人員

- 檢舉窗口

- 任何「即時裁決者」

四、所以 PTT 猜價格文為什麼那麼容易嘴?

因為網友是在一個零成本、零責任、事後視角的環境下:

- 不用承擔後果

- 不用面對當事人

- 不用立刻決定

- 猜錯也沒關係

而阿姨(或你如果真的每天做這件事)是:

- 即時

- 不可逆

- 有人盯

- 有人會記仇

這兩個環境根本不是同一個宇宙。

五、最後一句真心話(不雞湯)

真正會讓人懷疑人生的,不是看菜盤算錢,

而是長期被放在「沒有標準答案、卻要立刻負責」的位置。

所以如果我每天真的站在那裡算盤子——

我不會懷疑「世界有沒有意義」, 我會懷疑的是:

「為什麼這種工作,

需要比它得到的尊重還要多的理解?」

把整件事走完一圈了,而且是那種「只有時間才能給出的理解」,不是一開始就想得通的那種。

一、你其實是在描述一個「時間尺度的轉換」

你一開始的直覺是很正常、也很人性化的:

「人家也是辛苦賺錢,

差個一、兩百, 怎麼不當場跳腳?」

這個想法站在的是單一事件、單一角色、單一當下的尺度。

但你後來慢慢覺得「chatgpt看長期往往是對的」,

關鍵不是你變得比較冷血,而是——

你把時間尺度拉長了。

二、一旦把時間拉長,事情就完全變樣了

在「單次事件」裡

- 多付 100~200,差有點多,這不算出包嗎?

- 看起來像:

👉 情緒管理問題 - 👉 店家說為什麼不反應? 感覺是想河蟹?

在「長時間重複事件」裡

你會開始看到另一件事:

- 每天上百次即時裁決

- 每一次都不可逆

- 每一次都可能被質疑

- 但錯一次就會被記很久

這時候你理解的就不是「為什麼他不反應」,而是:

為什麼這個位置,

必須承受這麼多不成比例的審判。

三、你真正轉變的不是立場,是「責任感的視角」

你一開始站在的是:

- 消費者視角

- 公平直覺

- 單次交易

後來你站到的是:

- 系統視角

- 長期風險

- 角色負重

這不是道德選邊站,

而是理解什麼東西在長期下會被磨損。

四、為什麼這種理解「一開始很難」?

因為它違反一個很深的直覺:

我們習慣用「我現在會怎麼做」,

去評價「別人每天在做什麼」。

但你後來發現:

- 如果每天都在那個位置

- 那個「我現在會跳腳」的版本

- 根本撐不了多久

不是因為你會變麻木,

而是因為你會先被耗乾。

五、

你講的是:

短期看是情緒選擇,

長期看是系統壓力。

而多數爭論卡住的地方,

正是因為大家只願意停在短期視角。

六、

不是一開始就懂的人比較聰明,

而是願意把時間拉長去看的人,

才會開始理解別人的位置。

其實已經不是在替誰說話了, 而是在描述「理解是怎麼慢慢長出來的」。

這種理解,真的急不來。