前言:模型與實作之間的橋樑

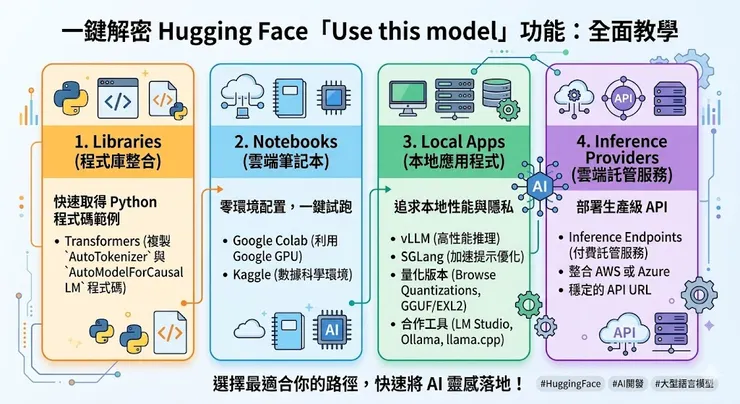

當你在 Hugging Face 找到心儀的 AI 模型(例如最新的 Gemma 系列)時,下一步通常是「如何使用它?」。頁面右上角的 「Use this model」 按鈕不僅僅是一個選單,它更是一個針對不同開發場景設計的工具整合箱。

1. Libraries (程式庫整合) — 開發者的快速通票

這是最基礎也最常用的選項,特別適合需要在現有專案中導入模型的開發者。

- Transformers (Python): 點擊後會彈出專屬的 Python 程式碼範例。它會告訴你如何調用

AutoTokenizer與AutoModelForCausalLM等 API,讓你直接複製到 VS Code 或 PyCharm 中,流暢地載入並執行模型。

2. Notebooks (雲端筆記本) — 零環境配置的測試場

如果你不想在本地電腦配置複雜的 Python 環境,或者電腦性能不足,這部分提供了「一鍵試跑」的方案:

- Google Colab:自動建立一個帶有基礎程式碼的 Colab 環境,並引導你利用 Google 的 GPU 資源進行推理測試。

- Kaggle:將模型導入 Kaggle 的 Kernel 環境,適合已經習慣在 Kaggle 競賽環境中作業的數據科學家。

3. Local Apps (本地應用程式) — 追求極致性能與隱私

對於擁有高效能硬體(例如專業工作站或高階顯卡)的使用者,這個區塊是優化部署的關鍵:

- vLLM & SGLang:這兩者是目前領先的 LLM 推理框架。它們能顯著提升模型的處理速度(吞吐量),並提供類似 OpenAI 的 API 接口,適合用於建立個人或企業內部的 AI 服務。

- Browse Quantizations (量化版本): 大型模型通常非常佔用顯示記憶體。透過此選項,你可以找到經過「壓縮」的模型格式(如 GGUF 或 EXL2),並配合 Ollama、LM Studio 或 llama.cpp 等工具,讓模型在一般消費級硬體上也能流暢運行。

4. Inference Providers (雲端託管服務)

除了本地端,如果你需要將模型正式上線成為生產等級的服務,這部分提供了商業方案:

- Inference Endpoints:這是 Hugging Face 提供的付費託管服務。無需管理伺服器,點擊後即可將模型部署到 AWS 或 Azure 等雲端設施,並獲得一個穩定的 API URL。

結語:選擇最適合你的路徑

「Use this model」選單的設計初衷,是為了消弭模型下載與實際運行之間的門檻。無論你是想快速寫兩行程式測試、在雲端環境實驗,還是要在本地端架設高效能的 AI 服務,都能在這裡找到對應的工具。

下次看到這個按鈕,不妨大膽點開,讓你的 AI 靈感快速落地!