我想要一天分享一點「LLM從底層堆疊的技術」,並且每篇文章長度控制在三分鐘以內,讓大家不會壓力太大,但是又能夠每天成長一點。

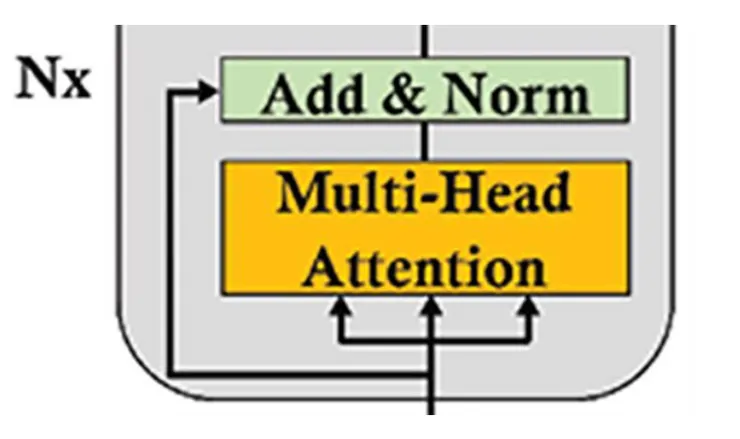

講完 Transformer 之 Encoder 架構中的 Embedding 與 Positional Encoding 部分,現在進入 Multi-Head Attention 部分,其架構如下:

我們現在擁有項目為:

- 一段句子中,每個字各別的 Embedding

- 一段句子中,每個字各別的 Positional Encoding

- 一段句子中,每個字上述兩者的合成向量

想像一段句子:「The cat sat on the rug and it was dry-cleaned」,我想要陳述這段句子的各種關係,比方說:

- 「cat」與「sat」

- 「cat」與「rug」

- 「rug」與「dry-cleaned」

- 等等以此類推

現在想法是「上述一種關係」我就用一個 Attention 機制來進行追蹤,但是我有很多關係組怎麼辦,那就自然冒出 Multi-Head Attention 這個機制了,而且我們之前說一個 Attention 模組的運算是矩陣乘積的組合,那我現在有 Multi-Head Attention,就可以好好利用 GPU 的平行運算機制了。