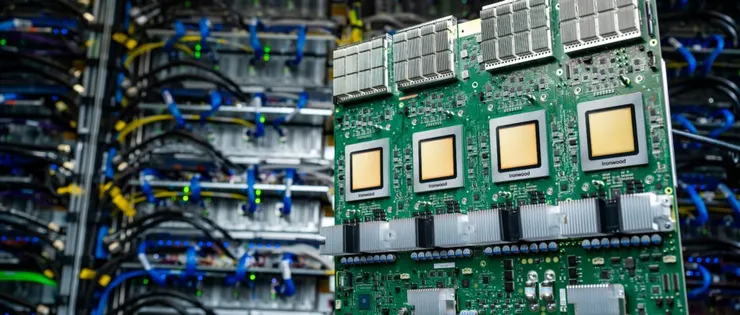

Google 在 2025 年 Cloud Next 活動中推出了第七代 TPU,代號 Ironwood,首款專為推論優化設計的 TPU 系列。

在進入 TPU(Tensor Processing Unit)之前,先理解 Tensor 這個字在 AI 世界裡的意義。Tensor 是數學中的張量(Tensor),是一種比向量(vector)和矩陣(matrix)更廣泛的資料結構。舉例來說:

- 一個數字是 0 階 Tensor(scalar)

- 一組數字(如一維列表)是 1 階 Tensor(vector)

- 一張灰階圖(像素點組成的 2D 矩陣)是 2 階 Tensor

- 一段影片、或是多張彩色圖像的堆疊,可以是 3 階或更高階 Tensor

從開源 TensorFlow 到專屬 TPU

2015 年,Google 開源了 TensorFlow,開啟了一場深度學習工具鏈的革命。表面上,這是對學術社群與開發者的善意釋出;實則背後隱藏一場硬體佈局的伏筆。

TensorFlow 的開源,讓它快速成為全球最主流的 AI 框架之一。而 Google 自家的 AI 晶片 TPU(Tensor Processing Unit),正是為了高效執行 TensorFlow 而量身打造的專用晶片(ASIC)。當全球開發者都在使用 TensorFlow 開發 AI 應用時,也自然地被導向了 Google Cloud,因為只有 Google 提供最適合跑 TensorFlow 的硬體:TPU。

這不是單純的軟體免費硬體收費策略,而是讓軟體規模反向拉高硬體效益的典型戰略。正如當年微軟將 Windows 綁定 Office,壟斷生產力軟體市場;Google 是透過讓 AI 社群使用 TensorFlow,默默建立其在 AI 雲端運算的不可替代性。

為什麼不用 GPU?

理解 TPU 的價值,要先比較三種主要運算架構

- CPU(中央處理器):通用性高、但執行深度學習效率不佳

- GPU(圖形處理器):支援高度平行運算,適合神經網路訓練與推論

- TPU(張量處理器):為 TensorFlow 優化設計的專用晶片(ASIC),效能與能效優於 GPU

以圖像辨識或語音識別為例,AI 模型會用到大量矩陣運算(如矩陣乘法),這些運算正是 Tensor 的內部操作。GPU 雖然也擅長這類平行計算,但仍是設計給圖形處理、非 AI 最佳化。TPU 是 Google 自行設計、專為 TensorFlow 編譯器與運算邏輯設計的晶片,它放棄了 GPU 的部分彈性,換取了極致效率與成本優勢。簡言之

TPU 是「不為別人跑程式,只為跑好 TensorFlow」而生的機器

此外,TPU 設計為 Google Cloud 專屬產品,開發者若要使用 TPU 來訓練或部署模型,就必須選擇 Google 雲端,無法在 AWS 或 Azure 上運行,這也成為 Google 雲端的一大差異化武器。

(延伸閱讀:CPU 是怎麼做出來的?)

模組化 vs 整合化,Google 與 Groq 的兩條 AI 晶片路

Google 對 TPU 的佈局,是 AI 時代的Apple 策略:自製晶片、自有軟體框架、自營雲端平台,形成從模型訓練、推論、部署到產品的全鏈整合。但這樣的整合策略並非唯一解。Google TPU 團隊中的多位核心工程師,離職後創立了新創公司 Groq,採取截然不同的思維。

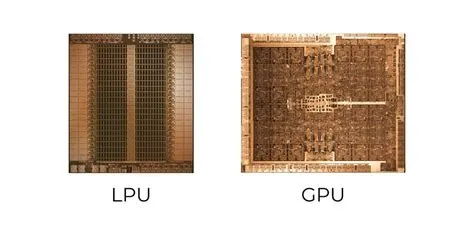

LPU 與傳統 GPU 晶片的外觀對比。

Groq 設計的 LPU(Language Processing Unit)並不專屬某個 AI 框架,而是針對大量小運算、超低延遲、高吞吐量的應用情境(如自駕車、邊緣裝置等)最佳化。這代表它走的是更模組化、更開放的路線。這也讓 Groq 被形容為AI 時代的 ARM(安謀控股公司) 角色:不做整合型產品,而是設計可授權、彈性強的處理器架構,讓其他公司整合成自己的 AI 解決方案。這就回到一個經典的經濟學與管理問題:在技術初期,整合化是否一定優於模組化?

整合優於模組化(技術導向、體驗至上)

- 思維重點:產品性能未過剩時,整合能壓榨極致效能

- 策略方向:從晶片、模型、雲端、應用全面整合

- 適用場景:新興技術、高性能需求(如手機初期)

模組化優於整合(開放導向、生態擴張)

- 思維重點:技術成熟後,彈性與生態規模更重要

- 策略方向:提供標準化元件供整合,形成多元應用

- 適用場景:服務平台、模型 API、AI 開發工具鏈等

TPU 就是 AI 整合化的典範,而 Groq 代表模組化開放的路線。這兩種模式的競爭與互補,將形塑 AI 晶片產業的未來格局。

Google 是 AI 的 Apple?

當我們用 iPhone 的 Siri,或 Android 上的 Google Assistant 時,我們其實已在與整合化 AI 系統互動。特別是 Google,從 TPU(晶片)、Gemini(大模型)、到 Pixel(硬體終端),構成一條自上而下的 AI 整合鏈。

當市場對體驗的要求還在快速提升時,只有掌握所有環節,才能持續拉開差距。

然而,Google 與 Apple 的差異也明顯:

- Apple 銷售的是體驗與硬體;Google 多數服務仍是免費

- Apple 整合晶片是為了 iPhone;Google 推出 TPU 卻不積極打造 Pixel 作為旗艦應用場景

- Apple 經得起硬體更新的挑戰;Google 的整合 AI 策略尚未證明其商業動能

若 Google 未來敢於將 Pixie(AI 助理)深度綁定 Pixel,並強化行銷、通路、產品迭代,也許真有可能再造一個 AI iPhone 時刻。

各家 AI 策略差異

TPU 是科技戰爭的棋子

TPU 不是為了賣給你我,而是 Google 用來改寫雲端、改寫 AI 開發流程、甚至可能重構終端裝置體驗的策略性基礎建設。在 AI 的時代,晶片不只是成本競爭,而是能力邊界的定義工具。Google 的做法像是重現 Apple 在 iPhone 時代的整合革命,只是這次,戰場不再是掌中裝置,而是你與 AI 互動的每一次對話。

未來幾年,我們要觀察的,不只是 TPU 效能能否超越 GPU,而是整合策略是否能撼動雲端市場結構,甚至引發新的使用者體驗轉移。如果你相信 AI 不只是工具,而是即將重構人類資訊結構的操作系統,那麼 TPU,將不只是個晶片,而是 Google 搶奪 AI 主權的開場白。