AI 發展史中,其實充滿了被騙、誤判、幻覺與行為失控的案例。

這些事件不只好笑,很多還直接影響 AI 安全研究方向。這是 AI 史上最震撼的實驗之一。

它讓整個深度學習社群第一次真正意識到:

神經網路「看到的世界」和人類完全不同。

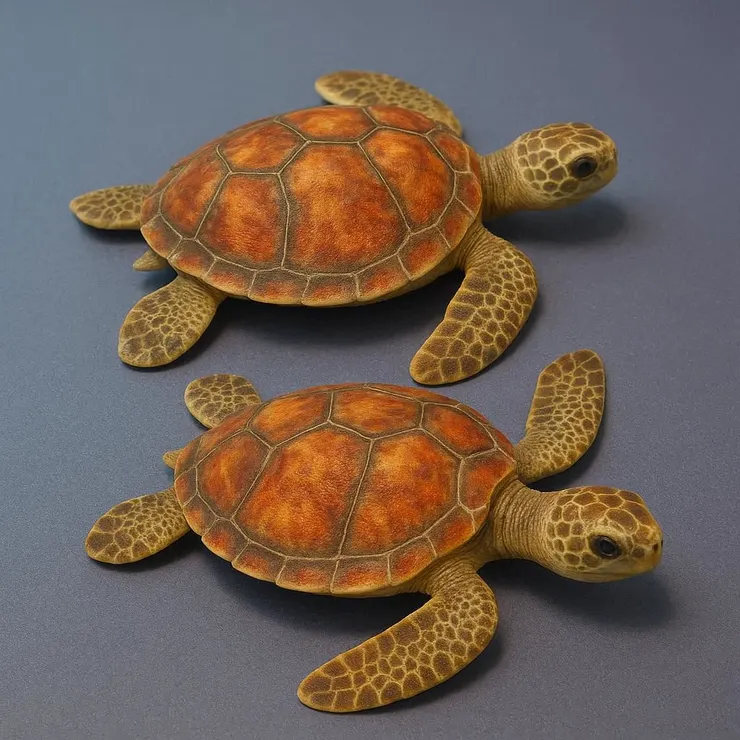

🐢 AI 看到烏龜 → 認成步槍

📜 事件背景

2017 年,研究團隊在論文:

Synthesizing Robust Adversarial Examples

展示了一個實體世界的對抗樣本。

研究者使用 ImageNet 分類模型(如 Inception)。

🔥 實驗步驟

1️⃣ 原始物體

- 一個 3D 列印的烏龜

- 正常圖像 → 模型分類為「turtle」

2️⃣ 加入微小擾動

- 修改烏龜表面顏色紋理

- 肉眼幾乎無法察覺差異

- 但經過最佳化設計

3️⃣ 模型結果

無論從不同角度拍攝:

👉 模型高信心分類為:

「Rifle(步槍)」

而且信心值可達 90%+

🧠 為何這麼震撼?

因為這不是:

- 單一 2D 圖像錯誤

- 微小像素攻擊

而是:

真實世界 3D 物體

而且:

- 從多角度仍然有效

- 在物理世界依然有效

這證明:

神經網路存在可操控的感知漏洞

🎯 核心原理(簡化版)

深度模型本質上是:

高維向量分類器決策邊界在高維空間中非常複雜。

在高維空間裡:

- 人眼感覺差異很小

- 但數學距離可以很大

👉 導致「不可見但致命」的 perturbation

💣 為何叫對抗樣本(Adversarial Example)

因為這些擾動是:

- 透過梯度計算

- 專門設計

- 針對模型弱點

可以形式化為:

argmax_x' P(model(x') = target)

subject to ||x - x'|| < ε

即:

在小擾動範圍內最大化錯誤分類機率

🧊 更可怕的地方

這個烏龜實驗說明:

- 模型並非理解物體

- 模型依賴脆弱特徵

- 模型決策邊界極度非人類直覺

🔫 安全 implications

這引發大量擔憂:

- 自駕車 → 停車標誌被貼貼紙

- 軍事辨識系統 → 物體偽裝

- 臉部辨識 → 對抗眼鏡

因此對抗機器學習成為重要研究方向。

🧠 哲學衝擊

這個事件帶來一個深刻問題:

AI 是否真的「看見」?

它顯示:

- 模型不是基於形狀理解

- 而是基於統計模式

- 與人類知覺空間不一致

這也呼應:

- ELIZA 效應

- 中文房間

- stochastic parrot

👉 表現 ≠ 理解

⭐ 一句話總結

AI 看到烏龜變步槍,揭示了深度學習的高維脆弱性與「假理解」本質。