論文簡介

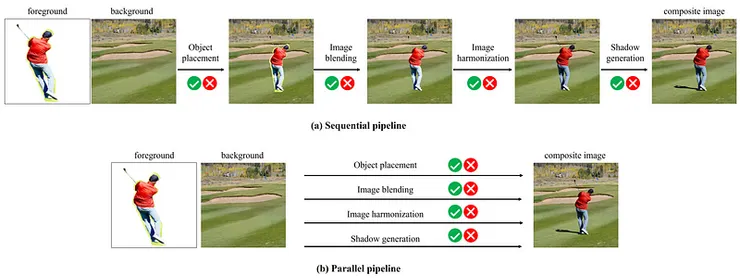

本文主要介紹影像合成任務的歷史解決方案,第一作者是由上海交大的教授Li Niu(牛力)撰寫。圖像合成是個複雜的電腦視覺任務,除了透視、物品的合理大小&位置還有像是光影這類型複雜的子任務需要去解決,像是下方圖片是論文所提供的一個例子。

多個子任務做法

其實之前已經有很多人去解決過相關的任務,接下來分別介紹之前其他人的解決方案。

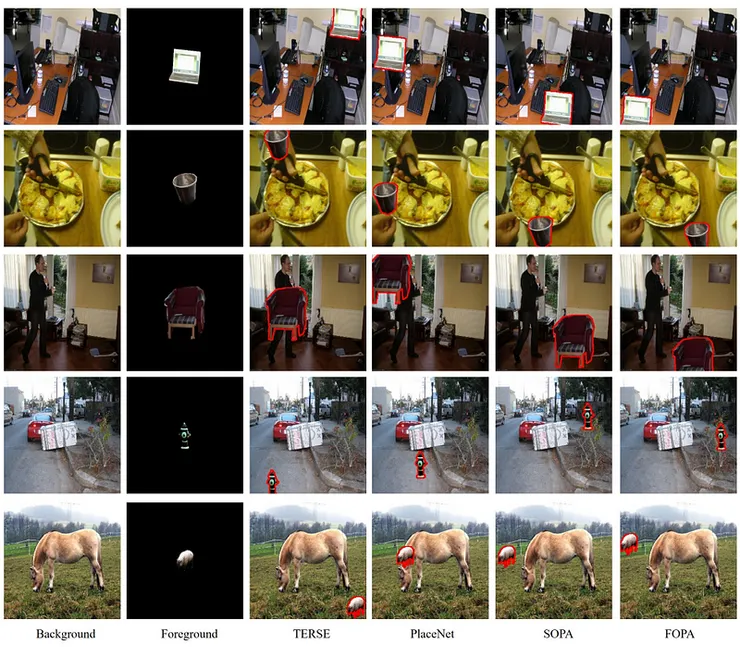

📌物品置入(Object Placement)

物品置入涉及根據背景為置入物品找到合適的位置、大小和方向。

🐌傳統方法

過去的方法通常利用固定規則來確定物品的適合位置。這種方法對某些特定任務可能特別高效,但無法廣泛應用。

(EX.Learning to Segment via Cut-and-Paste)

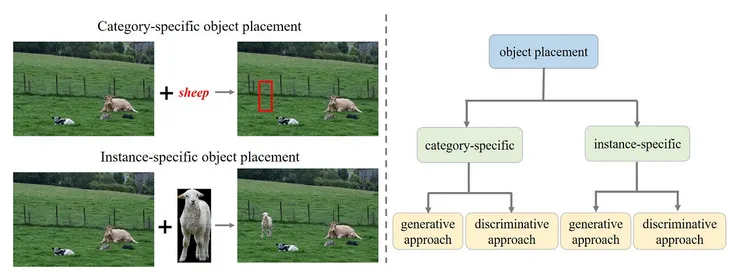

🐛深度學習方法

進階一點的使用深度學習方式利用神經網路去做預測合理的位置,這些方法可以粗略分為兩種:1.特定類別 2.特定例子。舉個例子。

1.特定類別(category-specific object placement):根據背景圖像以及提供的物品類別去預測邊界框(Bounding Box),但這類型的方法相同的物品類別在不同的例子上可能會不適合。2.特定例子(instance-specific object placement methods):這種方法會考慮物品的特徵與背景之間的關係。

📌影像混合(Image Blending)

影像混合的目標在於平滑化前景以及背景的過渡。讓合成的結果看起來更加自然。

🐌傳統方法

像是Alpha混合或是Laplacian pyramid混合的方式,會需要去手動調整過渡邊緣。

🐛深度學習方法

針對多個深度學習方法去做實驗發現利用Poisson image blending可以較好的平滑化邊界,但是卻會扭曲前景之畫面。因此像是GP-GAN就利用Content loss 的方式去平衡原始圖像。

驗證方法:利用預訓練模型計算真實感分數&利用真人投票

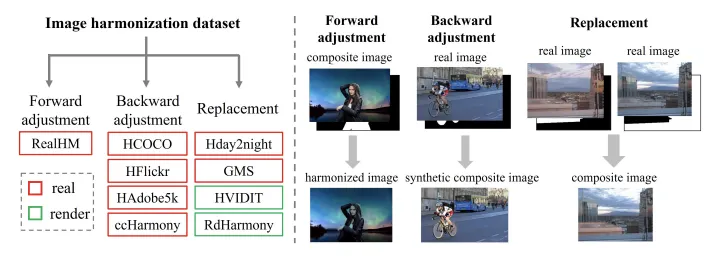

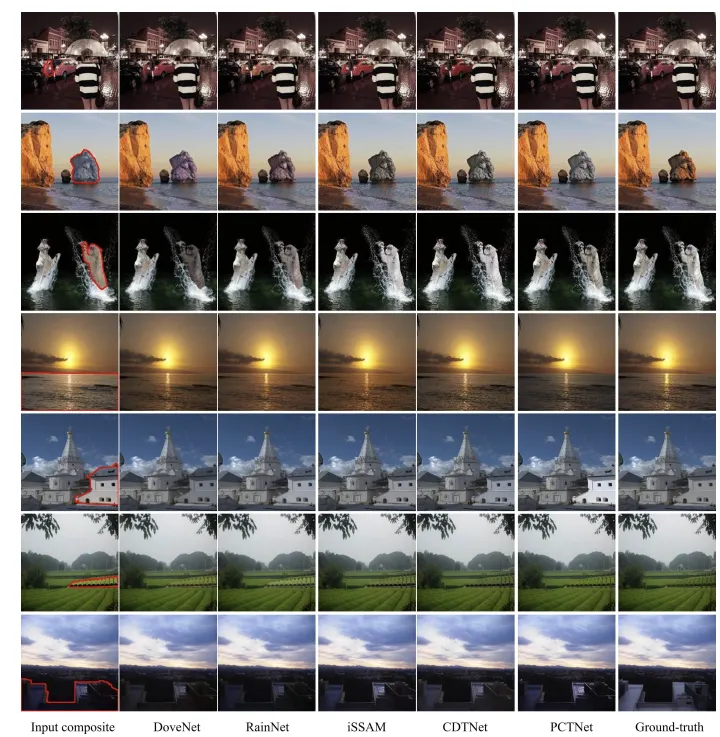

📌圖像協調(Image Harmonization)

圖像協調的目的是調整合成前景的顯示效果,使其在光照、顏色和色調上與背景匹配,解決因拍攝條件不同(如照明和相機設置)造成的不一致性。

在論文中總共說明了兩種主要的作法

🐌基於渲染的作法:根據光影條件來去作調整,但通常透過去判斷光影&3D材質的方式去做,這樣的作法不僅複雜且昂貴,對於應用於現實生活中也不方便。

🐛非基於渲染的作法:基於深度學習&統計方法去調整顏色,以使得前景的顏色和背景匹配。

像是使用CNN&GAN的方式去細化前景,使其自然融入

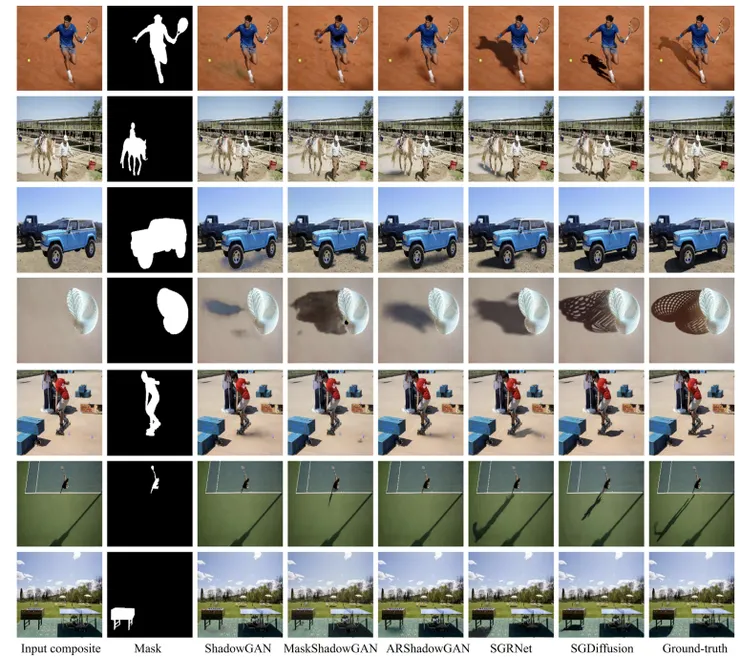

📌陰影生成(Shadow Generation)

如文字敘述所示,目標是想要為前景物品創造真實的陰影,以增強圖像之真實感。與圖像協調相似分為兩種方式去做實現:

🐌基於渲染的作法:基於場景幾何資訊&光影去對物品做渲染,但這樣的作法會遇到幾個問題。

(1)資料收集困難:像是許多資料往往需要用戶手動輸入或是透過複雜的測量和估計過程獲得,往往繁瑣且難以實現的。(2)估計的不準確性(3)計算成本高昂(4)依賴專業知識(5)通用性問題

🐛非基於渲染的作法:利用深度學習的像是自動編碼器或像是GAN的深度學習架構來預測陰影遮罩。(通常基於有無陰影的資料去進行訓練。)

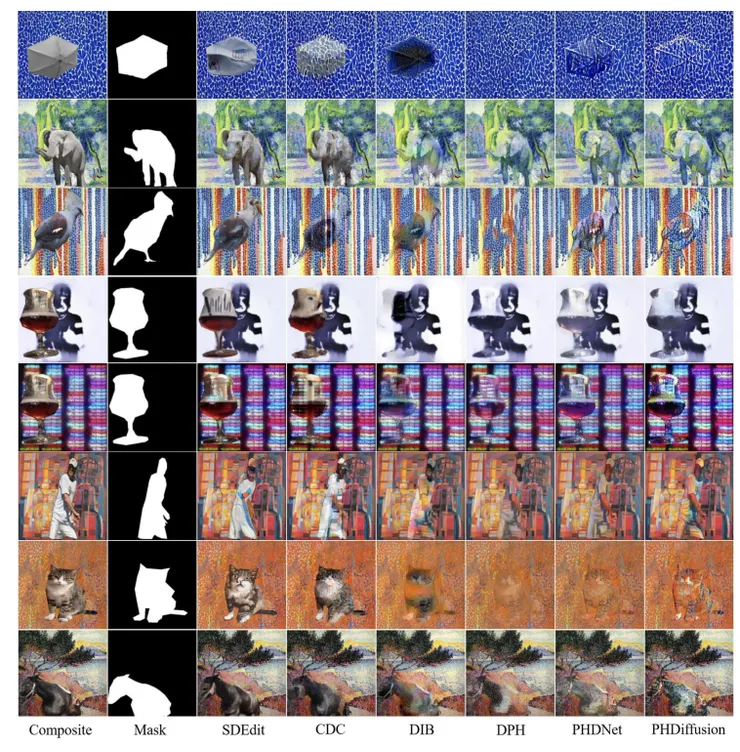

一體式整合模型

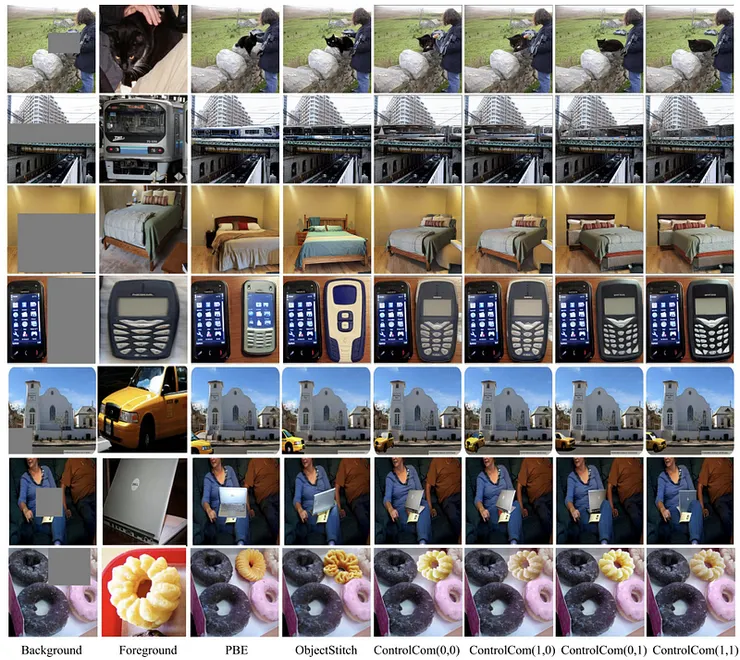

隨著diffusion模型的流行,這類型的任務越來越熱門,前面講解的會是將合成影像的任務拆分成多個子任務,而接下來介紹的會是一體化的模型來完成此任務。

目前的方法多數使用深度學習的方式去做,主要其實分為兩大類。token-to-object&object-to-object。

🐌token-to-object:將輸入數據直接映射到相應的物體或場景,通常會利用預訓練模型針對範例圖片去做微調(fine tune)

🐛object-to-object:通常會利用大量的(前景&背景&原始圖像)對照數據來去訓練diffusion模型,首先前景為從原始圖像去做裁剪,接著將背景圖像&邊界框的遮罩和帶噪音之圖像串聯去做輸入,而前景通常會透過交叉注意力機制(Cross Attention Cross Attention)去注入模型中。

📑Kulal et al. 專注於人類生成 link📑Chen et al. 利用高頻資訊提升前景的真實性 link

📑Zhang et al. 提供了整體&局部融合 link

相較於前面提到的將任務拆成多個子任務,統一模型會更加的簡潔,但相對的也犧牲的可控性。