找到路、做出預測,讓 AI 像個聰明的導航員。但如果它還能同時看懂眼前的景象並猜你下一步想接觸的內容呢? 這需要兩種核心能力:Convolutional Neural Network(CNN,卷積神經網路) 與 Collaborative Filtering(協同過濾)。一個是機器的視覺,支撐它的 image recognition(圖像辨識) 能力;另一個是它的直覺,決定 recommendation accuracy(推薦精準度) 的高低。

機器眼中的世界:亮度轉化為數字

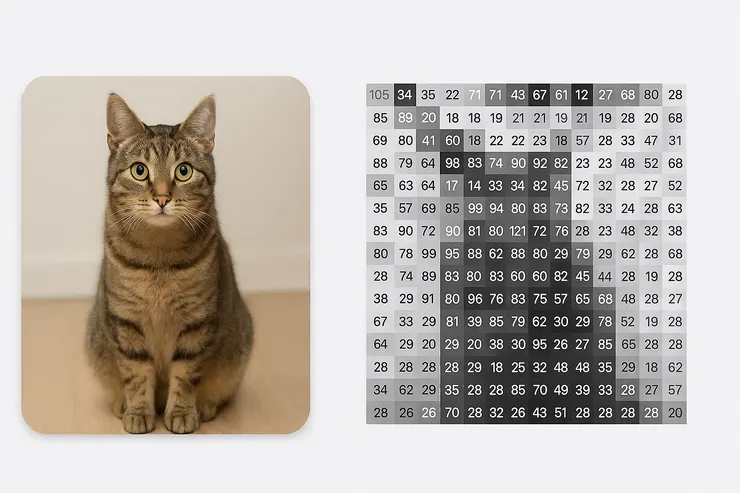

我們看照片時會先注意顏色、形狀、距離感;而機器看圖片,看到的卻是一張龐大的數字表,每個像素的亮度與顏色,被拆解成紅、綠、藍三個通道的數值,範圍通常是 0 到 255。 一張 1920×1080 的彩色照片,對它來說就是一個三維陣列, 裡面有超過六百萬組數字。CNN 的任務,就是從這些數字矩陣中,找到模式。卷積層(Convolutional Layer) 像在數字表上滑動小小的濾鏡(kernel),計算局部像素的加權和,以檢測垂直邊緣、斜線紋理或顏色漸變等特徵。 每個濾鏡都專注在不同的特徵,而這些濾鏡的權重,不是人手設定的, 而是透過訓練自動學得。卷積後,會接上激活函數(Activation Function),如 ReLU,將負值歸零,引入非線性(non-linearity), 讓模型能處理比直線關係更複雜的模式。 再經過池化層(Pooling Layer),如最大池化(Max Pooling),取區域最大值以保留關鍵特徵, 同時降低計算量、提升對位置變化的容忍度。

在醫療影像中,這樣的流程可以從 MRI 或 CT 影像的數值矩陣裡,層層萃取出器官輪廓與異常組織的形狀,最終讓模型自動圈出疑似腫瘤的位置。這就是 AI 的圖像辨識。

在行為矩陣中找相似:協同過濾

如果卷積神經網路是在看,那協同過濾就是在聽,聽取不同用戶的行為,找出潛在相似性。它的數據結構是用戶-物品矩陣(User-Item Matrix):行列分別代表使用者與內容,格子裡是評分、觀看紀錄或購買行為。 這張矩陣往往非常稀疏,因為沒有人看過所有影片或買過所有商品。協同過濾有兩種主要方法

- 記憶型(Memory-based):直接計算用戶與用戶(User-User)或物品與物品(Item-Item)的相似度,常用餘弦相似度(cosine similarity)或皮爾森相關係數(Pearson correlation)。

- 模型型(Model-based):透過矩陣分解(SVD、ALS)將用戶與物品映射到低維潛在空間,用隱向量(latent vector)預測缺失的評分。

Recommendation accuracy(推薦精準度) 取決於演算法的相似度計算是否抓對重點,以及資料的完整性。當資料不足時,系統常會結合內容特徵,而卷積神經網路可以在這裡提供幫助,從影片截圖或商品照片中抽取視覺特徵, 補足行為數據的不足。

當看懂與推薦融合

把卷積神經網路與協同過濾結合,意味著系統同時理解內容的結構與人的偏好

- 在醫療系統中,卷積神經網路負責檢測影像病灶,協同過濾則比對相似病例的最佳治療方案與預後結果。

- 在影音平台,卷積神經網路從影片封面與畫面截圖提取風格與類型特徵,協同過濾再基於相似觀影行為做最終排序。

這種結合讓推薦系統不只是根據別人的選擇,而是同時依據內容的本質,大幅提升推薦精準度。

走向靈活與公平

當 AI 既能像醫生一樣從影像數字中萃取關鍵細節,又能像老朋友一樣猜你喜好,它就不只是工具,而是決策夥伴。 但光有視覺與直覺還不夠, AI 的判斷過程還需要一個靈活的開關, 能在不同情境下調整反應,就像音樂中的調音旋鈕,或鏡子反射的亮暗變化。這就是激活函數(activation function) 的角色,它讓神經網路擺脫僵硬的直線關係(non-linearity), 學會處理複雜模式。然而,當這些開關被用在招聘、信貸等高影響力領域時, 若背後數據本身存在偏見(algorithmic bias), 模型輸出的結果也可能不公平。下一篇,拆解激活函數如何賦予 AI 靈活性, 反而放大了數據的偏見,我們該怎麼辦?