嗨 我是CCChen

有報考11/08 iPAS AI應用規畫師-中級 第二場考試

分享一些初步整理資料, 供準備方向參考:

涵蓋 科目一~三 的核心知識點、常考題型範例與關鍵字。以下是精華版速查表:

📘 iPAS AI中級備考速查表

科目一:人工智慧技術應用與規劃

核心知識點

- NLP:分詞、POS 標註、NER、WSD、BERT(上下文動態詞向量)、Transformer

- 電腦視覺:CNN、YOLO 物件偵測、資料增強

- 生成式AI:GAN、Diffusion、ChatGPT 應用、Prompt Engineering

- 多模態應用:CLIP、跨模態檢索

- 導入規劃:痛點分析、KPI設計、AI導入流程(PoC → 導入 → 監控)

- 風險治理:倫理、偏見、公平性、隱私保護

常考題型範例

- NER 任務辨識文章中的人名、地名

- BERT 同字不同語境 → 動態嵌入(不同向量)

- 客服系統大規模並行 → Transformer 架構

- 自駕車物件偵測 → YOLO

關鍵字

NLP、BERT、Transformer、YOLO、GAN、痛點分析、KPI、AI倫理、公平性

科目二:大數據處理分析與應用

核心知識點

- 統計分析:Z-score、偏態、中位數、CV(變異係數)

- 機率分布:常態、Poisson、Binomial、t 分布

- 資料處理:ETL、Data Lake、Data Warehouse、資料治理

- 工具:Hadoop、Spark、NoSQL

- 應用:異常偵測、推薦系統、資料視覺化

常考題型範例

- 偏態分布時 → 中位數較能代表中心位置

- 右偏資料 → log transformation 轉常態

- Poisson:λ=事件率×時間範圍

- 高維資料 → PCA 降維處理共線性

關鍵字

Z-score、Poisson、常態分布、ETL、Data Lake、資料治理、PCA、Spark

科目三:機器學習技術與應用

核心知識點

- 數學基礎:機率/統計、線性代數、梯度下降、交叉熵

- ML基礎:監督學習 / 非監督學習 / 強化學習

- 常見演算法:Linear Regression、Logistic Regression、SVM、Decision Tree、Random Forest、KNN、ANN、CNN、RNN、Transformer

- 建模流程:資料清理 → 特徵工程 → 模型選擇 → 訓練/驗證/測試 → 超參數調校

- 模型評估:Accuracy、Precision、Recall、F1-score、ROC/AUC

- 治理:偏差與公平性、資料隱私、模型漂移

常考題型範例

- ROC 曲線 → 描述 TPR 與 FPR 的變化

- 病檢陽性率題 → Bayes 定理後驗機率(不會接近 100%)

- 高維共線性 → PCA 降維

- 不平衡資料 → AUC 評估較佳

- Ridge Regression 解決共線性;Lasso Regression 可做特徵選擇

關鍵字

Gradient Descent、Cross Entropy、ROC/AUC、Bayes、PCA、Overfitting、Regularization (L1/L2)、Dropout

📑 考前速記策略

- 科目一:模型 + 應用場景(BERT、YOLO、GAN、AI治理)

- 科目二:統計 + 大數據架構(Z-score、Poisson、ETL、Spark、PCA)

- 科目三:演算法原理 + 評估方法(Linear/Logistic、SVM、Random Forest、ROC/AUC、Bayes)

📘 iPAS AI中級核心考試知識點 (進階 40 條)

🔹 A. AI技術與應用 (科目一重點)

- 自然語言處理 (Natural Language Processing, NLP) 應用:Chatbot、情感分析、機器翻譯。 解說:讓機器理解/生成語言,包括分詞、詞性標註、NER、語義分析。

- 詞向量 (Word Embeddings: Word2Vec, GloVe, BERT) 應用:語意搜尋、問答系統。 解說:將文字轉換成向量表示;BERT 可產生上下文動態詞向量。

- Transformer 架構 應用:大型語言模型 (LLMs) 如 GPT、翻譯。 解說:自注意力 (Self-Attention) + 多頭機制,支援長距依賴與並行運算。

- 電腦視覺 (Computer Vision, CV) 應用:影像分類、物件偵測、自駕車。 解說:CNN 提取特徵,YOLO/Faster R-CNN 可同時輸出位置與標籤。

- 生成對抗網路 (GAN, Generative Adversarial Network) 應用:圖像生成、Deepfake。 解說:生成器 vs 判別器對抗學習,提升生成內容真實度。

- 擴散模型 (Diffusion Models) 應用:Stable Diffusion 圖像生成。 解說:透過逐步「去噪」學習影像分布,生成高品質樣本。

- 多模態 AI (Multimodal AI) 應用:CLIP (圖文比對)、視覺問答 (VQA)。 解說:整合文字、影像、聲音等多模態資料進行推理。

- AI 導入流程 (AI Implementation Process) 應用:企業 AI 專案規劃。 解說:痛點分析 → KPI 設計 → PoC → 導入 → 監控。

- KPI 與效益量化 (KPI & ROI for AI) 應用:衡量 AI 導入成效。 解說:Precision、Recall、F1、ROI,結合財務/效能雙指標。

- AI 風險管理 (AI Risk Management) 應用:避免專案失敗。 解說:數據品質風險、倫理風險、跨部門溝通風險。

🔹 B. 大數據處理與資料分析 (科目二重點)

- ETL 流程 (Extract, Transform, Load) 應用:資料倉儲建置。 解說:抽取 → 清理/轉換 → 載入,確保資料可用性。

- 資料湖 (Data Lake) vs 資料倉儲 (Data Warehouse) 應用:湖儲非結構化,倉儲決策分析。 解說:Data Lake 原始儲存,DW 經結構化設計。

- Hadoop 生態系 (HDFS, MapReduce, YARN) 應用:分散式大數據處理。 解說:MapReduce 任務分散 + HDFS 分布式存儲。

- Apache Spark 應用:即時流處理、批次運算。 解說:基於記憶體運算,比 Hadoop 快。

- NoSQL 資料庫 (MongoDB, Cassandra, Redis) 應用:高效存取、非結構化資料。 解說:支援水平擴展,靈活結構。

- 資料治理 (Data Governance) 應用:合規與品質管理。 解說:確保資料一致性、完整性、可追溯性。

- 資料隱私 (Data Privacy) 應用:醫療/金融個資保護。 解說:去識別化、差分隱私、加密。

- 敘述統計 (Descriptive Statistics) 應用:平均數、中位數、眾數、IQR。 解說:資料分布初步觀察。

- 推論統計 (Inferential Statistics) 應用:假設檢定、信賴區間。 解說:透過樣本推估母體。

- Z-score & 標準化 (Z-score & Standardization) 應用:異常值偵測。 解說:Z>3 常視為離群點,標準化讓資料均值0、方差1。

- 變異係數 (Coefficient of Variation, CV) 應用:比較不同單位數據穩定性。 解說:CV = 標準差/平均數。

- 機率分布 (Probability Distributions) 應用:常態、Poisson、Binomial。 解說:描述隨機變數的行為,常態分布最常見。

- 中心極限定理 (Central Limit Theorem, CLT) 應用:樣本平均數近似常態分布。 解說:n≥30 時,母體非正態也可近似常態。

- 貝氏定理 (Bayes’ Theorem) 應用:Spam 檢測、醫學診斷。 解說:根據觀測證據更新事件發生機率。

- 主成分分析 (Principal Component Analysis, PCA) 應用:降維、去除共線性。 解說:利用特徵值分解找主要變異方向。

🔹 C. 機器學習技術與應用 (科目三重點)

- 監督學習 (Supervised Learning) 應用:分類、回歸。 解說:有標籤資料訓練模型。

- 非監督學習 (Unsupervised Learning) 應用:分群、關聯規則。 解說:無標籤資料,找隱藏模式。

- 強化學習 (Reinforcement Learning) 應用:自駕車、遊戲 AI。 解說:智能體透過回饋信號學習策略。

- 線性迴歸 (Linear Regression) 應用:房價預測。 解說:找出自變數與應變數的線性關係。

- 邏輯迴歸 (Logistic Regression) 應用:二元分類(Spam / Not Spam)。 解說:Sigmoid 函數將輸出轉為機率。

- 支持向量機 (Support Vector Machine, SVM) 應用:二分類、小樣本分類。 解說:找到最大化分類邊界的超平面。

- 決策樹 (Decision Tree) 應用:信用風險評估。 解說:依特徵分割,易於解釋但易過擬合。

- 隨機森林 (Random Forest) 應用:分類與回歸。 解說:多決策樹集成,降低過擬合。

- 梯度提升 (Gradient Boosting, XGBoost, LightGBM) 應用:Kaggle 比賽常勝模型。 解說:逐步修正前一模型錯誤,提升準確度。

- k-近鄰 (k-Nearest Neighbors, k-NN) 應用:推薦系統。 解說:依鄰近點類別決策,對尺度敏感。

- 人工神經網路 (Artificial Neural Network, ANN) 應用:非線性分類。 解說:多層感知器(MLP),具表達非線性能力。

- 卷積神經網路 (Convolutional Neural Network, CNN) 應用:影像辨識。 解說:局部感受野 + 權重共享。

- 遞迴神經網路 (Recurrent Neural Network, RNN) 應用:語音、文字。 解說:適合處理序列,但存在梯度消失問題。

- 長短期記憶網路 (LSTM) / 閘控循環單元 (GRU) 應用:時間序列預測。 解說:解決 RNN 的梯度消失問題。

- 模型評估指標 (Evaluation Metrics) 應用:分類與回歸效能檢測。 解說:Accuracy、Precision、Recall、F1、ROC/AUC、MSE、RMSE、R²。

✅ 這 40 條完整涵蓋 AI應用規劃 + 大數據分析 + 機器學習技術,同時包含 基礎原理 + 實務應用 + 考試高頻知識點。

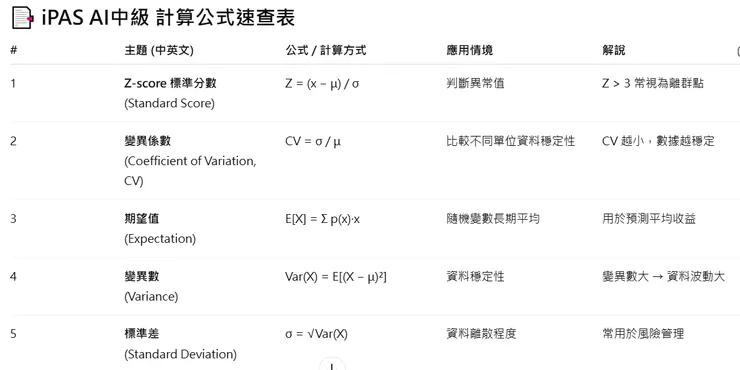

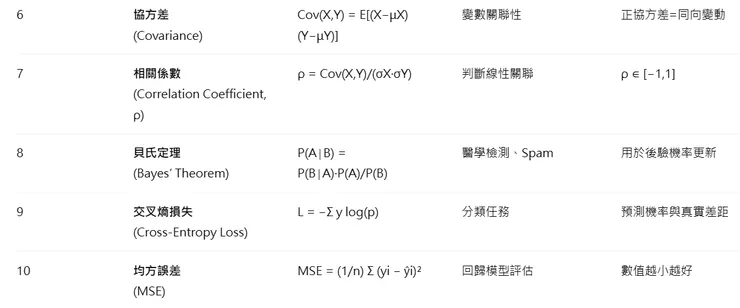

針對 iPAS AI中級考試中「需要計算」的知識點與公式,整理成一份 表格化考前速查對照表。

🔢 iPAS AI中級 計算小技巧 (10個)

- Z-score 快速判斷

- 公式:Z = (x−μ)/σ

- 小技巧: Z ≈ 2 → 在平均值 ±2σ 內 (95%) → 通常不是異常 Z ≥ 3 → 幾乎必定是異常值

- 👉 遇到數字題,不用算太細,先用 σ 判斷範圍。

- 變異係數 (CV) 快速比較

- CV = σ/μ

- 小技巧: 不同單位或不同尺度數據 → 只要比 CV,越小越穩定

- 👉 只要看到「穩定性比較題」→ 立刻用 CV 判斷。

- Precision / Recall 快速判斷

- Precision = TP/(TP+FP) →「我抓到的正例有幾個是真的?」

- Recall = TP/(TP+FN) →「真實正例我抓到了多少?」

- 小技巧: 記憶法 → Precision「準確」偏向模型輸出,Recall「召回」偏向真實數據。

- 👉 遇到「漏報 vs 誤報」題:漏報=Recall低,誤報=Precision低。

- F1-score 心算公式

- F1 = 2PR / (P+R)

- 小技巧: P=R 時 → F1 = P = R P 與 R 差距大 → F1 接近小的那個

- 👉 可用來快速驗算答案。

- ROC / AUC 快判

- 小技巧: AUC=0.5 → 隨機分類器 AUC 越接近 1 → 模型越好 AUC < 0.5 → 模型方向錯 (可反轉)

- 👉 遇到選項問「模型有無效用」→ 看 AUC 即可。

- MSE / RMSE 快速轉換

- MSE = 平方誤差平均,RMSE = √MSE

- 小技巧: MSE = 4 → RMSE = 2 👉 RMSE 與原始單位一致,更直觀。

- R² 判斷

- R² = 1 − (SSE/SST)

- 小技巧: R² 越接近 1 → 模型越好 R² < 0 → 模型比直接猜平均還爛

- 👉 考題問「模型是否有意義」→ 看 R² 是否 > 0。

- 貝氏定理簡化思路

- P(D|+) = (靈敏度·盛行率)/[(靈敏度·盛行率)+(假陽性率·(1−盛行率))]

- 小技巧: 盛行率很低時 → 後驗機率絕對不會接近 100% 考試陷阱:靈敏度 98% ≠ 陽性=98%

- 👉 看到醫學檢測題 → 直接用簡化公式。

- PCA 主成分保留判斷

- 小技巧: 特徵值由大到小排序 → 保留前幾個直到累積變異 ≈ 80~90% 考題常出陷阱:不是取全部,而是取「大部分變異」。

- 梯度下降 (Gradient Descent) 快判

- 更新公式:θ = θ − α∂L/∂θ

- 小技巧:

- α 太大 → 震盪不收斂

- α 太小 → 訓練超慢

- 👉 遇到問「為何模型不收斂」→ 答案通常是 α(學習率)問題。