🧲 特徵轉換方法

特徵轉換是調整數值型特徵分布形態的過程,幫助模型更有效地學習和提高預測性能。良好的特徵轉換可以:

- 改善數據分布:使偏斜分布更加對稱

- 降低異常值影響:減少極端值對模型的干擾

- 捕捉非線性關係:讓線性模型可以學習複雜模式

- 提高訓練穩定性:加速梯度下降收斂過程

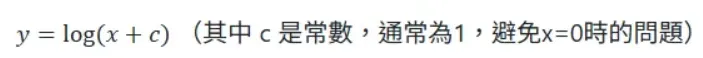

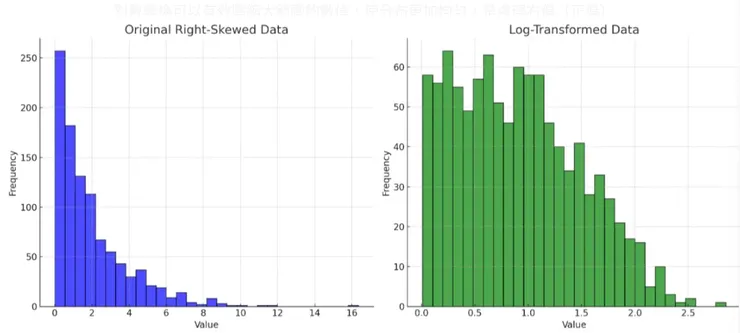

對數變換 (Log Transformation)

對數變換可以有效壓縮大範圍的數值,使分布更加均勻,是處理右偏(正偏)數據的常用方法。

- 適用場景:

- 高度右偏(正偏)數據,如收入、房價、人口- 數據範圍跨越多個數量級- 存在極端異常值的特徵- 呈指數增長的數據

- 優缺點:

- ✅ 有效壓縮大範圍值,保留小範圍值的差異

- ✅ 降低極端值影響,穩定模型訓練

- ✅ 使乘法關係轉換為加法關係(log(xy) = log(x) + log(y))

- ❌ 不適用於負值和零值(需添加常數)

- ❌ 可能過度壓縮大值區域的差異

- ❌ 轉換後特徵失去原始尺度的直觀解釋性

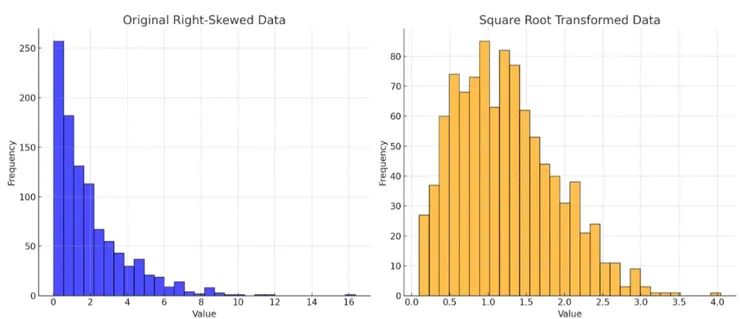

平方根變換 (Square Root Transformation)

平方根變換是比對數變換更溫和的壓縮方法,適用於中度偏斜的數據。

- 適用場景:

- 中度右偏(正偏)數據

- 計數型數據(如事件頻率、出現次數)

- 比例型數據(如百分比)

- 數據範圍相對較小且全部為非負值

- 優缺點:

- ✅ 比對數變換更溫和,保留更多原始數據特性

- ✅ 對於中等範圍的數據更有效

- ✅ 計算簡單,容易理解

- ✅ 可用於零值(不需添加常數)

- ❌ 不適用於極度偏斜的分布

- ❌ 不適用於負值(需添加常數)

- ❌ 對大值的壓縮效果低於對數變換

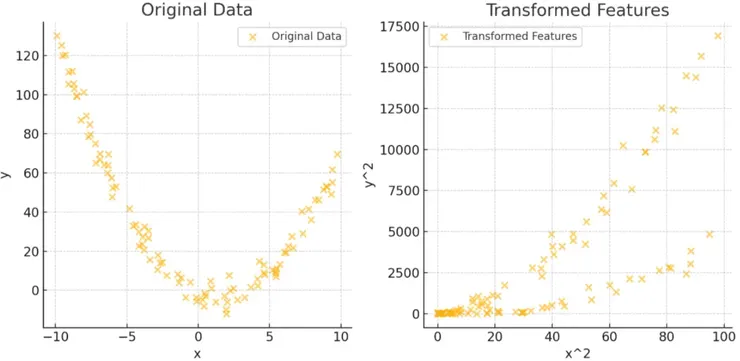

多項式特徵構造 (Polynomial Features)

多項式特徵構造通過創建原始特徵的高階組合,使線性模型能夠捕捉數據中的非線性關係。

對於特徵 X₁, X₂,可創建:

X₁², X₂² (二次項)

X₁X₂ (交互項)

X₁³, X₂³ (三次項) 等

- 適用場景:

- 使用線性模型處理非線性關係

- 特徵間存在交互效應

- 需要捕捉複雜曲線關係

- 特徵數量較少但關係複雜的數據集

- 優缺點:

- ✅ 顯著增強線性模型的表達能力

- ✅ 可以捕捉複雜的非線性模式和交互效應

- ✅ 保持模型的可解釋性(知道具體使用了哪些特徵組合)

- ❌ 特徵數量指數級增長,造成維度災難

- ❌ 容易導致過擬合,需搭配正則化

- ❌ 增加多重共線性風險

- ❌ 計算複雜度高,需謹慎選擇多項式次數

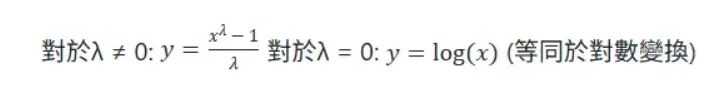

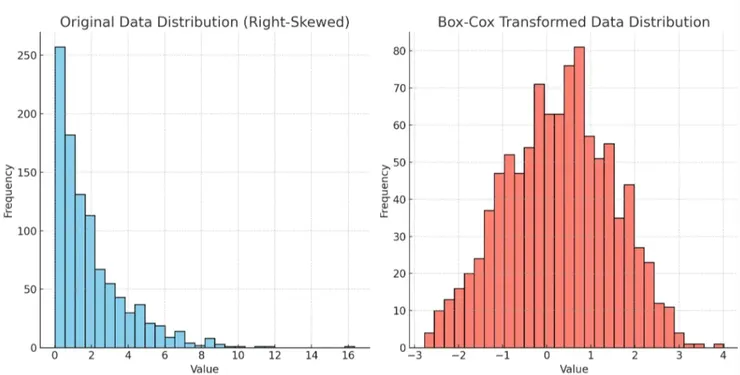

Box-Cox 變換

Box-Cox是一種參數化的幂變換方法,通過優化參數λ使數據盡可能接近正態分布。

- 適用場景:

- 需要使數據接近正態分布的情況

- 對分布形態有特定要求的統計模型

- 數據存在明顯偏斜但不確定最佳變換方法

- 線性回歸等假設殘差正態的模型

- 優缺點:

- ✅ 自動尋找最佳變換參數λ

- ✅ 包含多種常見變換(如對數、平方根)作為特例

- ✅ 可有效改善數據的正態性

- ✅ 有助於滿足許多統計模型的假設條件

- ❌ 僅適用於嚴格正值數據

- ❌ 變換後的值難以直接解釋

- ❌ 對含有零值或負值的數據需要先進行偏移

- ❌ 計算過程相對複雜