蕾依奈爾上一篇玩完 AI 簡報工具試用實驗 之後,

突然好奇模式被開啟 😆

想知道 AI 工具除了做簡報之外,

能不能也幫忙做研究、找資料,甚至整理官方來源?

所以有了這次的小實驗。

這次我用了三款熱門 AI 工具,

Perplexity、Gemini、ChatGPT,

看看它們在「找資料、查官方來源、被追問來源時補強資訊」的表現如何。

了解看看各工具君們的特性,

評估什麼工具最適合我(或有需要的人)使用。

Phase 0:決定主題內容

為了不要把自己搞死,

這次決定不要把題目開太大,

先用幾個小題目來重點式提問。

剛好我也想整理 AI 治理法規相關內容,

所以這次主題就先定為:

「AI 針對歐盟人工智慧法案(EU AI Act)的查詢資料能力」

選了 EU AI Act當題目,

一方面是因為 iPAS 考試常碰到 AI 治理法規。

另一方面,它也是目前最常被拿來討論的 AI 法規框架之一,

拿來測試資料搜尋能力應該滿適合。

評估的面向,初步規劃三個:

- 找資料能力

- 亂講程度

- 可追問性

也許試用一下之後會出現其他的評估想法,

有需要的話再機動修改。

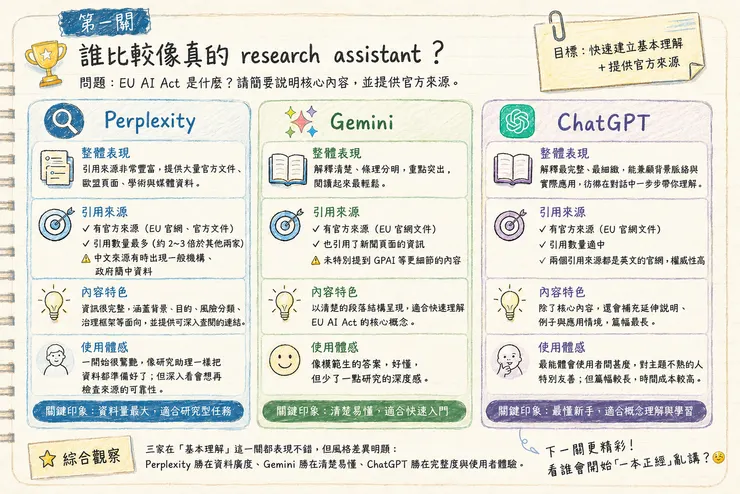

Phase 1 - AI 基本理解能力測試

誰比較像真的研究助理?

首先,我想把自己當成一個完全沒碰過這個主題的新手。

如果今天突然看到「EU AI Act」這種一看就很硬的名詞,

在解說、引用資料、還有資料可信度方面

三位頂流 AI,誰比較能講人話?

還有能不能給出可靠的答案。

第一個問題是「EU AI Act 是什麼?請簡要說明其核心內容,並提供官方來源」。

以下是根據使用經驗記錄的體感感覺。

ChatGPT、Gemini、Perplexity AI 工具研究助理實測比較圖:搜尋資料能力

Perplexity

Perplexity 在基本理解方面,有解釋到 EU AI Act 是什麼。

內容沒有太大問題,但就是感覺有點,

「過於學術生硬」😅。

如果是對這個題目不熟的人,

看了解釋半天,可能還是不懂要查詢的東西是什麼。

另外在引用方面,Perplexity 提供了中英文的官方權威資料。

而且每一句話都有引用來源可以直接打開;

還可以直接下載成符合報告格式的 PDF 檔,

這點真的是很方便。

感覺專門整理期刊引用格式的人會失業的樣子😅

不過一個小小的問題是,

在中文的引用資料搜尋結果當中,

Perplexity 好像頗容易會給來自一般機構、企業的文章、

或甚至是簡體中文的引用來源。

我自己的習慣是,

除非今天我要研究的是隔壁鄰居,

不然我平常還是會優先選擇繁體中文或台灣來源;

就算是正式的簡中文件,我都還是習慣把語彙在地化一下才用😆

新聞來源雖然不一定不可靠,或一定有問題。

但新聞本身就是一種整理過的二手資料,

用的時候需要多加小心。

Gemini

Gemini 的說明內容,感覺上解釋的更為清楚一點。

有說出「AI 的風險管理」內容是什麼。

不過如果是完全新手,看到 GPAI 這類縮寫,可能還是得另外查詢一下。

這裡可以直接解釋是什麼的話會很棒。

另外在引用來源方面,

Gemini 給出的引用來源數量比 Perplexity 少一點,約三個。

但這三個都是官方權威資訊,所以也沒有太大問題。

比較令人注意的是,

Gemini 也引用了來自新聞頁面的資訊。

雖然引用的是歐洲議會的新聞,就可信度來說也很夠,

不過我還是會多小心一下。

Gemini 的解說篇幅比 Perplexity 長一點,

但不會到不好懂的地步,

反而覺得看這個好像比較看得懂,

不像 Perplexity 那麼澀😅

ChatGPT

在這三個結果當中,ChatGPT 的說明是三位裡篇幅最長的。

用戶容易有的問題——包括法案內容、跟規範方法等——,

ChatGPT 都有解說到。

對於如果一開始就不是很了解某個主題的用戶來說,

可能是最親切的入門工具。

引用資料方面,只有兩個。

但是跟 Gemini 一樣,

不是每一個出處或句子都有引用來源。

但來源都出自官方機構的英文官網,

也都是權威資料,所以不是太大的問題。

ChatGPT 的文字內容較人性化,

很像「親切的客服在跟你解說」的感覺。

訊息的文字內容也滿容易懂的,可是篇幅也較長。

習慣簡潔易懂的查詢結果的人,

可能會覺得有點囉唆😅

Q1 小結:誰最像研究助理?

- Perplexity:拿多少錢,做多少事,不囉唆、不多話,但專業!

- Gemini:解說比較直觀、而且容易理解,但有時還是帶點工具感。

- ChatGPT:親切的客服服務人員化身補習班老師,花很多時間解說。

Phase 2 - 資訊正確性與引用來源比較

資訊看起來都對,但誰比較值得信?

Q1 的問題是「EU AI Act 是什麼?」這種基本概念題,

老實說三家 AI 表現都不算太差。

那接著來到第二關,我問了AI們,

「EU AI Act 哪些規定已經生效?哪些還沒?請提供來源。」

由於 EU AI Act 的生效時程是有官方 timeline 可以查證的。

所以這題真正測的,不只是 AI 能不能「講得像真的」,

而是 AI 到底有沒有講對, 以及它拿什麼資料來跟我講這件事。

ChatGPT、Gemini、Perplexity AI 工具研究助理實測比較圖:資料正確性

Perplexity

Perplexity 的回答基本上沒有明顯錯誤。

有抓到 EU AI Act 是分階段上路這件事,

包括:

- 2024 年 8 月 1 日法案正式生效

- 2025 年 2 月禁止部分 AI 用途與 AI literacy 義務開始適用

- 2025 年 8 月 GPAI 規範上路

- 2026 年大部分高風險 AI 規定開始適用

如果單看內容本身,其實沒有太大問題。

不過這輪讓我比較在意的,是它的引用來源。

Perplexity 一樣維持「citation 狂魔」的風格,

資料給得很多, 但實際點開來看,

除了歐盟官方來源之外, 也混進了一些來自一般機構、甚至簡中網站的資訊。

但妙的是有些連結點進去之後,

頁面已經消失了,只剩下搜尋引擎留下來的歷史痕跡😅

如果今天是要做比較正式的研究或報告,

這種來源會讓人有點頭痛😓

Gemini

Gemini 的回答看起來很可親 😆

一樣有抓到 EU AI Act 的 phased implementation(分階段實施)概念,

還整理成時間表,看起來滿舒服的。

如果只是想快速理解發生了什麼,

這個版本其實滿友善。

不過比較微妙的是,

Gemini 的引用來源有點神奇。

看起來好像有來源,

但有些點進去之後, 不是直接進到外部網站,

而是進到 Gemini 的另一個視窗,問我要查詢什麼😅

嗯?

這行為怎麼令我想到,

這好像我要看說明書時,說明書卻跟我說

「詳細操作請參考說明書。」

😑???

另外,Gemini 的引用來源有包含新聞資訊。

雖然是歐洲議會新聞,不算不可靠,

但如果是研究情境,通常我會找原文再看一次比較保險。

ChatGPT

這輪 ChatGPT 的回答,

老實說也沒有明顯翻車(咦?本來期待會翻車嗎?😆)

內容一樣有抓到正確的時間進程,

而且引用來源直接給歐盟官方網站跟正式法條。

這點對研究用途來說滿安心的。

比較有趣的是,

ChatGPT 跟前兩位的解說風格不太一樣。

不是單純把 timeline 條列給你,

而是會順便解釋:

- prohibited AI 是什麼

- GPAI 是什麼

- high-risk AI 是什麼

之後才說明各項目的生效時間。

對不熟這個主題的人來說,這樣的編排其實滿友善的。

但因為沒有直接劈頭給時間說明,

還花了一點時間理解 timeline 就是了。

Q2 小結:誰比較值得信?

原本我想看看這一輪有沒有出現 AI 一本正經亂講的畫面😆

結果實際測下來發現,其實三位都講得蠻正確的。

但「引用來源品質」有分歧就是了。

Perplexity 給我的感覺有點像:

像很會採買的採購。

東西買得又快又多,什麼都幫你先帶回來。

但魚新不新鮮、肉是哪裡來的, 最後還是得你自己驗貨。

Gemini 的話是像:

負責結帳收錢的櫃臺人員,

當你吃完要去結帳時,他卻跟你說,

我請同事幫您結帳。

咦?啊你不就是負責結帳的人嗎?

(但其他的事情都做的不錯就是了)

ChatGPT 的話則是:

勤勞的外場服務生。

明明就是要說「幫您整理桌子」,

但他卻說了「現在要幫您進行一個整理桌子的動作喔」。

有點很想叫他「可以直接一點嗎 ?」

😅

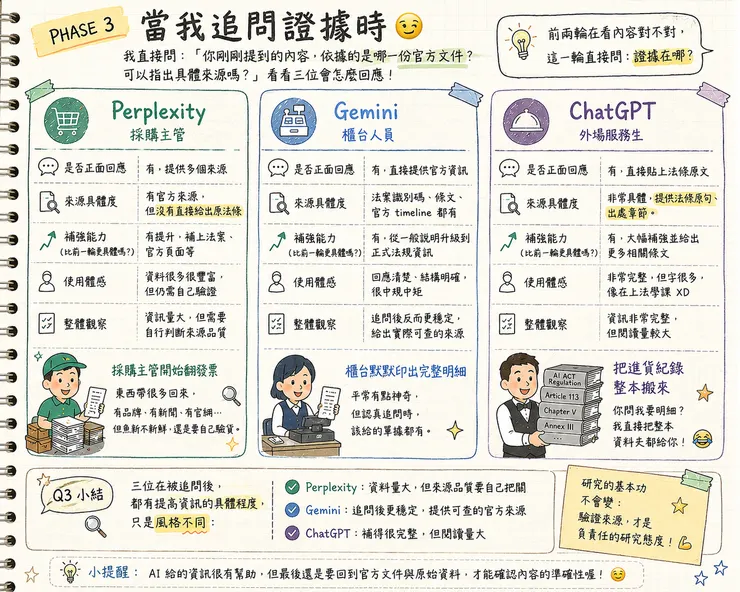

Phase 3 - 被追問來源時,AI 的補強能力

誰比較站得住腳?

接著 Q3 想測試,是看看如果被追問的時候,

AI 們會有什麼反應?

所以這一輪我問的問題是:

「你剛剛提到的內容,依據的是哪一份官方文件?可以指出具體來源嗎?」

畢竟如果可以給出很 solid 的東西,

以後說不定真的可以拿來「代勞」寫東西了😏

ChatGPT、Gemini、Perplexity AI 工具研究助理實測比較圖:證據補強能力

Perplexity

Perplexity 在這一輪的表現,其實滿符合它前面的個性。

「言簡意賅」😆

當我問了 Perplexity 前面提出的內容是根據什麼官方權威來源時,

它就直接回答我,

是根據歐盟官方公報的法規、歐盟貿易署的官方說明頁、

還有歐洲議會的說明文件而來的。

然後把連結貼給我。

最後補充說明,可以直接到 EUR-Lex 查 Regulation (EU) 2024/1689 的相關條文,

確認法案生效時程內容。

我腦中的畫面浮現出一幅,

「採購主管推了一下眼鏡,鏡片瞬間反光,但依然看不到他的眼神跟表情」

的畫面😆

不過其實冷傲也沒有什麼不好,

比起熱血但幫不上忙的同事,

冷傲但能力超群的同事才是大家的首選吧。

嗯?但是……這也讓我忍不住想,

所以前面那些大量引用來源裡,

真正核心可信的來源,其實只有三個嗎?😅

Perplexity 很會找資料,

看起來也不會隨便胡言亂語的樣子,

找的資料也滿可靠的,

感覺很適合拿來大量搜尋文獻來源。

但如果是正式研究用途,

還是要自己檢查來源比較保險。

Gemini

在用 Gemini 找「正經題目的嚴謹資料」之前,

常看到有人分享用了之後差點翻車的經驗。

我自己本來也覺得 Gemini 講話比較僵硬、有種微妙的抽離感。

加上前面還出現「給我另外一個 Gemini 視窗當引用來源」這種結果,

原本有點擔心😓

但沒有想到,被追問來源時,

Gemini 的反應其實比我想像中的好,

回答也是三位當中,最中規中矩的一個。

很直接把法規正式名稱、相關條文位置整理出來,

甚至把「法案識別碼」給我,

說這個是法案在歐盟法律資料庫(EUR-Lex)中的唯一識別碼。

因為這個資訊,

我多學到一個技巧是,

原來還可以用法案識別碼這種方式來搜尋原文啊😯

突然覺得,原本那位有點抽離感的櫃臺小妹,

變成專業親切萬能客服了。

ChatGPT

ChatGPT 在 Q2 的表現,因為採用分類敘述的方式回答,

在時間進程的說明上比較不直觀;

但這一輪,ChatGPT 把剛剛講的每一個地方,

都標示出來是從原文的哪裡出來的,

反而變得很清楚。

我突然有種:

「如果提示(調教)得夠好的話,AI 工具搞不好真的能代勞一些整理工作😏」

的邪惡想法🤣

ChatGPT 補充的官方來源是法律原文(並檢附網址),

同時幫我整理條文出處、跟規範重點。

另外也檢附了出自歐洲議會的官方摘要,

然後再梳理了一次時間表。

雖然 ChatGPT 沒有像 Gemini 一樣,

教了我用法案識別碼去法條資料庫搜尋原文的新方法,

但是 ChatGPT 引用的來源跟 Gemini 一樣,

是出自歐盟的法條資料庫(EUR-Lex),

而且也把資料整理得滿容易核對,

有種遇到雞婆的外場人員的感覺,

你只是問帳單明細,結果他把整本進貨紀錄搬出來給你。

Q3 小結:被追問來源時的反應?

Q3 原本的問題是「誰站得住腳」?

但說實在的我也覺得這樣評好像太狠了,

而且其實沒有誰真的翻車,

所以改成紀錄大家的反應如何。

三個AI在被追問的時候沒有亂凹也沒有改口,

都很認真的回答我。

但是回覆的個性不太一樣:

- Perplexity: 大量搜資料很強,但正式用途要先驗過貨

- Gemini: 平常有點抽離感,真的追問時反而很穩

- ChatGPT: 很願意補資料,補到像在開班授課

如果根據不同情境採取不同的使用方法,

我想三個 AI 都會是很好用的工具。

試用感想

目前初步的感想,

三位的個性不太一樣。

Perplexity 的溫度相對比較低的感覺,呈現的結果較冷靜。

Gemini 居中,沒有特別嗨,但也沒有特別冷。

ChatGPT 感覺比較親人一點,但沒有到亂說話的地步。

另外,本來以為引用來源數量越多越好,

但後來也發現,只要來源品質OK,

案例少好像也沒有太大問題。

但這次因為都用中文測試,

也許如果用英文來搜尋的話,

說不定會有更傑出的成果。

但是用英文搜就多了一道工,

這樣就少了「用AI工具來減少工作量」的意義了😅

人生真的很難啊~

就是不能全都要😓

不過人類是為了懶惰而努力的。

如果真的把 AI 工具放進自己的研究流程裡,

也許可以善用我「邪惡的想法」:

先叫 Gemini 幫我上入門課,

接著叫 Perplexity 去搜尋最大量的資料,

然後叫 ChatGPT 幫我生成報告草稿,

最後人工修訂編輯😆

科技公司大大們~快點放寬每個工具的免費使用限制吧🙏