簡介

ChatGPT 是一種很厲害的 AI 工具 ,像是一個超級厲害的「聊天機器人」或「創作助手」。GPT 的全名是「Generative Pre-trained Transformer」,名字聽起來很複雜,但你可以把它想像成一個很愛閱讀、很愛學習的AI。

這個 AI 先是讀了大量的書、文章、網頁資料,就像你平常上課讀教科書一樣,不過它讀得更快、更多!然後,當你問它問題或是讓它幫你寫文章時,它就會根據讀過的知識來回應你。就像你有一個超級厲害的朋友,能夠回答各種奇怪的問題,或是幫你寫故事、作業、笑話!而且,它會根據你說的話來調整自己,像是玩一種文字遊戲,可以不斷變得更聰明。

ChatGPT 最棒的地方是,它不會真的「知道」一切,但它會非常擅長用自己的「語言能力」來組織出有趣的回答。它是專門幫助人們解決問題和學習新知識的 AI 小幫手,就像是個懂得很多東西的好朋友!

ChatGPT 雖然很厲害,但它也不是「完美無缺的天才」。有時候它可能會答錯問題,或把事情講得很像真的卻其實不正確。所以,當你得到答案時,最好還是動動腦查核一下,特別是遇到重要或專業的資訊。這樣,你就能把 ChatGPT 當成一個超強的學習夥伴,而不是「全知的老師」。

接下下來我們就來深入認識它一下吧!

GPT 是什麼意思?

我們來解釋什麼是 “GPT”,保證不會太 nerdy(好吧,其實會一點😆)。

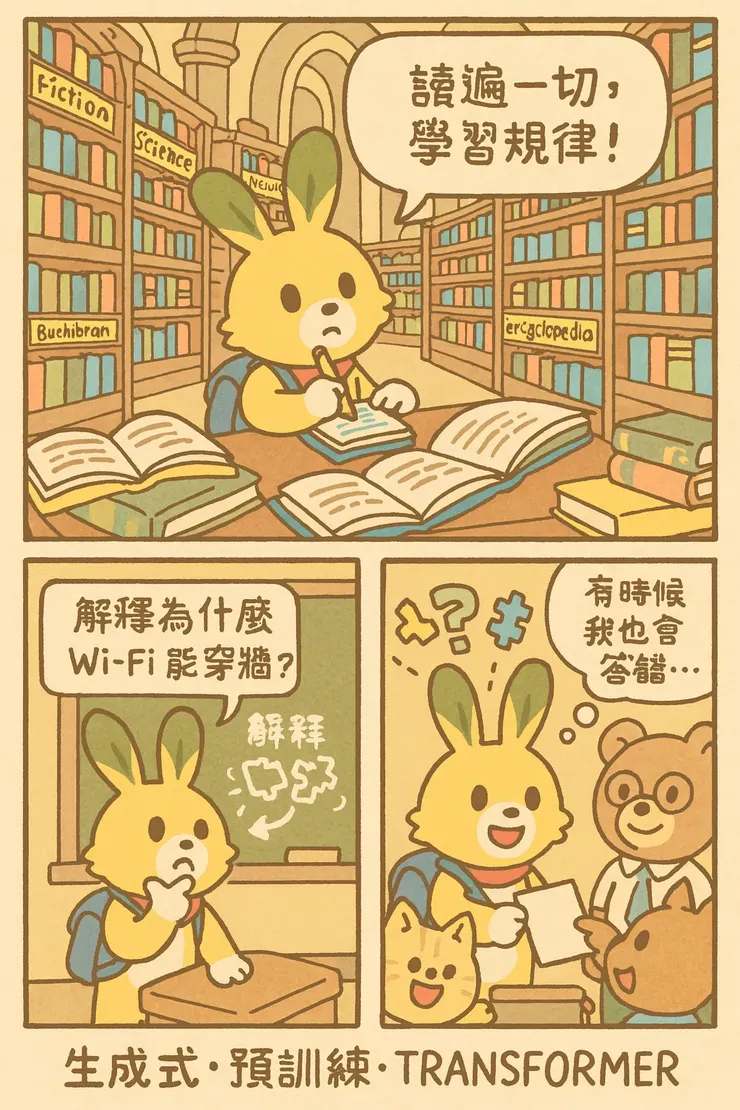

GPT 是一串縮寫,全名是 Generative Pre-trained Transformer。可以拆成三部分來看:

- Generative(生成型)

指這個模型能「生成」東西——最常見的是文字,比如回答問題、寫文章、翻譯、聊天等。也就是說,它不只是分類或識別,而是能創造語言內容。 - Pre-trained(預訓練)

這表示在你跟它對話之前,它已經在大量的文字數據上先訓練過。透過這樣的預訓練,它學會語言的規律、句子結構、詞彙用法、甚至某些世界知識。這樣當你用它時,它已經有「核心知識」,可以比較快速地回應不同問題。 - Transformer(Transformer 架構)

這是模型的技術骨架,是一種深度學習模型架構(architecture)。它特別強在理解上下文(context)—也就是說,它可以看一段話中前後句子怎麼連續、哪些字詞比較重要、哪些可以忽略,來做出比較合理的生成。 Transformer 架構在自然語言處理上是一個非常重要的突破。

整體合起來,GPT 是什麼意思?

GPT 是一種大型語言模型(large language model, LLM):

- 它被設計來理解人類語言,也能生成類似人類寫的語言

- 在使用之前做過大量訓練,所以「懂得」很多語言用法和知識

- 用的是 Transformer 技術來處理文字的關係與上下文

簡單說,GPT 就是一個用很多文字訓練過的大腦,擅長「理解文字 → 生出文字」。想像它像一個讀過無數書籍、而且超會接話的朋友,但偶爾會「胡亂發揮」、「講錯或唬爛」,所以需要我們自己幫它過濾與查核。

GPT 是一位什麼樣的學生?

我們來把 GPT 比作一個學生來講,會讓整個原理比較生動。想像有一個學生,叫 GPT,他的學習方式、能力、限制都很特別。

學習階段(預訓練)

- 小時候,GPT 幾乎每天都在讀書、背書、聽課,範圍非常廣:小說、新聞、維基百科、科學論文、部落格...幾乎所有能拿到的文字資料他都看過。這時候他並不知道自己以後會被問什麼題,但他先把語言的規律、詞彙怎麼用、文章怎麼結構、句子怎麼接上下文、什麼字詞常常一起出現……全都悄悄學起來了。

- 這個階段就像學生在學校裡「刷題+閱讀大量書籍」,但沒有特定考試要準備。「只是為了理解語言的規律」這件事。

準備答題的階段(微調或指令學習)

- 後來,GPT 被告訴:「你要把讀的那些文字中的一些模式用來特別回應人的問題/命令」。好比說,老師讓這個學生做練習題:有問答、討論題、摘要、翻譯、作文等,讓他練習「給指令 → 產出答案」。

- 他也會被教一些特別重要的規則:不要回答錯誤太多、盡量清楚、有禮貌、不要假裝自己知道等。

作答時:當 GPT 遇到問題,他怎麼做

像考試中遇到一題作文或問答題:

- 理解題目

GPT 先看題目,試著「回想」過去哪些他看過的文本中有類似的問法/內容。就像學生回想以前練過哪幾種題型。 - 用「記憶+模式」組答案

他不是完全憑空創造,也不是只重複某一篇文章。他把許多他讀過的例子、句型、邏輯結構拼湊成一個新答案。這部分像學生會把不同課本、不同老師講的概念混合起來,然後用自己的話寫出來。 - 關注上下文

如果問題中有前文/背景(例如你剛才問的話),GPT 會「記得它」並用它來調整答案。就像學生看題型時看「給出的條件」:如果題目說「這篇文章要面向小學生」,他就會改用簡單的語言;如果題目說要學術化,他就用專業字眼。 - 可能的錯誤與限制

a. 有些知識他沒看過 → 他可能記錯或不知道最新資料。像學生如果沒讀過某篇新研究,就可能答不上來。

b. 如果題目要非常創新、非常跳框,他可能受限於過去看過的例子,可能答案比較「常見」或「保守」。

c. 可能有偏見(因為他看過的資料裡就有某些偏見或錯誤),他也可能把錯誤當成「常見」模式,於是再重複。

用這比喻理解 GPT 的三個核心詞

在前面說 GPT 是「Generative」「Pre-trained」「Transformer」,如果這位學生 GPT,那這三個詞在比喻裡對應:

- Generative → 他能自己寫答案/創造文章,不只是判斷「對/錯」。像學生不只是選擇題,也可以自由寫作文。

- Pre-trained → 上面「預訓練」階段:他事先讀很多書,學很多語言規律。那不是為了某一次特定的考試,而是為了讓自己具備廣泛的基礎。

- Transformer → 這是他理解語言、注意力怎麼分配的內在機制。如果要用比喻:他在看題目與思考答案時,有一雙非常敏銳的眼睛(注意力/attention),能從題目和之前讀過的所有資料裡快速抓出哪些部分最重要(關鍵詞、背景資訊),把這些關鍵部分放更多心力去分析,再拼湊答案。就像學生做閱讀理解時,知道哪句話透露了作者觀點、哪裡是解題關鍵,再用這些訊息組合答案。

如果你要做塗鴉筆記,可以這樣想:

- 一個大書架 → 含各種類型的書(小說、新聞、科學文章等):這是預訓練資料庫

- 學生 ChatGPT 在書架上反覆讀、做筆記 → 建立模式、記憶怎麼用詞、怎麼接句

- 考試/題目 → 題目給 ChatGPT,他去書架回想、選適合的書的部分,再組合自己的答案

下集預告:GPT-5、ChatGPT 核心功能介紹與應用

想把 AI 變成你的創作與工作的最佳夥伴嗎?

加入 AI 賦能空島系列圖文課程,和我們一起探索如何用生成式 AI 協作,提升效率、激發創新,還能在繁忙中找到減壓與賦能的方式。

👉 加入 AI 賦能空島 ,讓學習旅程更輕盈、更有玩心!