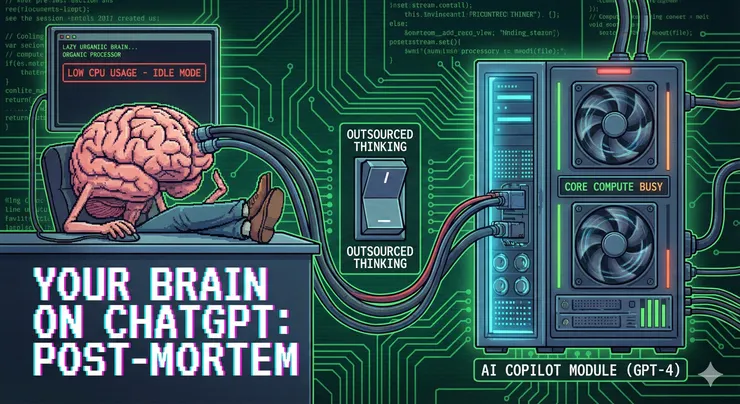

—— 基於 MIT 研究報告 “Your Brain on ChatGPT” 的技術分析

MIT 最近執行了一次針對人類生物神經網路(Biological Neural Networks)的壓力測試,題目叫做《Your Brain on ChatGPT》。說白了,這就是一場關於「大腦算力分配」的 A/B Test。

實驗架構如下:

將受測單元(人類)分為三個 Clusters:

- AI 輔助組:啟用 Copilot/ChatGPT 模組。

- 傳統檢索組:僅允許調用 Google Search API。

- 本地運算組:斷網,強迫使用本地緩存(大腦)進行運算。

科學家掛載了監控工具(腦波儀),即時對這些受測單元進行 Profiling(效能分析)。

1. 效能分析報告:CPU 使用率顯著下降

監測數據顯示,AI 輔助組的系統負載(Load Average)極低。

這不是系統優化,而是核心製程進入了 Idle(閒置)模式。大腦判斷外部 API(ChatGPT)已經接管了主要邏輯處理,於是本地 CPU 直接降頻,進入省電狀態。

現象: 就像你把核心演算法全部外包給第三方 API,本地端只負責接收 JSON Response。

這組產出的內容,雖然格式正確(Lint 通過),但內容充滿了「模板感」(Boilerplate code)。

結構通常是:

AbstractPoint APoint BConclusion: return true;

看起來沒 Bug,但完全沒有靈魂,缺乏獨特的「實作細節」。而且因為沒有參與運算過程,這些人對輸出的內容毫無記憶(Cache Miss),被問到細節時只能拋出例外錯誤(Exception)。

2. 依賴性後遺症:冷啟動延遲 (Cold Start Latency)

更嚴重的 Bug 出現在後續測試:當移除 AI 權限後,原本依賴 AI 的組別出現了嚴重的效能降級。

即便切換回手動模式,他們的腦波依然維持低水平。

大腦的反應就像是:

「Wait,你不是有自動化腳本嗎?為什麼現在要我手動 SSH 進去敲指令?這不符合 Workflow 啊。」

這導致了短期的「啟動延遲」。就像習慣了自動尋路的 RPG 玩家,突然被丟進硬核模式,連基本的移動操作都忘了。

3. 對照組發現:資深開發者的逆向操作

有趣的是,原本習慣「手刻程式碼」(靠自己寫)的人,第一次引入 AI 工具時,腦波活躍度反而 飆升 (High CPU Usage)。

為什麼?因為他們在做 Code Review。

他們不信任 AI 生成的 Code,於是:

- 檢查邏輯漏洞。

- Debug 錯誤資訊。

- 將 AI 的建議 Refactor(重構)進自己的架構中。

這才是正確的工具使用方式:把 AI 當成 Junior Developer,而你是 Tech Lead。 你是在審核它的 PR(Pull Request),而不是讓它直接 Merge 到主分支。

4. Root Cause Analysis (根本原因分析)

問題不在於工具本身,而在於你的 調用策略 (Invocation Strategy)。

真正的風險是你的大腦認為「思考」這個 Process 已經可以被 Deprecated(廢棄)了。

當你讓 AI 包辦:

- 資料檢索 (Query)

- 架構設計 (System Design)

- 程式碼生成 (Implementation)

你大腦最核心的功能 —— 資訊整合與邏輯推導 (Compute & Logic) —— 就因為長期不被呼叫而被系統排程邊緣化。久而久之,這部分的能力就會退化成 Legacy Code。

5. Optimization Plan (優化方案)

為了防止大腦算力退化,建議採用以下 SOP:

- Phase 1: 本地預先渲染 (SSR)

不要直接 Prompt,先在腦中跑一遍「虛擬碼」或「草圖」。先有架構,再叫 AI 補全細節。讓大腦保持在 Master 節點的位置。 - Phase 2: 變更角色定位為 "Linter/Debugger"

不要問 AI「幫我寫」,要問它「幫我找 Bug」。

讓 AI 擔任測試工程師或 Code Reviewer,指出你邏輯上的 Race Condition 或死結。 - Phase 3: 手動重構 (Manual Refactor)

學習新技術時,不要只看 AI 的解釋。關掉視窗,強迫自己用自己的邏輯重寫一遍(Re-implementation)。這能確保資訊被寫入你的長短期記憶體(LTM)。

結論

MIT 的這份報告並不是說「用 AI 會導致硬體損壞」。

它警告的是:如果你把自己定位成單純的 API Gateway(轉發器),你的大腦就會停止運算。

反之,如果你把 AI 當作 Pair Programmer 或 Copilot,並保持自己在架構設計上的主導權,你的神經網路反而會因為高強度的「對抗訓練」而變得更強壯。

Action Item:不要把思考外包 (Outsource),要把它當作擴展模組 (Plugin)。