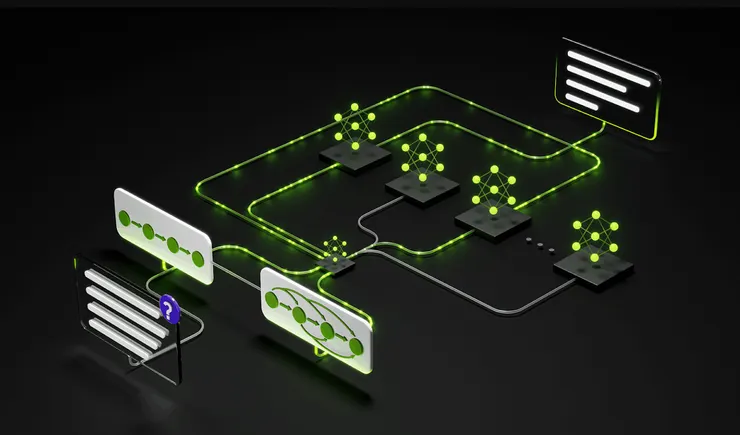

當我們還在驚嘆於 ChatGPT 的對答如流時,AI 領域的下一個主流「AI 代理」(Agentic AI)已悄然來臨,一個由多個特製 AI 代理組成的協作系統,能夠自主規劃、執行工具、並完成複雜的多步驟任務。然而,打造這樣的 AI 代理系統,開發者面臨著巨大的挑戰:模型之間溝通的延遲、長期任務中不斷失焦的「情境漂移」(Context Drift)、以及因模型過於龐大而無法承受的運算成本。更重要的是,許多強大的模型都是不透明的黑盒子,讓企業在委以重任時充滿疑慮。

於是, NVIDIA 於 2025 年 12 月 15 日正式發布了全新的 Nemotron-3 開源模型系列,提供一套專為打造透明、高效、且可客製化的 AI 代理系統而生的完整解決方案。

NVIDIA Debuts Nemotron 3 Family of Open Models

Inside NVIDIA Nemotron 3: Techniques, Tools, and Data That Make It Efficient and Accurate

Nemotron-3 :NVIDIA 的 AI 代理大軍有哪些成員?

讓我們先快速認識一下 Nemotron-3 家族的三位核心成員。NVIDIA 讓開發者可以根據不同的應用場景,選擇最適當規模的工具。

- Nemotron-3 Nano: 總參數為 300 億,但在每次推論時,只會啟動其中的 30 億個活性參數。 這種設計使其極具運算效率,專為需要快速反應和低成本的任務而生,例如程式碼除錯、內容摘要、資訊檢索,或是作為大型 AI 代理系統中的高效「執行者」。

- Nemotron-3 Super: 定位為高精度的推理模型,總參數約 1000 億,活性參數達 100 億。 它在效率和強大推理能力之間取得了平衡,是驅動需要多個 AI 代理協同工作的複雜應用的理想選擇,例如需要同時進行規劃、研究和執行的多代理工作流程。

- Nemotron-3 Ultra: 總參數高達約 5000 億,活性參數則有 500 億。 Ultra 被定位為一個強大的「推理引擎」,專門處理需要深度研究和戰略規劃的頂級 AI 應用。

Super 和 Ultra 版本預計將在 2026 年上半年推出。 這個不同規模參數的佈局表明,NVIDIA 認為未來的 AI 應用不是由單一的萬能模型所主宰,而是由一群大小不一、各司其職的 AI 代理,根據任務需求動態組合、協同作戰。

Nemotron-3 為何是為「AI 代理」而生?

關鍵一:混合式架構的極致效率與超長記憶力

AI 代理系統的一大挑戰是效率。當數十個代理需要頻繁溝通與協作時,每一個微小的延遲都會被放大,高昂的運算成本更是讓大規模部署變得不切實際。Nemotron-3 的核心創新,就在於其突破性的「混合式專家模型」(Mixture-of-Experts, MoE)架構。

傳統的 LLM 在處理資訊時,會動用模型所有的參數,既沒效率也沒必要。MoE 架構將模型切分成許多「專家網路」,每次只會根據輸入的內容,啟動最相關的幾個專家來處理,大幅降低了運算成本。而 Nemotron-3 更進一步,採用了獨特的「混合 Mamba-Transformer MoE」骨幹。 這是一個精巧的組合:

- Transformer 層: 這是我們所熟知的 LLM 核心,擅長精準的邏輯推理和理解複雜的結構關係,例如數學計算或程式碼分析。

- Mamba 層: 這是近年備受矚目的新興架構,它在處理超長序列的資訊時,記憶體開銷低且效率極高,能長時間記住上下文而不迷失。

- MoE 路由: 作為指揮中心,負責在 Transformer 的深度與 Mamba 的廣度之間進行智慧調度,確保每個 token 都由最適當的專家組合來處理。

這個混合架構帶來了驚人的效益。首先是速度與效率,Nemotron-3 Nano 的 token 處理量是前代的 4 倍,同時將推理成本降低了高達 60%。 其次是超凡的記憶力,得益於 Mamba 架構的加持,Nemotron-3 擁有高達 100 萬 token 的上下文視窗(Context Window)。 這意味著一個 AI 代理可以一次性讀完一本厚厚的書、一份完整的財報,或是一個龐大專案的全部程式碼,並在整個任務過程中保持對全局的理解,極大地減少了「情境漂移」的問題。

關鍵二:為真實世界任務而生的強化學習

一個合格的 AI 代理,不能只會紙上談兵,它必須學會在真實世界的數位環境中「動手做事」。這意味著它需要理解如何依序執行指令、如何正確使用外部工具(如 API)、以及如何從錯誤中學習並修正計畫。傳統的單輪問答式訓練,無法教會模型這些複雜的連續行為。

為此,NVIDIA 引入了「多環境強化學習」(Multi-environment Reinforcement Learning)的訓練方式,並開源其訓練平台 NeMo Gym。 這就像是為 AI 代理們打造的一個虛擬健身房和試煉場。在這個平台中,模型不再是僅僅為了生成「正確答案」,而是為了完成一系列可被驗證的「動作序列」而接受獎勵或懲罰。

例如,一個代理的任務可能是「寫一段能正常運作的 Python 程式碼」。在 NeMo Gym 中,它會生成程式碼(動作 1),然後在虛擬環境中嘗試執行(動作 2),如果出現錯誤,它會接收到負面回饋,並嘗試除錯(動作 3),直到程式碼成功運行並得到正面獎勵。 這種基於「軌跡」的訓練,讓模型學會了可靠地執行多步驟工作流程,更貼近 AI 代理在真實世界中的應用情境。 將 NeMo Gym 開源,更意味著開發者可以利用這個平台,為自己客製化訓練環境,打造出高度專業化的 AI 代理。

關鍵三:史無前例的「真」開放生態系

在 AI 領域,「開放」是一個經常被使用,但定義模糊的詞。有些模型僅開放了權重,卻對其訓練資料和方法諱莫如深。NVIDIA 這次開放程度卻是全方位的。

- 開放模型權重: Nemotron-3 家族的模型權重在 NVIDIA Open Model License 之下公開釋出,開發者可以自由下載、修改和部署。

- 開放訓練資料集: 這是最令人驚訝的一部分。NVIDIA 釋出了高達 3 兆 token 的全新 Nemotron 預訓練、後訓練及強化學習資料集。 這包含了用於推理、程式碼和多步驟工作流程的豐富範例。更重要的是,他們還提供了一個名為「Nemotron Agentic Safety Dataset」的安全資料集,幫助研究人員評估和緩解代理系統潛在的安全風險。 這種資料層面的透明度,在業界極為罕見。

- 開放工具與程式碼: 除了 NeMo Gym,NVIDIA 還開源了 NeMo RL 強化學習函式庫、NeMo Evaluator 評估工具,並在 GitHub 上提供了詳細的訓練和對齊內容。 這意味著,從資料處理、分詞器配置,到模型的預訓練和強化學習對齊,整個流程的關鍵步驟都是可重現、可客製化的。

這種「模型 + 資料 + 工具」的徹底開放, 對於需要建立符合自身數據、法規和價值觀的「主權 AI」(Sovereign AI)的組織而言,尤其具有無可取代的價值。

TN科技筆記的觀點

隨著 NeMo 框架、NIM 微服務,以及現在的 Nemotron-3 家族問世,NVIDIA 顯然不滿足於只提供硬體。他們正在提供一套完整的「AI 生產線」:從最底層的晶片(硬體),到 CUDA (軟體),再到 Nemotron(開發框架與基礎模型),最後是 NIM(部署方案)。透過將每一個環節都做到極致,並以「開放」的姿態邀請開發者進入這個生態,NVIDIA 正在巧妙地定義未來 AI 的開發標準,讓開發者一旦進入,就很難離開。

此外,近期高效能的開源模型很大程度上由多家中國科技巨頭 (如 DeepSeek、 Qwen) 所定義。NVIDIA 此時推出 Nemotron-3,不僅是為全球開發者,特別是西方企業,提供了一個來自美國頂級 AI 公司的全新高品質選項,它也為開源社群注入了一股關鍵的制衡力量。這實則是相當高明的商業佈局。NVIDIA 深知,一個蓬勃發展、百花齊放的開源 AI 生態,才是其硬體業務最肥沃的土壤。透過免費提供頂級模型、資料與工具,他們極大地降低了 AI 創新的門檻,激勵成千上萬的開發者去打造更複雜、更消耗算力的應用。而這些應用的最終訓練和部署,都將回到對 NVIDIA GPU、軟體與服務的龐大需求上。這不僅是「賣鏟子」,更是親自下場教大家如何淘金,確保所有人都來買他的鏟子。

而 AI 逐漸演變為能主動執行多步驟任務的代理時,其安全與倫理邊界將變得格外重要。一個指令錯誤,或是一個被惡意利用的代理,可能造成的後果遠超想像。儘管 NVIDIA 釋出安全資料集,但如何確保成千上萬由不同開發者客製化的代理,其行為都與人類的價值觀「對齊」,是一個巨大且尚無標準答案的挑戰。

支持TN科技筆記,與科技共同前行

我是TN科技筆記,如果喜歡這篇文章,歡迎留言、點選愛心、轉發給我支持鼓勵~~~也歡迎每個月請我喝杯咖啡,鼓勵我撰寫更多科技文章,一起跟著科技浪潮前進!!>>>>> 請我喝一杯咖啡

在此也感謝每個月持續請我喝杯咖啡的讀者以及新加入的讀者們,讓我更加有動力為各位帶來科技新知!

以下是我的 threads 也歡迎追蹤、回覆、轉發喔!

>>>>> TN科技筆記(TechNotes)