HBR(哈佛商業評論)2025 年 12 月發了一篇反向研究 — AI 號稱讓招募「更公平」、實際強化某些歧視。

很多公司買履歷篩選 AI 的賣點是「消除人類偏見」 — HR 不再憑直覺、AI 根據資料客觀判斷。

HBR 打臉:AI 不是消除偏見、是把公司過去的偏見鎖進系統、放大 100 倍。

很多台灣 CHRO 會說:「我們用大廠 AI、應該沒問題吧。」

錯。越大廠的 AI 越危險 — 因為它用更多資料訓練、所以「鎖」得更深。

這篇拆給你看:AI 為什麼反而強化歧視、3 個真實案例(含 Amazon 著名失敗)、台灣 HR 怎麼避開、CHRO 給 3 件事。

AI 招募的「公平」是什麼?

賣 AI 履歷篩選的廠商會說:

- 「不看名字、不看性別、不看年齡」

- 「只看技能、經驗、學歷」

- 「比人類客觀」

聽起來公平。但實際上 — AI 訓練資料來自公司過去 10 年的招募決定。

如果公司過去 10 年:

- 偏好招大學以上學歷

- 偏好 25-35 歲

- 偏好台清交

- 偏好男性工程師

AI 學到的不是「公平」 — 是「過去公司是怎麼歧視的、我也照著做」。

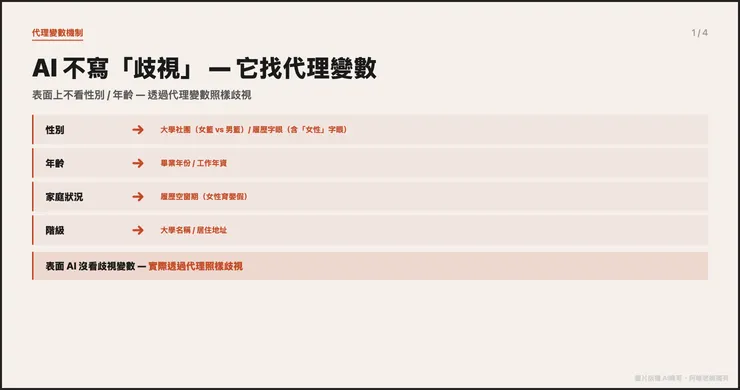

而且 AI 不會直接寫「歧視性別」 — 它會找代理變數:

- 性別 → 大學社團(女籃 vs 男籃)

- 年齡 → 畢業年份

- 家庭狀況 → 履歷空窗期(女性育嬰假)

表面上 AI 沒看「性別」、實際上透過代理變數照樣歧視。

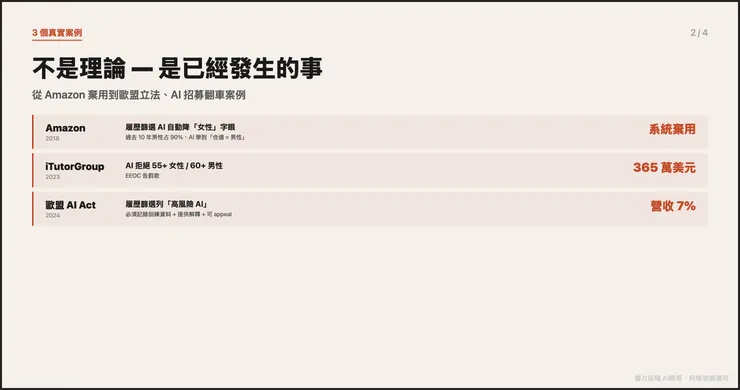

3 個真實案例

案例 1:Amazon 履歷篩選 AI(2018)

Amazon 自己訓練 AI 篩工程師履歷、用過去 10 年資料。結果 AI 自動降低「含『女性』字眼的履歷」(例如「女子棋藝社」、「女子大學」)。

原因:Amazon 工程師團隊男性占 90%、AI 學到「合適候選人 = 男性特徵」。

Amazon 修不好、最後整個系統棄用。

案例 2:iTutorGroup 年齡歧視(2023)

美國線上教育公司 iTutorGroup 用 AI 篩英語老師。AI 自動拒絕女性 55+、男性 60+。

EEOC(美國平等就業機會委員會)告 iTutorGroup、罰款365 萬美元(約 1.1 億台幣)。

案例 3:歐盟 AI Act(2024 開始)

歐盟把履歷篩選 AI 列為「高風險 AI」、企業必須:

- 記錄 AI 訓練資料來源

- 提供「為什麼拒絕這位候選人」的解釋

- 讓被拒的候選人有 appeal 機會

- 每年提交 audit 報告

沒做到 — 罰款上限公司全球年營收的 7%。

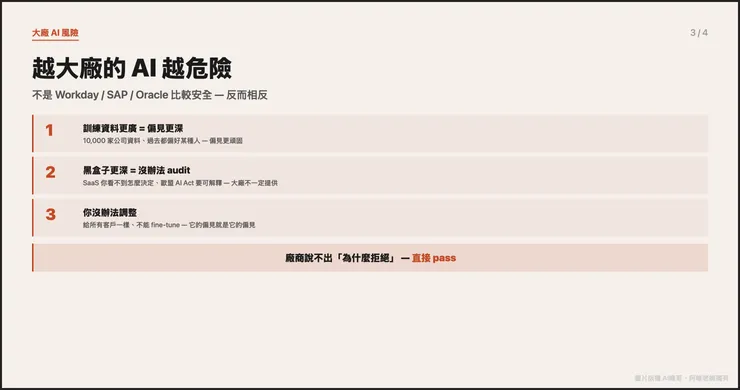

為什麼大廠 AI 更危險?

很多 CHRO 想:「Workday / SAP / Oracle 這種大廠 AI 應該安全。」

反而更危險。原因:

1. 訓練資料更廣 = 偏見更深

大廠 AI 用 10,000 家公司資料訓練、不是 1 家。如果這 10,000 家公司過去都偏好某種人 — AI 學到的偏見比 1 家更頑固。

2. 黑盒子更深 = 沒辦法 audit

大廠 AI 是 SaaS、你看不到它怎麼決定。歐盟 AI Act 要求「可解釋」 — 大廠不一定提供。

3. 你沒辦法調整

大廠 AI 是「給所有客戶一樣」、你不能 fine-tune 給你公司用。它的偏見就是它的偏見。

台灣 HR 怎麼避開?

第 1 步:別用 AI 做最終決定

AI 可以做「初步排序」 — 但不能做「自動拒絕」。所有被排到後段的、HR 要再人工 review 一次。

第 2 步:要求廠商提供 audit 報告

採購 AI 履歷篩選工具前、要求廠商:

- 訓練資料來源

- 已知的偏見(性別 / 年齡 / 學歷 / 地區)

- 提供「為什麼拒絕」的解釋功能

- 提供 appeal 流程

廠商說「不能提供」 — 直接 pass。

第 3 步:建內部 audit 機制

每月看:

- AI 拒絕的候選人 — 性別比例?年齡分布?學歷分布?

- 跟整體投遞池比 — 有沒有偏差?

偏差 > 20% 就要查。

第 4 步:保留「人工審查」的最終決定

AI 篩選 → HR 看 top 30%、人工排序 → 主管面試 → 主管 + HR 共同決定。

AI 只在第 1 步、不能在最後 1 步。

給 CHRO 的 3 個動作

- 不採購「不能解釋的」AI — 廠商說不出來「為什麼拒絕」、就是黑盒子、別買

- 每月自己 audit — 不要相信廠商「我們很公平」、自己看數據

- HR 留最終決定權 — AI 是 top 30% 排序工具、不是 top 3% 篩選器

HBR 研究不是給你「不要用 AI」的訊號 — 是給你「用 AI 但要知道它的偏見」的提醒。

關鍵不是 AI 公不公平 — 是CHRO 知不知道自己公司過去是怎麼歧視的。

會用、懂用、好用、每天用 — AI 不是工具、是「會把公司過去偏見放大的鏡子」。

你是機長,AI 是機組人員 — CHRO 決定治理框架、AI 處理初篩、HR 做最終決定。

HBR 已經告訴你 — AI 不是消除偏見、是放大它。CHRO 不知道公司過去怎麼歧視、AI 就照著做。

📎 本文資料來源

- HBR: New Research on AI and Fairness in Hiring(2025-12)

- Reuters: Amazon scraps AI recruiting tool(2018)

- EEOC: iTutorGroup 365 萬美元和解(2023)

「AI 不是消除偏見、是放大它。CHRO 不知道公司過去怎麼歧視、AI 就照著做。」

關於阿峰老師

阿峰老師(黃敬峰),交點文化股份有限公司創辦人暨執行長,超過 10 年企業培訓經驗,累積服務超過 400 家企業。

📌 最近在忙什麼

剛完成一家會計事務所的 AI 輔助稅務申報設計 — 報稅季加班時數預估砍一半。HR 部門也跟著導入 AI 履歷初篩、但保留人工 audit 機制 — 確保 AI 不會把過去 10 年的偏見鎖進系統。

🎯 想幫團隊導入 AI? 提供免費 30 分鐘線上諮詢。

📧 ai@autolab.cloud | 📱 LINE:0976715102(說「企業培訓」)

🌐 www.autolab.cloud | 📚 課程活動