來自加州大學聖地牙哥分校(UC San Diego)研究人員發現:在特定的實驗條件下,OpenAI 的大型語言模型 GPT-4.5 似乎成功「通過」了圖靈測試!但這是否真的意味著 AI 達到了人類般的智慧?這項研究的細節又是什麼?今天就讓我們深入剖析這份研究,看看 GPT-4.5 到底做了什麼,以及我們該如何客觀看待這個「里程碑」。

圖靈測試:AI 智慧的經典試金石

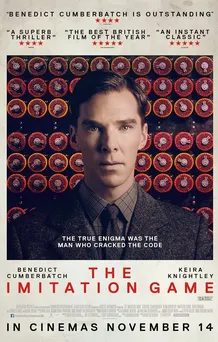

在深入探討研究之前,先來說明一下什麼是「圖靈測試」(Turing Test)。這個概念由英國電腦科學之父艾倫·圖靈(Alan Turing)在 1950 年提出,是一個用來判斷機器是否能展現出與人類無法區分的智能行為的測試。

最經典的圖靈測試形式是「模仿遊戲」(Imitation Game):一位人類提問者,透過文字介面,同時與一位真人以及一台機器進行對話。提問者不知道哪邊是真人、哪邊是機器。如果在一段時間的對話後,提問者無法可靠地分辨出誰是機器,或者錯誤地將機器判斷為人類,那麼這台機器就被認為通過了圖靈測試。

雖然圖靈測試自提出以來就充滿爭議(例如,它是否真的能測量「智慧」或「意識」),但它仍然是衡量 AI 模仿人類對話能力的一個重要參考基準。

突破圖靈測試的關鍵:Persona Prompt

這次來自加州大學聖地牙哥分校(UC San Diego)的研究,正是採用了圖靈測試的經典三方架構(一個提問者、一個真人、一個 AI)。研究人員招募大學生和線上工作者作為提問者,讓他們與隨機分配到的真人或 AI 進行 5 分鐘的文字聊天。聊天結束後,提問者需要判斷與自己對話的對象是真人還是 AI。

實驗測試了多個 AI 模型,包括:

- GPT-4.5(Persona) - 帶有「人設相關的」Persona Prompt

- Meta 的 LLaMA 3.1-405B(Persona) - 帶有「人設相關的」Persona Prompt

- GPT-4.5 - 無「人設相關的」Prompt

- LLaMA 3.1-405B - 無「人設相關的」Prompt

- GPT-4o - 基準模型

- ELIZA - 早期聊天機器人,作為基準

結果發現:

- GPT-4.5 (Persona) 表現驚人:

當研究人員給予 GPT-4.5 一個特定的「人設相關的」 Persona Prompt,例如扮演一個「內向、有點宅的 19 歲青年」或「熟悉流行文化的年輕人」時,高達 73% 的提問者將 GPT-4.5 誤認為是人類! 這個比例遠遠超過了 50% 的隨機猜測水平,在許多非正式的討論中,這通常被視為「通過」圖靈測試的門檻。 - LLaMA 3.1 (Persona) 也有亮眼表現:

同樣在給予Persona Prompt後,Meta 的 LLaMA 3.1 也有 56% 的時間被認為是人類。雖然這個比例在統計上與 50% 的隨機猜測沒有顯著差異,但這也相對代表提問者無法有效地區分它和人類。 - Persona Prompt是關鍵:

對比之下,沒有獲得Persona Prompt的 GPT-4.5 和 LLaMA 3.1,被誤認為人類的比例分別驟降至 36% 和 38%。而更早的模型如 GPT-4o (21%) 和 ELIZA (23%) 表現更差。可見Persona Prompt對於提升 AI 在圖靈測試中表現的重要性。 - AI 似乎比真人更像人:

最有趣的結果是,在同一個實驗中,真正的真人參與者被提問者正確辨識為人類的比例只有 67%。換句話說,在這次 5 分鐘的短暫互動中,帶有人設的 GPT-4.5 (73%) 比真人 (67%) 更容易讓人相信它是人類!

為何 GPT-4.5 能如此「騙」過人類?

研究結果顯示,GPT-4.5 (Persona Prompt) 的成功,並非來自於展現超凡的知識或邏輯推理能力。相反地,提問者在判斷時,更側重於以下幾個方面:

- 社交與情感線索: AI 是否能進行自然的閒聊、表達適當的情感反應、理解並回應社交暗示?

- 互動動態: 對話是否流暢、自然?回應是否及時且相關?

- 語言風格與個性: AI 的用詞、語氣、句子結構是否像一個特定類型的人?是否展現出一貫的個性?

有趣的是,研究發現有時候「缺乏知識」或展現某些「小瑕疵」反而被視為更像人類的特徵。這表明,當前的 LLM 在模仿人類對話的「風格」和「感覺」方面取得了長足進步,尤其是在有人設提示引導下,更能生成符合特定角色的、細膩且富有個性的回應。

冷靜看待:有關於圖靈測試研究限制

看到這裡,可能已經要宣布 AI 「通過圖靈測試」,但在這之前,有幾件事需要說明:

- 研究狀態:這份研究目前仍處於「Under review」狀態,尚未經過學術界的「同行評審」(Peer Review)程序。同行評審是科學研究發表前的標準流程,由領域內的其他專家匿名審查研究方法、數據分析和結論的嚴謹性與合理性。因此,我們必須對該篇研究的相關結論持保留態度,其結論應被視為有待驗證的,可能存在錯誤或需要在後續評審中修改。

- 測試時間過短: 5 分鐘的聊天是否足以判斷「智慧」?目前有部分認為,短時間的模仿可能只是「聰明的鸚鵡」,而非真正理解。更長時間、更深入的對話或任務才能更全面地評估 AI 的能力。

- 「通過」的定義模糊: 圖靈測試本身其實還沒有一個全球公認的、標準化的通過標準。這次研究設定的 50% 門檻只是一個非正式的參考。

讚嘆但保持批判性思考:AI 的未來與挑戰

GPT-4.5 在特定條件下仍展現出高度擬人化對話能力,甚至在「裝得像人」這方面短暫超越了真人。儘管存在上述限制,仍然具有重要意義值得我們思考:

- AI 模仿能力的躍進: 研究者清晰地展示了頂尖 LLM 在模仿人類對話細微之處(如風格、語氣、情感暗示)方面的驚人進步。

- 「偽造的人」的可能性: 正如研究者所討論的,這種高度擬人化的 AI 可能被用於製造「偽造的人」(Counterfeit People),在社交媒體、客服甚至網路詐騙中帶來新的挑戰。

- 人機互動的變革: 未來的聊天機器人、虛擬助理將可能變得更加自然、更具情感連結,但也可能更具欺騙性。

- 分辨 AI 的重要性: 我們或許也開始需要提升大眾分辨 AI 生成內容、理解 AI 能力與局限的素養,以應對日益模糊的人機界線。

我們驚訝於技術進步的同時,更需要保持清醒的頭腦和批判性的眼光,深入理解其能力邊界,並為隨之而來的社會、倫理挑戰做好準備。未來,人與 AI 的界線將越來越模糊,如何應對這個新時代,是我們每個人都需要思考的問題。

論文連結:Large Language Models Pass the Turing Test

我是TN科技筆記,如果喜歡這篇文章,歡迎留言、點選愛心、轉發給我支持鼓勵~

也歡迎每個月請我喝杯咖啡,鼓勵我撰寫更多科技文章,一起跟著科技浪潮前進!!

>>>請我喝一杯咖啡