別讓技術突破的喧囂掩蓋了真正的挑戰。AI 的未來,其實是一場關於人才、倫理與法規的博弈。

當我們談論人工智慧(AI)時,腦海中浮現的往往是 ChatGPT 的對答如流、Midjourney 的驚人畫作,以及隨之而來的——關於人類工作將被取代的焦慮。

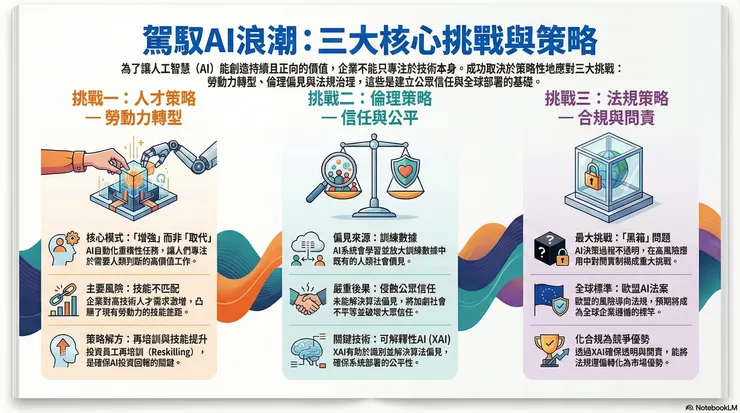

然而,這些都只是 AI 革命的表象。對於企業領導者與決策者而言,AI 成功的關鍵,從來就不僅僅在於演算法有多先進,或算力有多強大。真正的戰場,在於三個更深層次、卻經常被忽視的策略性挑戰:人才(Talent)、倫理(Ethics)與法規(Regulation)。

這三大基石構成了一個緊密相連的戰略場域。任何一個環節的失誤,都可能導致企業在 AI 時代的整體戰略崩潰。以下我們將逐一拆解這三大挑戰。

挑戰一:真正的威脅不是「被取代」,而是「技能錯配」

首先,我們需要破除一個最大的迷思:「AI 將導致大規模失業」。

事實上,AI 的核心價值在於「增強(Augmentation)」而非單純的「取代」。它的強項在於自動化那些重複性高、繁瑣的常規任務,將人類從枯燥的表格與數據整理中解放出來。這賦予了員工更寶貴的資產——時間,使他們能專注於 AI 無法輕易複製的高價值職責:複雜的判斷力、人際關係的建立,以及策略性思維。

當前最緊迫的挑戰並非失業,而是「技能不匹配(Skills Mismatch)」。

數據顯示,積極投資 AI 的企業,對高學歷與高技術技能人才的需求正顯著增加。這意味著,企業不能只是引進軟體,更必須將策略重點放在「人」身上。

- 勞動力再培訓(Reskilling): 幫助員工適應新角色。

- 技能提升(Upskilling): 讓員工學會與 AI 協作。

唯有將「人」視為轉型的核心,企業才能真正享受到 AI 帶來的紅利。

挑戰二:AI 是一面鏡子,它繼承了我們最壞的缺點

AI 模型並非憑空誕生,它們是人類社會的鏡像。

一個令人警醒的事實是:AI 系統會不可避免地繼承、甚至放大訓練數據中既有的人類偏見。 由於 AI 是由人類製造、使用人類產生的數據進行訓練,數據中隱藏的性別、種族或社會階級偏見,極有可能轉化為「算法偏見」。

試想一下,如果一個用於招募的 AI 系統,因為歷史數據的偏差,而傾向於過濾掉特定背景的求職者,這不僅加劇了社會不平等,更會從根本上侵蝕大眾對該企業的信任。

解方:可解釋性人工智慧(XAI)

為了對抗這個問題,「可解釋性人工智慧(XAI)」成為了關鍵工具。我們不能容忍 AI 是一個「黑箱」。透過實施 XAI,企業能確保:

- 決策透明: 尤其是在招募、績效評估等高風險領域。

- 主動抵抗偏見: 確保系統決策符合倫理標準。

挑戰三:打開「黑箱」,將合規從成本轉為競爭優勢

深度學習模型雖然強大,但其複雜的決策過程往往令人難以理解。在醫療、金融等高風險領域,這種「不透明性」構成了巨大的策略風險。

如果我們不知道 AI 為何做出某個決定(例如拒絕貸款或診斷疾病),我們又該如何為其結果負責?

這不僅是技術問題,更是法律問題。全球監管框架正在迅速成形,歐盟的《人工智慧法案》(EU AI Act)便是一個強烈的訊號。其「基於風險」的監管方法預期將成為全球標準。

投資透明度,是生存的必要條件

在這個背景下,投資 XAI 技術不再是一個選項,而是一項「策略必要性」。遵守監管框架要求組織必須優先考慮:

- 透明度

- 可審計性

- 負責任的部署

那些能率先將強大的數據治理整合到系統中的公司,不僅能滿足監管要求,更能將「合規」轉化為競爭優勢——因為在這個充斥著不確定性的時代,「可被信任」將是企業最強大的護城河。

總結來說,企業若想在 AI 時代建立持久的領導地位,不能只盯著技術指標看。我們必須將人力資本、倫理義務與法規遵循視為建構信任、韌性與長期獲利能力的基石。這不是單純的「問題管理」,而是打造一個能蓬勃發展的 AI 原生組織的唯一途徑。