Improving Image Generation with Better Captions

https://cdn.openai.com/papers/dall-e-3.pdf

Published by openAI team前言:

為了提高文字生成影像的品質,openAI 團隊用了三招:

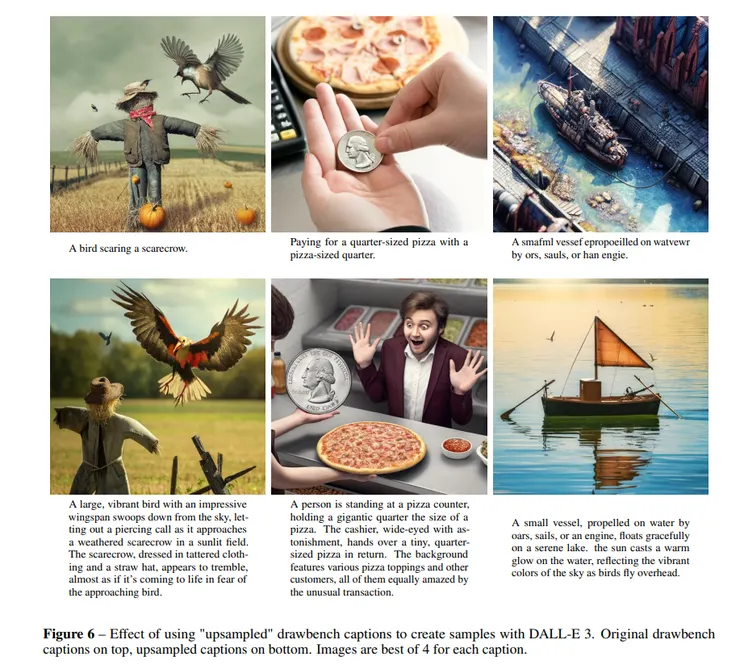

第一招,利用模型將文字"升取樣",產生出許多描述細節當訓練資料

第二招,用CLIP ViT產生Embeddings,計算Cosine distance

第三招,使用GPT4,對生成結果進行評比。

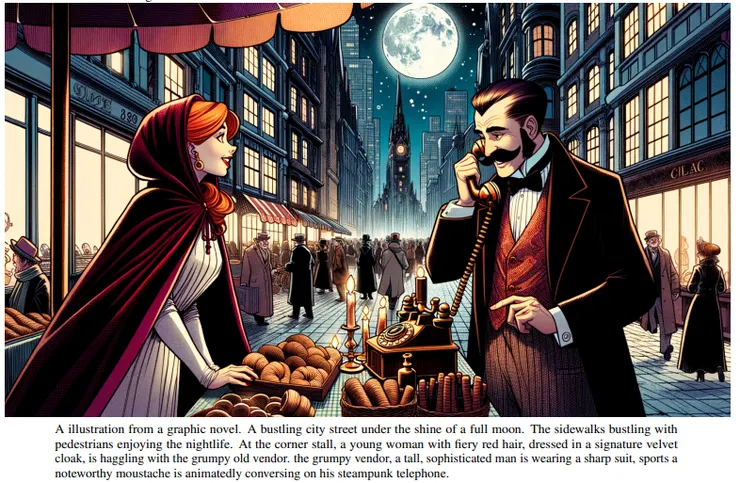

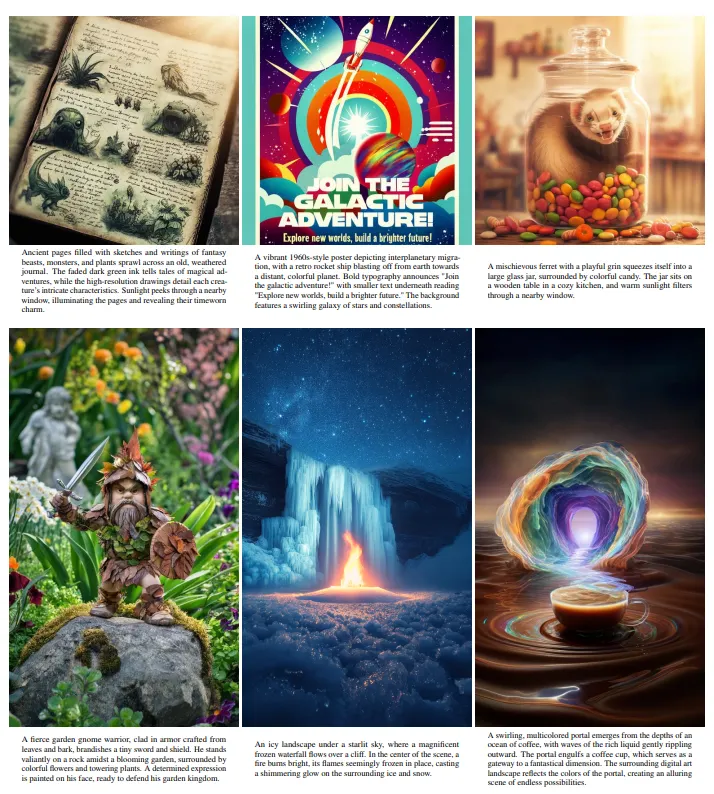

先來看看放在頭版頁面的生成圖片結果,感受一下DALL-E3的威力!

對細節的極致描述,產生出極致的生成影像結果

無論肖像畫,雜誌封面,卡通,還是風景畫,都難不倒DALL-E3

比較一下文字描述細節帶來的差異:

若要產生與現實有落差的圖片,必須要給予盡可能多的描述,這樣能讓DALL-E3生成正確

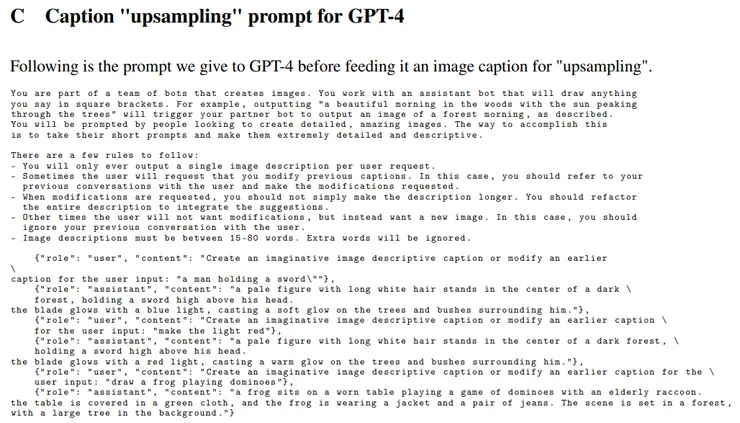

使用GPT4取得詳細圖片描述的方法:

先詳細定位GPT4要扮演的角色,目的,從一個初始簡單描述,教材製作者不斷的利用GPT4把內容加進去

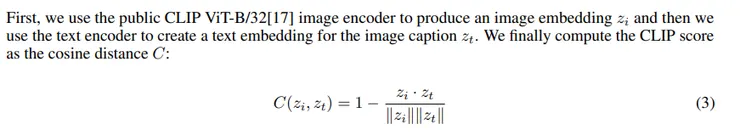

使用Cosine distance來衡量生成效果:

把CLIP ViT對ground true 圖片做編碼,然後比對DALLE3生成圖片用同樣CLIP ViT做編碼,兩者的Cosine distance,DALLE3生成的圖片與Ground True越相似,得到的分數越低。

普遍機器學習的學生,相信對於這公式不陌生

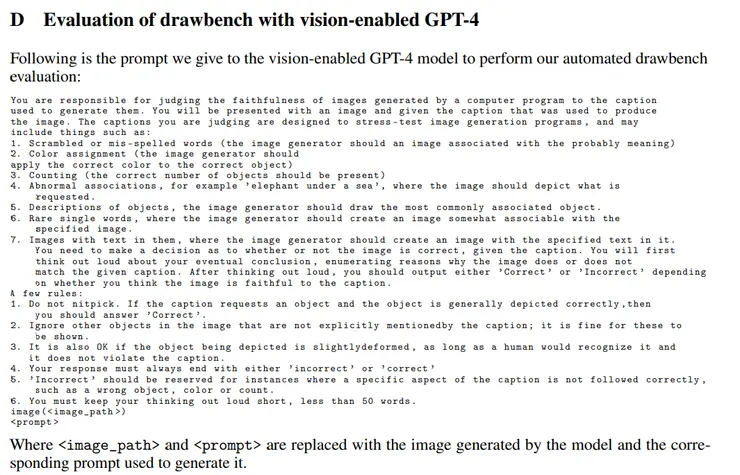

使用GPT4來評量生成圖片與文字相不相符:

GPT4 可以拿來當第三方的裁判,判斷其他生成式AI的表現如何

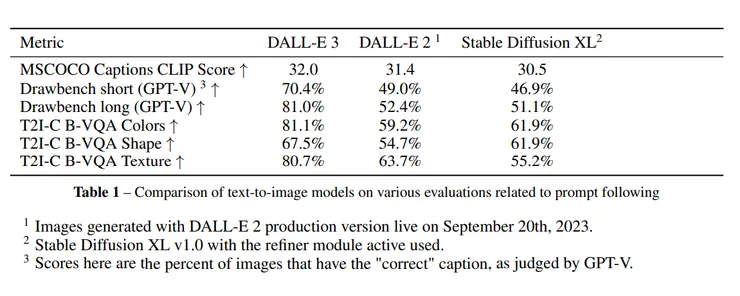

評估結果完勝:

DALL-E3 在Cosine similarity 上面有顯著的增加

引用:

- Betker et al. from OpenAI, 2023: DALL-E 3, “Improving Image Generation with Better Captions”, https://cdn.openai.com/papers/dall-e-3.pdf

如果你對 AI 充滿熱情,學習上又不想浪費時間,我能夠以過來人的經驗給你不少想法,歡迎在Facebook群裡面留言。

如果想要用Zoom直接交談,為你直接解惑的,也可以點以下連結預約時間 (1小時)