這篇整理新考綱裡一個常被混淆的主題——當 LLM 產出不對的時候,到底該用哪種技術來修正。三個選項(提示工程、RAG、LoRA)解決的是不同問題,錯用會付出不必要的成本。

先理解 AI 為什麼會幻覺

要選對工具,得先搞懂問題的本質。

GPT、Claude 這類 LLM 的技術定位是「下一個詞的預測器(Next Token Predictor)」。它回答問題時不是在查資料庫,而是在計算「接下來出現什麼詞的機率最高」。

這就是幻覺的根源——對模型來說,編一個「10% 定存利率」跟陳述事實「1.5% 利率」,在演算法的評分上是一樣的。它追求的是「機率上的合理」,不是「事實上的正確」。

理解這個本質之後就知道,光靠「讓模型變聰明」解決不了幻覺。要解決這件事,得從系統架構層下手。

三種控制方式

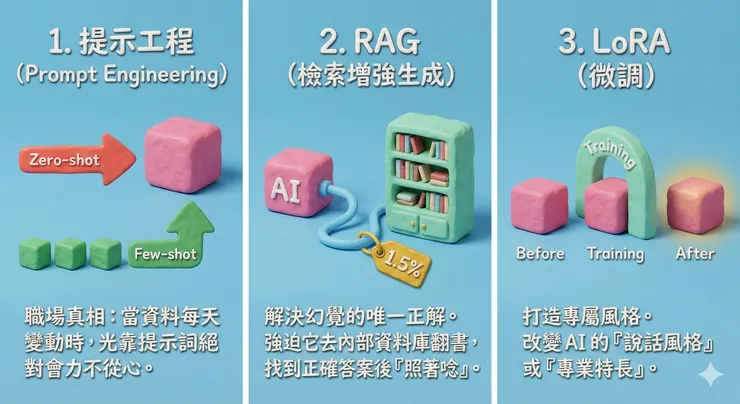

一、提示工程(Prompt Engineering)——最輕量的方式

就是在輸入時下明確指令。常見的兩種做法:

- Zero-shot(零樣本):直接下指令,不給範例。

- Few-shot(少樣本):在指令裡附上幾個範例,讓模型模仿格式或邏輯。

適合的場景:任務邏輯簡單、資料不需要動態更新。

邊界:當公司資料每天都在變(匯率、庫存、內部政策),光靠提示詞撐不住。模型不會因為你下指令就知道今天的匯率。

二、RAG(Retrieval-Augmented Generation,檢索增強生成)——解決事實類幻覺的主流方式

用一個比喻:這是「開卷考試」。

運作邏輯是——在 LLM 回答之前,先讓它去查公司內部的資料庫(通常是向量資料庫),把相關資料撈出來,再基於這些資料生成回答。

重點是:模型不需要「背」這些資料,它只需要在回答前「查」這些資料。資料庫寫的是 1.5%,模型就不會說成 10%。

適合的場景:需要事實準確性、資料會變動、有公司內部知識要整合的情境。

三、LoRA(Low-Rank Adaptation)——微調的一種輕量方法

這裡要先釐清一個常見誤區:LoRA 不是拿來「教模型新知識」的。它的用途是調整模型的「風格」或「專業傾向」。

適合的場景:

- 希望模型用特定語氣說話(公司官方口吻、特定品牌風格)

- 希望模型產出特定格式的內容(公司內部程式碼規範、特定文件格式)

- 在特定領域強化表達風格(法律文書語氣、醫療報告用詞)

邊界:LoRA 不解決幻覺。如果問題是「模型講錯事實」,LoRA 訓練再多次也不會變成事實正確,只會讓錯誤的事實被講得更像公司風格。

考題方向

考題常見的陷阱是——給一個「AI 講錯事實」的情境,選項裡故意放 LoRA 當誘答,測考生會不會誤選。

標準的判斷流程是:

一、問題是「事實錯誤」還是「風格不對」。 二、事實錯誤 → RAG。風格不對 → LoRA。邏輯簡單的一次性任務 → Prompt。

「10% 利率災難」這類情境的關鍵字是「事實查核」,正確方向是 RAG,不是微調。微調在這個場景是無效的投入。

延伸:多模態應用的整合

新考綱也會考到這三種技術怎麼跟多模態結合。一個完整的應用系統可能會同時用到:

- 文本層:LLM + RAG(確保事實正確)+ LoRA(統一語氣風格)

- 視覺層:擴散模型(Diffusion)生成形象 + ControlNet 控制動作細節

- 語音層:VITS 這類端到端模型生成自然語音

這裡的重點不是把每個模型記起來,而是理解——每一層都有對應的技術選擇邏輯,規劃師要做的是根據需求組合出合理的架構,不是挑最新的工具硬塞。

自己整理下來的備考方向

一、Prompt、RAG、LoRA 三者不是強度差別,是解決不同問題。把這三個工具各自解決的問題記清楚,選擇題就不會錯。

二、RAG 對應「事實」、LoRA 對應「風格」,這是最核心的區分。考題會用各種情境描述包裝,但底層的判斷永遠是這兩條。

三、幻覺問題的答案方向永遠是 RAG 或「人類審核」這類系統設計,不會是「繼續訓練模型」。這個邏輯跟前面整理過的治理章節(Human-in-the-loop)是連動的。

這個主題在新考綱的權重不低,但底層邏輯很清楚。理解「為什麼會幻覺」之後,三種工具的定位就各歸各位了。