我想要一天分享一點「LLM從底層堆疊的技術」,並且每篇文章長度控制在三分鐘以內,讓大家不會壓力太大,但是又能夠每天成長一點。

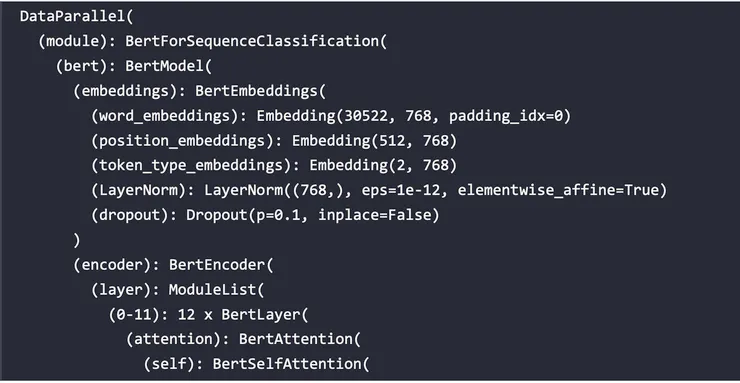

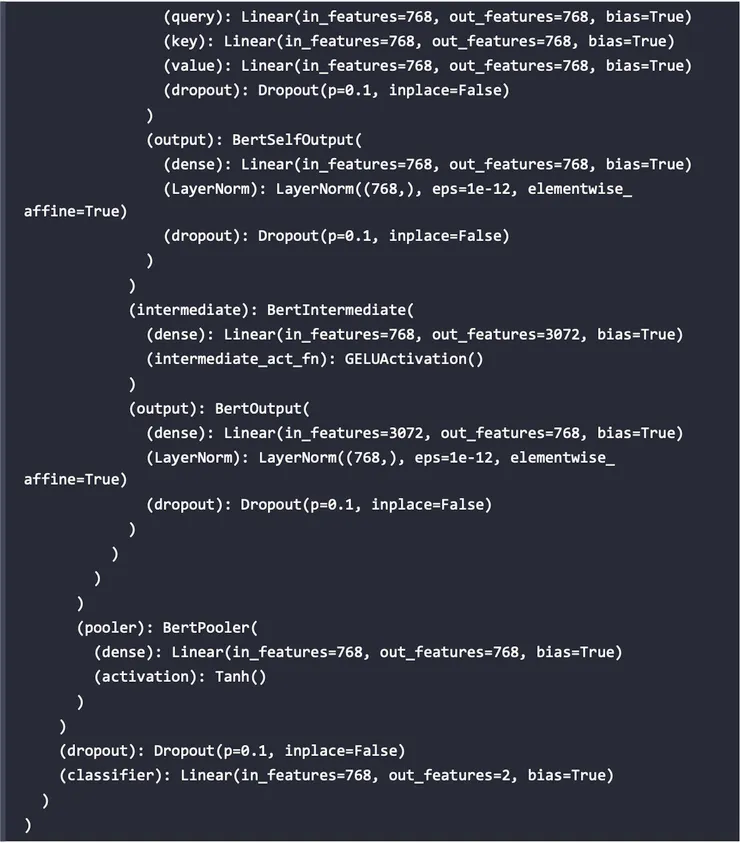

現在我們要把 BERT 的 Pretrained 模型從 Hugging Face 上載入,程式為:

model = BertForSequenceClassification.from_pretrained("bert-base-uncased", num_labels = 2)

model = nn.DataParallel(model)

model.to(device)

可以看一下內部的結構是如何:

相關參數說明可以見:AI說書 - 從0開始 - 131 與 AI說書 - 從0開始 - 141