本文將帶你快速了解如何使用DeepSeek R1 + 類似ChatGPT的介面可以與大型語言模型互動

前言

之前寫過一篇 超簡單! 一文理解如何使用私有大型語言模型LLM - Ollama+Open WebUI篇 ,並且有錄製一段過程影片:200 秒內帶你進入私有LLM大型語言模型的世界 - Ollama + Open WebUI,這篇將教你如何使用最近很紅的DeepSeek R1模型,讓我們來一探究竟!

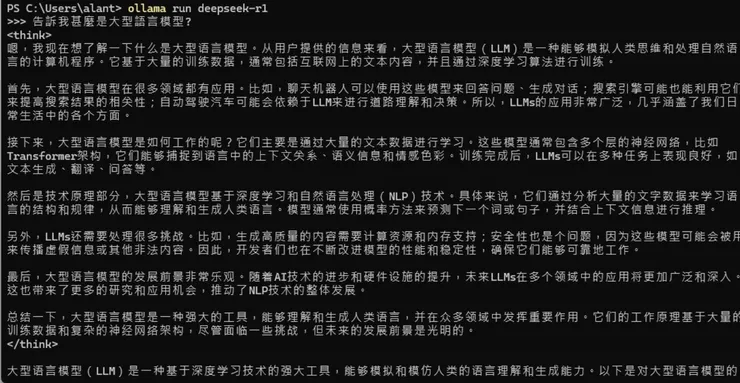

方法1 使用Ollama 透過終端機互動

先去官方 下載 下載Ollama 最新版本

1.1 使用 終端機 與 DeepSeek R1 互動

ollama run deepseek-r1

方法2 Open WebUI

2.1 使用 docker 下載docker

執行 (二擇一):

使用CPU

docker run -d -p 3000:8080 -v open-webui:/app/backend/data --name open-webui ghcr.io/open-webui/open-webui:main

使用GPU

docker run -d -p 3000:8080 --gpus all -v open-webui:/app/backend/data --name open-webui ghcr.io/open-webui/open-webui:cuda

2.2 打開 http://localhost:3000

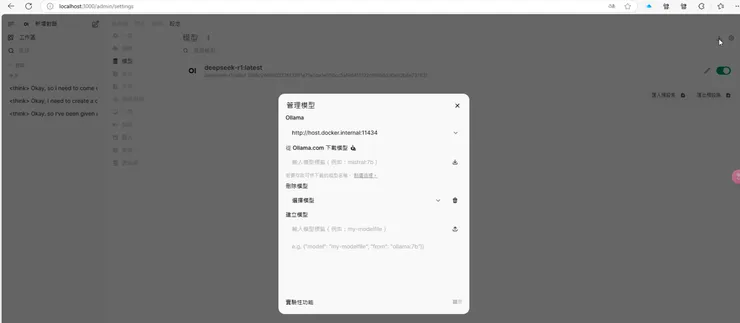

2.3 下載模型

如果沒有在ollama安裝過,請點選左下角>管理員後台>設定>模型>從ollama下載輸入deepseek-r1

就可以看到成果啦 🎉