雖然ChatGPT這種基於大型語言模型(LLM)的助手, 在大部分的場景都能滿足我們的需求, 但也並非完美, 在使用時仍需注意一些隱患。

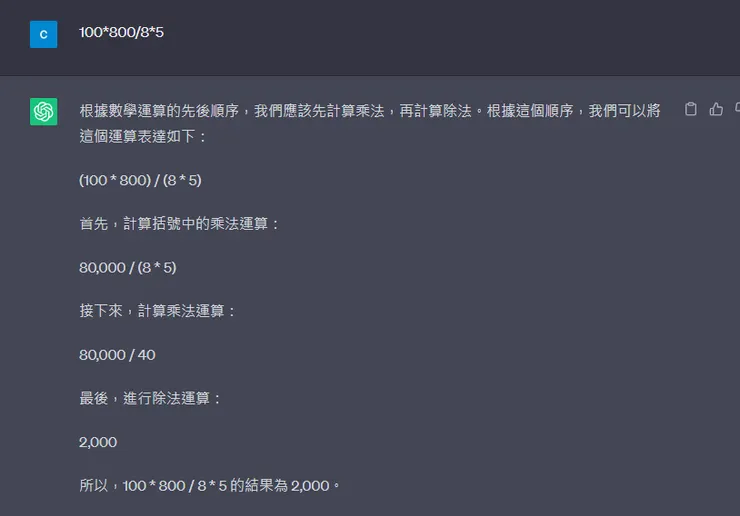

以下是LLM的一些缺陷及需要注意的點。弱弱的數學造成明顯錯誤

過份樂觀帶來錯誤資訊

相信常常使用ChatGPT的朋友應該都有發現到, 不論我們怎麼提問, ChatGPT都能給我們答案, 而這些答案事實上未必精確, 甚至無從查證。

胡思亂想導致偏差

為什麼LLM總能給我們答案呢? 主要是這種生成式的大型語言模型會基於訓練資料進行統計, 得出機率較大的路徑, 但所謂的機率較大並非正確事實, 也有機率給出錯誤的方向, 才會有胡思亂想的發生, 因為我們期望回答A, 但它未必與我們的理解一致, 因此可能給出答案B並添加於A之上, 導致胡思亂想的狀況發生。

偏見引發歧視

即使有安全防護措施,他們有時也會生成性別歧視/種族歧視/同性戀歧視的內容, 開發面對消費者的應用時務必非常小心, 否則造成負面觀感將導致不可收拾的後果。

結語

一開始我們總被LLM的亮點給吸引了, 卻忽略掉背後的缺陷, 而這些缺陷可能在不知不覺中傷害的他人, 因此我們不能完全相信LLM的回答, 而是必須要有自己的獨立思考能力。

底下是幾個相關的主題: