2017 年之前,人工智慧(Artificial Intelligence, AI)領域中的語言模型一直陷在記憶的困境裡。從最早期的 n-gram 統計模型(簡單的說就是一句話的下一個字,只和前 n-1 個字有關),到後來廣泛應用的遞歸神經網路(Recurrent Neural Network, RNN)與長短期記憶單元(Long Short-Term Memory, LSTM),這些技術看似推動了自然語言處理(Natural Language Processing, NLP)的進步,實則始終無法真正解決語言理解的關鍵瓶頸。語言模型總是像個健忘的學生,記得眼前的一兩個字,卻總是遺漏了語句前後的深層關聯。

尤其是面對長句或段落時,這些模型表現得力不從心。RNN 雖然透過遞歸結構處理序列資料,理論上具備捕捉前後文的能力,但實際上,記憶會隨著序列長度而衰減,前面輸入的資訊容易在計算過程中被稀釋甚至遺忘。LSTM 作為 RNN 的改良版本,但它仍然需要逐步處理序列,計算無法有效平行化,訓練效率受限。Attention is All You Need

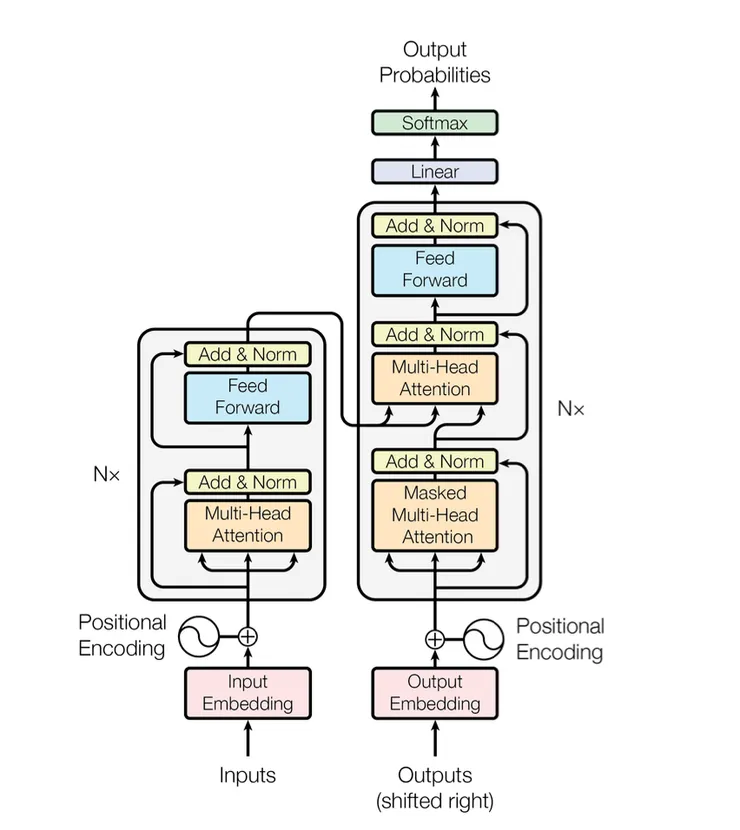

Transformer 模型,展示編碼器(Encoder)與解碼器(Decoder)堆疊結構。

這樣的技術困境,讓語言模型始終無法真正看見全局,只能在零碎的記憶與有限的上下文中勉強拼湊出語意。直到 2017 年,來自 Google Brain 團隊的一篇論文《Attention is All You Need》,首次提出了 Transformer 架構

- Transformer 的核心不只是一個模型,而是一整套語言理解的方法論。傳統語言模型依賴記憶的累積與傳遞,Transformer 則是透過注意力機制,同步分析每個詞彙與其他詞彙的關聯,讓語言理解不再被線性順序所限制

- Transformer 的成功,來自於捨棄複雜結構,回歸簡單而有效的設計。比起遞歸網路層層堆疊,Transformer 把每層拆解成簡單的注意力與前饋網路組合,這讓模型更容易訓練,也更具擴展性

- Transformer 改變了 AI 模型對位置的看法。傳統模型需要透過結構學習位置資訊,Transformer 則透過位置編碼,讓每個詞彙自帶座標,這不僅保留了語序,也讓模型具備處理更長文本的能力

一些細節:

傳統的語言模型像是接力賽,每個單詞的訊息要一棒一棒往後傳,很容易中途遺漏或失真。而 Transformer 更像是整個團隊圍成一圈,大家同時看著彼此,任何一個位置的資訊都能被直接感知。論文中提出的多頭注意力機制(Multi-Head Attention)進一步突破了單一視角的侷限。就好比一個人同時帶著多副不同功能的眼鏡,有的專看語法結構,有的專看詞意關聯,有的則捕捉長距離依賴,這樣模型就能從多角度、多層次去理解整段文字。

Transformer 架構中的縮放點積注意力(Scaled Dot-Product Attention)設計的查詢(Query)、鍵(Key)、值(Value)三個向量,可以想像成圖書館借書系統:查詢是你想找的主題,鍵是每本書的標籤,值則是書的內容。模型透過計算查詢與所有書的標籤之間的相似度,快速決定該注意哪些資訊,並透過適當的數學縮放,避免計算過程中因數值過大而導致的學習困難。為了補償捨棄遞歸結構後序列順序可能遺失的問題,Transformer 同時引入了位置編碼(Positional Encoding)技術,就像在每個單詞上貼上座標標籤,這樣即便模型不靠遞歸或卷積,也能清楚辨識語序。

AI 生態大洗牌

Transformer 不僅在 NLP 領域橫掃千軍,誕生了像是 BERT(Bidirectional Encoder Representations from Transformers,基於 Transformer 的雙向編碼表示)、GPT(Generative Pre-trained Transformer,生成式預訓練 Transformer)等劃時代模型,更延伸至圖像、音樂、跨模態領域,催生了 Vision Transformer(ViT,視覺 Transformer)、多模態生成模型 Flamingo,以及如今廣泛應用的 GPT-4o 等多模態系統。Transformer 架構,成為新一代 AI 生態系的基礎設計語言。

隨著語言模型規模不斷膨脹,序列長度與運算資源之間的矛盾日益突出。自注意力機制的計算複雜度隨著序列長度呈平方級數(O(n^2))成長,導致處理超長文本時,計算資源與記憶體消耗極為龐大。為了解決這個問題,工程師們提出了 FlashAttention(閃電注意力)、Mixture of Experts(MoE,專家混合機制)、稀疏注意力(Sparse Attention)等一系列優化方案,試圖突破序列長度與計算成本之間的平衡瓶頸。

從捨棄記憶到放大注意力,Transformer 不只是模型設計上的技術突破,更是語言理解邏輯的一次根本重構。它讓 AI 不再像過去那樣,依賴零碎記憶與狹隘視角去猜測語意,而是能夠用全面、即時的觀點,理解人類語言的結構與邏輯。