總結而言,AI Agent 將明顯提升 CPU 的重要性,主因在於其運作模式已由傳統單次問答,轉向多步驟、跨工具、且需持續調度的長時間任務執行;因此,在 Agent 模式下,CPU 需求不僅來自每個 token 背後更複雜的控制流程,也來自單次任務 token 規模的大幅擴張。更值得注意的是,在 OpenClaw 這類產品真正大規模普及之前,全球 server CPU 供給其實就已因 AI data center 建置與雲端需求升溫而處於偏緊狀態。根據路透社,Intel 與 AMD 已於 2 月初向中國客戶提示 server CPU 供應趨緊風險,其中 AMD 部分 CPU 訂單交期已延長至 8 至 10 週,Intel 則警告部分產品最長交期可達 6 個月,且 Xeon 產品價格已上調約 10%;日經亞洲 3 月底則進一步報導,Intel 與 AMD 的 CPU 短缺情況持續惡化,兩家公司已通知客戶,4 月 CPU 價格將再上調 10% 至 15%,部分型號漲幅甚至更高。換言之,市場並不是在充裕供給下等待 AI Agent 帶來新需求,而是在原本就相對緊繃的供需基礎上,迎接下一波新增負載。若未來 OpenClaw 這類 AI Agent 進一步滲透消費市場,CPU 將不再只是 AI 基礎設施中的輔助角色,而可能成為限制 Agent 應用放量速度的下一個關鍵瓶頸。

OpenClaw 一個全能特助的 AI Agent

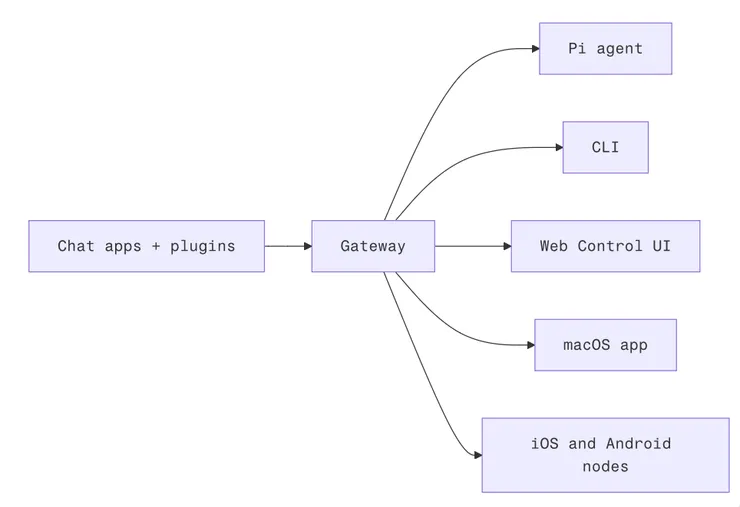

OpenClaw(前身為 Clawdbot 或 Moltbot)是一個開源的 AI 助理平台。它安裝在用戶的本地電腦上,並透過 Telegram 介面進行控制。其核心運作原理是將用戶在 Telegram 傳送的訊息,透過電腦端的 OpenClaw 呼叫雲端的 AI 模型(如 Claude 或 GPT API)進行處理,可以接上 email、雲端文件、上網、寫 code,最後將結果回傳至 Telegram。與傳統以一問一答為主的對話型 AI(如 ChatGPT 或 Claude)不同,OpenClaw 不再僅僅是提供建議或生成內容的被動工具。作為一個開源的 AI Agent 平台,它最大的特色在於具備「主動執行任務」的能力,能根據指令自主規劃步驟,並跨平台調用瀏覽器、Email、行事曆等外部工具來實際操作電腦與網路服務,將 AI 從單純的「回答問題」轉化為能真正替你「動手做事」的數位助理。

OpenClaw 的主要功能

OpenClaw 具備高度的靈活性,除了基本的聊天外,還能執行以下任務:

- 自動化管理:包含整理電子信箱、行事曆排程、產出摘要報告等。

- 資料處理與蒐集:能執行網頁爬蟲、競品分析、新聞監控及社群趨勢追蹤。

- 檔案處理:助理可以讀取 PDF 檔案並進行摘要,或處理各類本地檔案。

- AI Coding 實驗:可用來撰寫簡單的腳本、資料處理工具或進行快速的原型驗證(POC)。

- 可擴充的技能系統(Skills):支援安裝特定的技能插件,例如 Google Gmail、Google Calendar 或檔案管理系統。

- 自訂人設(Persona):用戶可以根據專業背景或溝通偏好,自訂 AI 助理的個性和行為模式。

極低硬體要求與使用門檻

由於 OpenClaw 主要是透過 API 連接雲端模型,因此 AI 運算全在雲端進行,電腦只負責運行一個輕量的背景服務,可以用 Mac mini 或 VPS,完全不需要高階 GPU 或昂貴硬體。

一旦設定完成,使用起來非常簡單。所有的操作都透過 Telegram 介面完成,只要用自然語言傳訊息給機器人即可,例如:「幫我看今天有沒有急件」或「幫我讀取 PDF 檔案並進行摘要」。

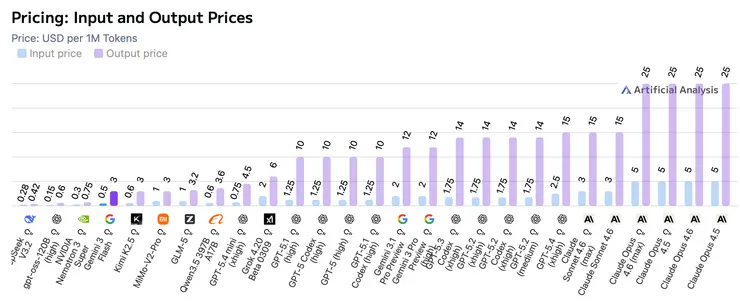

OpenClaw 本身是一個完全開源且免費的專案,使用者不需要支付授權費。且透過 Telegram 進行控制,該通訊軟體也是免費的。使用這類雲端 AI 代理服務最主要的持續性成本是 API 費用,費用將取決於使用頻率,根據使用頻率與任務複雜度,使用 Claude Sonnet 模型的費用估計約為每日 USD $10–20。如果重視隱私或想節省開支,可以搭配 Ollama 在本地執行開源模型,這部分的 API 費用為零。

CLI 如何設定本地端

在 OpenClaw 的架構中,一個 Agent 通常是與一組特定的設定(包含 Provider 和 Token)綁定的。如果想同時擁有「地端版」和「雲端版」的功能,最標準的做法是建立兩個不同的 Agent,並分別指定不同的 Provider。

如果想用地端模型,可以使用預設模式,也就在安裝後不做任何額外設定,OpenClaw 會自動使用內建的 Pi 執行檔(bundled Pi binary),也可以自定義本地 Provider,常見的本地模型包含 Qwen、GLM;若想用雲端,就填入你申請的 API Key(如 OpenAI、Anthropic、Google Gemini 等)。

使用地端模型的限制:免費的東西往往最貴

地端模型雖然在隱私控管與 API 成本上有優勢,但在現階段的技術下,其工具操作的精準度、處理複雜任務的穩定性是主要的缺點。雖然節省了雲端 API 費用,但使用者需花費大量時間進行除錯、環境建置以及繞過各種限制,有著高昂的隱藏成本。

根據開發者的實際測試經驗,使用地端模型(如透過 Ollama 執行的開源模型)搭配 OpenClaw 框架時,主要存在以下缺點:

- 能力與回覆品質不足:許多地端模型(如 Qwen 80B、GLM 4.7 等)雖然號稱支援工具呼叫(Function Calling),但在處理多步驟任務時準確率不高,常發生不知道何時該呼叫工具,或呼叫方式錯誤的情況,其 Function Calling 能力不成熟。相比雲端模型(如 GPT-4o),地端模型在理解複雜指令與生成品質上表現較差。

- 無法協調子代理(Sub-agent):處理複雜任務時,地端模型難以有效管理 OpenClaw 的子代理分工,為了減少錯誤,使用者往往必須強制模型使用單一 agent 處理任務,這會導致其處理複雜任務的能力進一步下降。

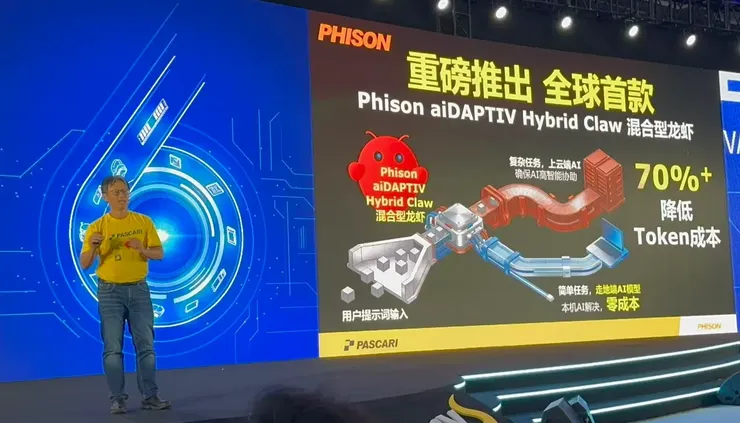

群聯推出 aiDAPTIV Hybrid Claw

為了讓一般 PC 也能運行原本需要大量昂貴 GPU 及 HBM 的大型模型,群聯透過 aiDAPTIV+ 方案,將 SSD 部分空間劃分為 AI Cache,突破傳統記憶體容量限制。這使得原本需要約 96GB DRAM 才能執行的 120B 大模型,能壓縮至僅需 16GB 或 32GB 記憶體,即可在一般 PC 上順暢運行。

在此架構下,aiDAPTIV+ 可以讓地端模型稍微變聰明,120B 等級的地端模型在理解力和邏輯上,會比小參數模型有顯著提升,能處理更多中等難度的任務,減少對雲端的依賴。

進一步搭配地端與雲端的協同運算架構,系統會先判斷任務屬性進行分流。對於簡單或高隱私需求的任務(如查詢天氣、日程安排或處理個人檔案),由地端模型直接處理,不僅零 token 成本,也能確保資料不外流;而對於高複雜度或高邏輯需求的任務(如程式撰寫或多工具調用),則僅將這部分任務上傳至雲端模型(如 GPT-4o)處理,以確保結果品質。

整體而言,透過 aiDAPTIV+,系統能以地端較大模型處理約 70% 的日常任務,剩下的 30% 難題再交給雲端大腦。這樣既解決了隱私與成本問題,也讓地端模型不會因為太笨而無法使用。

OpenClaw 的出現,代表入口正在發生重大轉變

所謂「入口」,就是使用者打開電腦或手機後,第一個且最常接觸的介面。過去的入口是 Windows 桌面與 Google 瀏覽器;而未來的入口,很可能會變成一個全能的 AI Agent。使用者不再需要逐一打開不同的 App,只需對 Agent 下達指令,Agent 就會透過 API 去操控背後所有的軟體,替你完成各種操作。

目前已有許多科技公司開始布局這個新入口。多家中國科技公司正積極推出手機版的 OpenClaw 類應用,例如阿里雲推出 JVS Claw,百度則推出紅手指 Operator 等產品,試圖將 AI Agent 直接嵌入行動裝置與日常數位工作流程之中。

在 AI Agent 時代下 CPU 重要性會提升

OpenClaw 所代表的 AI Agent 模式正開始受到產業高度關注。若這類全能 AI Agent 真正普及,未來人們使用電腦與手機的方式可能會出現根本性的改變。一旦 AI Agent 成為新的數位入口,其背後所需要的算力需求也將大幅提升。每一次任務規劃、工具調用、資料搜尋與模型推理,都代表新的運算負載。從 Chatbot 走向 AI Agent 的過程,將不只是軟體形態的變化,也意味著算力架構的重要轉變。

為什麼 CPU 重要性會提升?

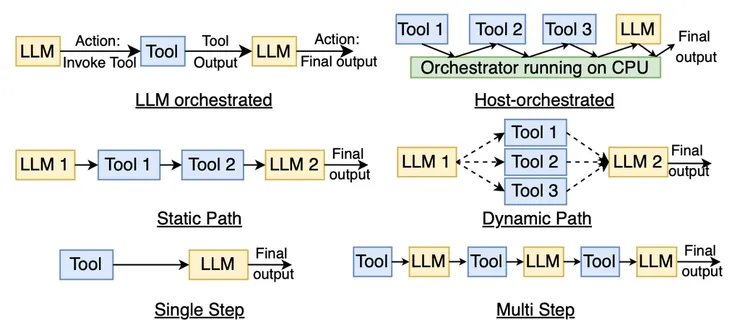

根據 Raj 等人(2025)的研究,觀察以下 AI 的工作流程圖可以發現依據三個面向對 Agentic AI 工作負載進行特性分析。

左方代表的是被動生成文字的 AI,就像早期的 ChatGPT。在這個模式下,AI 工作流程主要是由工程師寫好的程式碼來指揮,這也就是所謂的由 Host 控制。它做事的路線遵循固定的步驟,例如接受問題、搜尋資料,然後總結答案。而且這種任務通常做一次就結束了,屬於單步操作。因為任務相對單純,系統的壓力幾乎完全集中在模型努力生成字詞的那個瞬間,所以這種舊模式極度依賴 GPU 的算力。

而上圖右邊代表的則是新世代的 Agent,這是一種能夠主動、自主解決問題的模式。在這個新模式下,是由 AI 的大語言模型自己擔任指揮官。它會根據接收到的任務和執行過程中遇到的狀況,隨機應變地決定何時該呼叫外部工具。它的路線是動態且靈活的,如果發現某個工具查不到資料,它會臨時改變策略換另一條路走。更重要的是,這是一個會一直繞圈圈直到問題解決的多步過程,AI 必須連續呼叫多個工具,不斷推理並組合中間結果。

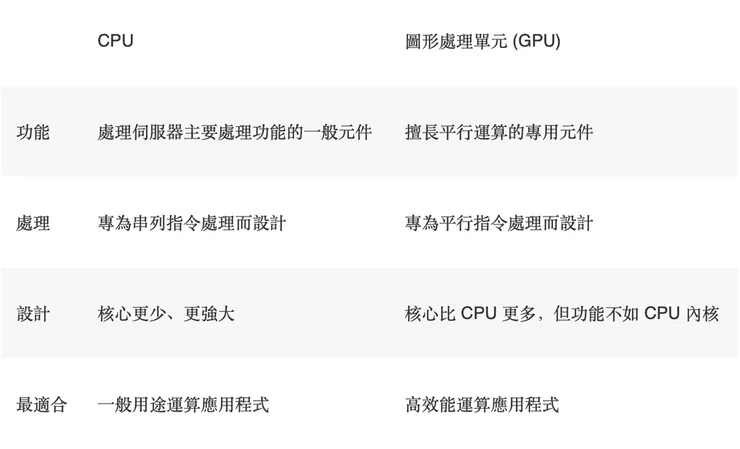

當 AI 進化到右邊這種複雜的程度時,它必須花費極大量的時間在呼叫工具、搜尋網頁、查詢資料庫以及切換工作環境上。這些控制、排程與協調的打雜工作,正是 CPU 最擅長的事情。因此,系統的壓力重心從 GPU 轉移到了 CPU 身上。具體而言,在 AI Agent 的時代下,CPU 重要性會提升可歸納於兩個原因:

一、AI Agent 的決策編排與跨系統協作,推升 CPU 重要性

傳統 Chatbot 主要是「你問一句,模型回一句」,系統負載集中在模型推理本身,屬於典型的算力密集型任務。在這類場景下,CPU 的角色多半是負責資料傳遞與系統協調,再將主要運算交由 TPU 或 GPU 處理,因此標準配置通常約為 1 個 CPU 搭配 2 個 TPU(1:2)。

但隨著 AI 發展從 Chatbot 進一步走向 AI Agent,算力需求的結構也開始改變。AI Agent 的核心特徵,在於其具備一套 Agentic flow,也就是不再只是單純回一段話,而是會進一步拆解任務、規劃步驟、調用工具、讀寫外部資料、執行程式,並根據中間結果持續推進下一步。這類工作涉及大量一步接一步的判斷、控制與執行,並不只是單純的 TPU 或 GPU 運算,而是高度依賴 CPU 進行任務調度、工具協作與系統控制。

因此,AI Agent 會明顯提高 CPU 負載,使 CPU 與 TPU 的配置需求由傳統的 1:2 進一步提高至 1.3:2;換言之,在相同 TPU 規模下,AI Agent 對 CPU 的需求約比傳統 AI 工作負載高出 30%。

每個 token 需要更多 CPU

白話來說,就是現在 AI 在處理同樣一段文字時,背後不再是 chatbot 時代只是單純地計算下一個 token 應該輸出什麼,而是同時伴隨更多任務控制與執行流程,這些都是 CPU 的工作。

過去傳統 chatbot 的模式相對單純,主要壓力集中在模型推理本身,CPU 多半只負責接收請求、搬運資料與協調系統,再把大量運算交給 GPU 或 TPU 處理,因此每個 token 對 CPU 的消耗相對有限。但在 AI Agent 場景中,Agent 不只是回答問題,而是需要進一步理解任務、拆解步驟、Python 執行、網頁搜尋、文件摘要(LexRank)與資料庫檢索(ENNS)等。這種一步接一步的 Agentic flow 都是高度依賴 CPU 的工作。

因此,所謂「每個 token 需要更多 CPU」是指每產生一段內容、每推進一個步驟,背後所需的控制流程比以前更多,使得平均分攤到每個 token 上的 CPU 成本提高了。

二、AI Agent 屬於一種長時間持續運行的工作負載

AI Agent 之所以消耗 CPU,關鍵在於它不是像傳統 Chatbot 那樣完成幾次問答就結束,而是屬於一種長時間持續運行的工作負載。當 Agent 接到任務後,往往需要在數十分鐘甚至數小時內持續維持主循環運作,負責追蹤任務進度、保存與更新狀態,並不斷調度下一步要執行的工具與流程。這些工作本質上都屬於 CPU 最擅長的控制、協調與排程任務,因此即使模型推理本身未必在本地進行,Agent 仍會因長時間的主循環、狀態維護與任務調度,而明顯提高 CPU 的負載。

上下文處理需求(Context Window)的擴大

過去的 AI 處理任務比較短暫,單次處理的 token 大約在 50K 到 150K 之間。但未來的 Agent 會在背景連續工作數小時,處理大量跨軟體的資訊,預計單次上下文會暴增到 300K 到 600K。GPU 只負責做純粹的數學運算,但把這 600K 的龐大資料從硬碟撈出來、進行格式轉換、Tokenization,並安排順序餵給 TPU 的工作,全部都是 CPU 在做。資料量大 10 倍,CPU 的搬運與處理工作就多 10 倍。

具體來說,在傳統 LLM 問答場景中,一次 request 的輸入、輸出與思考過程,加總平均約為 2,400 到 2,500 token;而在 Agent 模式下,背後往往不只一次模型推理,而是多層次的任務執行,估算簡單任務下的 token 消耗量如下:包含基礎模型互動約 2,400 token、agent 調度與任務執行約 6,000~8,000、資料庫推理約 12,000,以上加總大概接近 2 萬 token,約為傳統 LLM 的 10 倍;而中等任務約為傳統 LLM 的 15 倍;複雜任務約為傳統 LLM 的 30 倍。

總結而言,AI Agent 將明顯提升 CPU 的重要性,主因在於其運作模式已由傳統單次問答,轉向多步驟、跨工具、且需持續調度的長時間任務執行;因此,在 Agent 模式下,CPU 需求不僅來自每個 token 背後更複雜的控制流程,也來自單次任務 token 規模的大幅擴張。

AI Agent 時代下 CPU 正成為新瓶頸

根據 Raj 等人(2025)的研究,Agentic AI 時代可能重塑 CPU 與 GPU 的分工架構,並凸顯 CPU 重要性的回升;其中,論文提出三項核心發現作為主要依據。

- CPU 主導了延遲:研究顯示,Agent 執行任務的大部分時間其實是花在 CPU 的運算上。在 RAG 工作負載中,文件檢索(Retrieval)佔了運作時間的 84.5% 至 90.6%,而 GPU 負責的 LLM 推理時間僅不到 0.5 秒。在 SWE-Agent 任務中,Bash/Python 的執行時間佔了總延遲的 43.8% 至 78.7%。過去我們認為 AI 的瓶頸在 GPU 推理,但在 Agentic AI 框架下,GPU 負責的思考可能不到 0.5 秒就結束了,而 CPU 負責的執行工具卻要花 6 到 8 秒。這意味著優化重點應從 GPU 轉向 CPU-CPU 的協同優化。

- 系統吞吐量(Throughput)遇到「雙重天花板」:研究發現當系統同時處理大量 Agent 請求時,效能會被 GPU 的記憶體頻寬或 CPU 的多核心調度能力卡住。

- GPU 瓶頸:當請求太多,暫存對話紀錄的 KV cache 會塞滿 GPU 記憶體,迫使資料傳回慢速的系統記憶體(PCIe),導致速度暴跌。

- CPU 瓶頸:即使 GPU 沒滿,CPU 在同時處理多個任務時,會因為核心過度訂閱(任務數超過核心數)、核心之間的通訊延遲(一致性流量)以及頻繁的上下文切換,導致處理能力提早達到飽和。

- CPU 能耗佔比在大量任務下飆升:對於 LangChain 等代理型負載,研究發現當 AI Agent 進行大規模並行處理 Batch Size 為 128 的任務時(指併發處理 128 個 AI Agent 的請求或任務),CPU 的動態能耗比例會從 20% 飆升到 44%。研究發現 GPU 在並行處理上非常省電,但 CPU 多進程處理的能源效率相對較低。當任務變重,CPU 為了處理這些複雜的工具操作,會消耗將近一半的系統電力。

總結來說,在 AI Agent 時代,系統不再只是生成文本,而是「思考、調用工具並執行任務」。由於編排邏輯與外部工具(Python、搜尋、數據庫檢索)都高度依賴 CPU,CPU 已經從傳統的輔助角色,變成了決定代理型 AI 性能、效率與擴展性的核心關鍵。

AI Agent 具體會用到多少 CPU?

評估 CPU 需求時,不能只看 token 成長了幾倍,在 Agent 時代,CPU 需求並不是單純隨 token 數成正比增加。相較之下,GPU 需求通常較容易與 token 數量連結,因為 token 越多,代表模型推理量越大;但 CPU 的角色不只是負責推理本身,還涵蓋 agent 調度、沙箱環境、工具呼叫與流程控制等工作。因此,CPU 需求更與同時在線的使用人數以及每位使用者所執行任務的複雜度高度相關。

通常會以以下方式反推 CPU 需求:

同時在線使用人數 × 單一用戶平均同時併發的 agent 數 × 每核心可承載任務數(取決於任務複雜度)。

再進一步評估現有伺服器是否仍有可用餘量;若現有資源不足,才需要新增高核心數 CPU 伺服器。

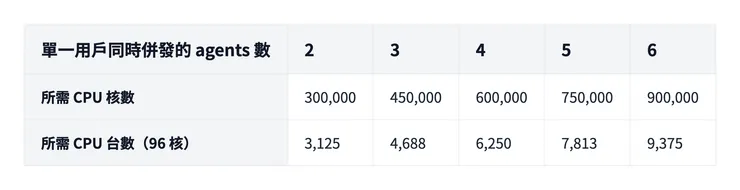

以下試算不同情境下的 CPU 需求:假設有 1,000 萬在線使用人數,其中大約 30% 會同時和 AI 互動,也就是 300 萬人。再假設每個人發一個請求,平均會同時調用 2-6 個 agent,那總共就是 600 - 1,800 萬個 agent 任務。接著再看 CPU 的承載能力,如果是中等複雜度任務,一個 CPU 核大概可同時處理 20 個 agent。那麼需要的 CPU 核數就 30 - 90 萬核,如果一台伺服器 CPU 是 96 核,那麼需要的 CPU 顆數大概就是 3,125 - 9,375 顆,平均約 6,000 個 CPU。

以下試算不同單一用戶平均同時併發的 agent 數下的 CPU 需求(以中等任務計算):

註:CPU 需求對單一用戶同時併發的 agent 數高度敏感;併發數越高,所需 CPU 核數與伺服器台數越高。

CPU 產能

若 OpenClaw 這類雲端 AI Agent 快速普及,新增算力需求不會只反映在 GPU,也會同步推升 CPU 的需求。原因在於,Agent 工作負載除了模型推理本身,還包括任務調度、工具呼叫、上下文管理、狀態維護與流程控制,而這些環節都高度依賴 CPU。也因此,當 AI 應用由傳統 chatbot 走向長時間、多步驟、跨工具的 Agent 模式後,CPU 將不再只是配角,而會成為限制資料中心擴張速度的關鍵資源之一。

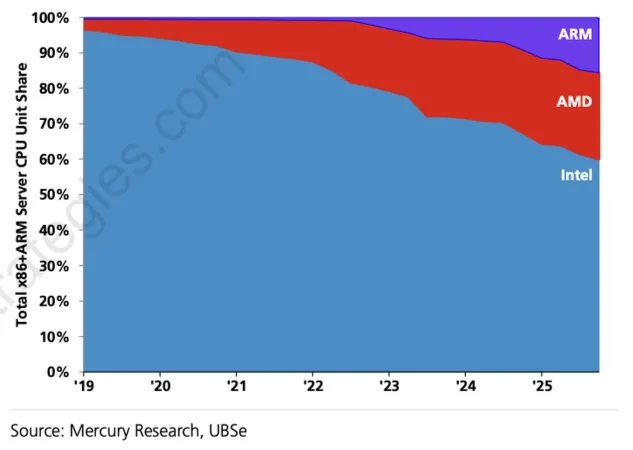

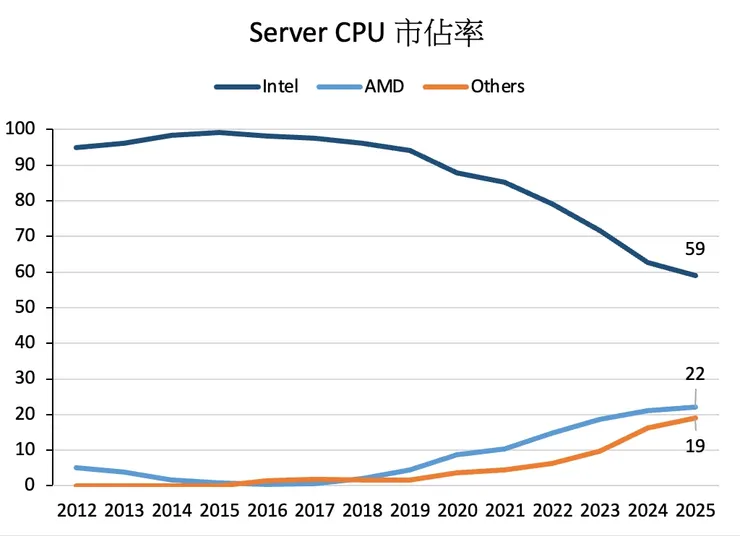

從供給面來看,CPU 市場已不再是 Intel 一家主導的局面,而是進入 Intel、AMD、Arm 三方競爭的結構。Intel 目前仍是最大供應商,但市占已降到約六成左右;AMD 出貨量市占率約 25%,成為最主要的 x86 競爭者;Arm 也逐步擴大到一成以上,代表 hyperscaler 自研與非 x86 架構的滲透正在加快。

Intel、AMD 與 Arm 伺服器 CPU 市占率(以出貨量計)。資料來源:Mercury research、UBSe

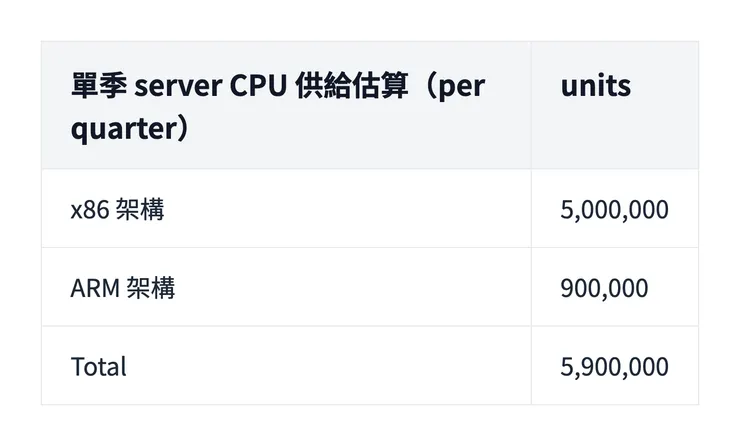

若以單季供給能力估算,目前 x86 架構 server CPU 產能約為 500 萬顆,Arm 架構約為 90 萬顆,合計約 590 萬顆。不過,短期供給是否足以承接新增 Agent 工作負載,仍取決於主要供應商的產能爬升速度、製程良率。

Intel

就 Intel 而言,公司在 2025 年 10 月 FY3Q25 電話會議上指出,採用 Intel 10/Intel 7 節點的舊世代 PC CPU 需求高於原先預期;在 Intel 10/7 節點產能受限、且短期內並無明確擴產規劃的情況下,公司預告自 2026 年初起,DCAI 部門將面臨 CPU 供應吃緊的壓力。

到了 FY4Q25 電話會議,管理層進一步坦言 AI data center boom 帶動 hyperscaler 對 Xeon 的需求大幅超出原先預期,server CPU 需求成長速度遠超原先預期,尤其 hyperscaler 客戶原先預期僅是 core count 提升,實際上卻連整體出貨 units 也同步大增,使供應壓力較原先預估時點更早惡化。

儘管 Intel 已優先將更多內部產能配置至資料中心業務,但 1Q26 仍將是全年供應最吃緊時點,預期 DCAI 營收將呈現季減,後續則有望透過良率改善、設備投資與 Intel 7/Intel 3/Intel 18A wafer starts 提升而逐季修復。

Intel 財務長 Dave Zinsner 在 Morgan Stanley Technology, Media & Telecom Conference 上指出,2025 年 CPU 市場總量(TAM)年增率達 20% 以上,他預期 2026 年將持續展現強勁成長。由於需求旺盛,已有客戶開始要求簽署 3~5 年的長期協議(LTA),以確保供應穩定。

Intel server CPU roadmap

Intel 主要製造據點與節點分布

AMD

相較之下,AMD 的供給狀況相對樂觀。公司在 2026 年 2 月的 FY4Q25 電話會議中表示,過去幾季已觀察到伺服器 CPU 需求持續升溫,因此提前擴充了 server CPU 的供應能力,並預期資料中心業務在傳統淡季仍可維持季增,其中 server CPU 與 GPU 均將成長。

蘇姿丰日前也在 Morgan Stanley Technology, Media & Telecom Conference 上指出,隨著 Agentic AI 應用快速升溫,資料中心 AI 工作負載中的 CPU 與 GPU 配置比例,近幾個月已出現明顯變化。她也提到,部分大型客戶過去低估了 AI 部署對 CPU 的需求,近期隨著訂單承諾快速增加,供應鏈短期內已難以即時擴充產能。不過,AMD 正與供應鏈夥伴協同提升供給能力,並預期未來一年產能狀況將逐步改善。

AMD server CPU roadmap

在 OpenClaw 尚未真正普及之前,全球 server CPU 供給其實已因 AI data center 建置、雲端需求升溫而處於偏緊狀態。代表當前市場並不是在充裕供給下等待新需求出現,而是在原本就相對緊繃的供需基礎上,迎接下一波 AI Agent 帶來的新增負載。

根據路透社,Intel 與 AMD 已於 2 月初向中國客戶提示伺服器 CPU 供應趨緊風險,其中,AMD 部分 CPU 訂單交期已延長至 8 至 10 週;Intel 則警告,延遲時間可能更長,最久可達 6 個月,且 Xeon 晶片已漲價約 10%。日經亞洲 3 月底更近一步報導,Intel 與 AMD 均出現 CPU 短缺,兩家公司已通知客戶,四月份 CPU 價格將上調 10 至 15%,部分型號的漲幅甚至更高,CPU 短缺的情況正在惡化。

若 OpenClaw 這類象徵 AI Agent 正式走入大眾使用場景的產品,後續能進一步滲透消費市場,則其帶動的算力需求將不僅限於 GPU,亦會同步推升 server CPU 在任務調度、工具調用、上下文管理與流程控制上的負載,進一步放大 CPU 在 AI 基礎設施中的戰略重要性。換言之,CPU 短缺問題可能不是 Agent 普及之後才開始出現,而是在 Agent 真正放量之前,就已經埋下伏筆。

Arm 架構會取代 x86 嗎?

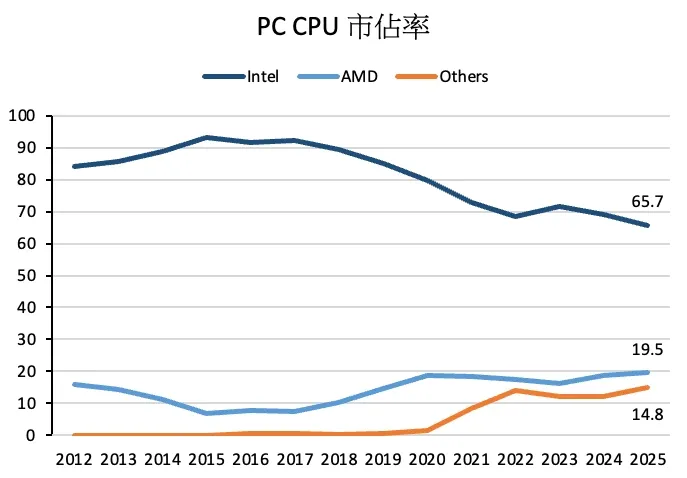

Arm 架構近年在 PC 市場快速崛起,其最大的賣點在於低功耗與長續航能力。過去主要推動 Arm PC 發展的廠商為 Apple 與 Qualcomm,其中以 Apple 的貢獻最為關鍵。根據 IDC 統計,2025 年 Arm 架構 PC 市占率約為 14.8%,且大多數來自 Apple 的 Mac 產品。

PC CPU 市占率。資料來源:IDC

為什麼當年 Apple 要從 x86 換到 Arm?

Apple 當年從 x86 轉向 Arm,表面原因是 Intel 製程不順、CPU 效能與功耗表現不如預期,自研晶片不僅能解決效能問題,也擺脫對 Intel 的採購依賴。但更關鍵的,是 Apple 想掌握晶片設計主導權,並推動整體生態系的統一:將 iOS、iPadOS 與 macOS 整合成一個跨平台架構,讓 App Store 上的應用能直接延伸到 Mac。開發者面對更廣大的客群,就更願意為 Apple 開發更多 app,Apple 也能從中賺取可觀的平台費。

此外,Apple 透過 Rosetta 2 轉譯技術,在過渡期間解決 x86 軟體相容問題,使使用者幾乎無痛轉換。再加上 M1 晶片本身優異的效能與能效,即使透過轉譯執行,仍能維持接近原生的體驗,最終成功完成架構轉型。

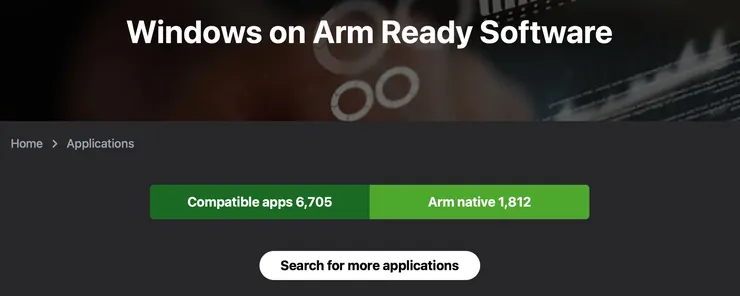

Windows on Arm 為何失敗?

相較之下,Microsoft 與 Qualcomm 推動的 Windows on Arm 未能成功,核心問題在於「軟體相容性」與「生態誘因不足」。

第一、軟體兼容性

Microsoft 沒有像 Apple 那樣強制平台轉型。Apple 是直接把 Mac 也切到 Arm,讓 iPhone、iPad、Mac 形成統一架構,強行推出一個能兼容 iOS App Store 的環境,讓 iOS App 擴展到桌面,因此存在對開發者的誘因;而 Microsoft 是同時維持 x86 與 Arm 兩套架構,對開發者來說,WoA 的使用者不多,更沒有投入的誘因,開發者自然優先投入用戶更多的 x86 平台。對消費者而言,當然不會想購買不能安裝多數軟體的硬體。2017 年 Microsoft 甚至只支援 32 位元 x86 軟體轉譯,直到很久以後的 Windows 11 才補齊 64 位元 x64 的轉譯能力,進一步拖慢生態發展。

第二、生態系開放與否

Apple 的成功,某種程度來自其封閉生態系,涉及的利害關係人較少,且具備軟硬體整合能力,能夠快速推動重大轉型。而 Microsoft Windows 長年是全球最主流的桌面平台,背後有龐大的舊世代軟體、OEM 筆電廠、晶片商與通路體系,這種開放生態雖然能快速擴大規模,但在轉型時需要協調多方利益,使變革極為困難。

Qualcomm 的突破與限制

蘋果的 M1 之所以成功,主要依靠頂尖的晶片和架構設計,一般的原始性能和能效都很強,這樣即使套上轉譯層,也比 x86 強很多。且安裝時預先轉譯的 Rosetta 2 轉譯器允許 Apple Silicon Mac 執行 Intel x86_64 的舊軟體,強大的轉譯器使應用程式運行速度接近原生。

Qualcomm 想讓 Windows on Arm 成功,就必須做出一個遠超 x86 原始性能的 CPU,這樣轉譯後至少還有競爭力。在這個背景下,Qualcomm 2023 年底發表了 Snapdragon X Elite,是自研 Oryon 架構的第一代產品,也是 Qualcomm 收購當年設計蘋果 M 系列的 Nuvia 團隊後的首款 CPU,發布當時對標蘋果的 M2,在原生 Arm 的性能上超乎市場預期。但軟體生態系及轉譯後的性能還是很大的問題,且拖到 2024 年中實際推出後,市場當時對 Snapdragon X Elite 的需求已未如預期,主要就是受到高定價和軟體兼容性問題影響。

軟體兼容性是唯一的瓶頸

Qualcomm 其實已經成功打造出一顆在原生 Arm 架構下性能表現優異的 CPU。然而,若軟體相容性問題無法有效解決,Arm PC 仍然難以真正被主流消費市場接受。

為了解決這個關鍵瓶頸,Microsoft 在 2024 年下半年於 Windows 11 中導入全新一代即時轉譯器「Prism」,用來動態轉譯 x86/x64 指令,試圖改善 Windows on Arm 的應用相容性問題。進一步在 2025 年底,Microsoft 為 Prism 推出重要更新,正式支援 AVX、AVX2、BMI、FMA 等高階 CPU 指令集,大幅擴展可執行的應用範圍,並在一定程度上緩解了過去許多專業軟體無法運行的問題。

然而,轉譯技術本質上仍是一種權宜之計。在執行過程中,不可避免會帶來額外的效能損耗與功耗提升,難以達到原生運行的最佳效率。因此,從長期來看,軟體生態轉向原生 Arm 架構,才是根本解法。也正因如此,近年來越來越多應用程式開始推出原生 Arm 版本,包括瀏覽器、開發工具以及部分專業軟體。隨著生態逐步完善,Arm PC 的競爭力才有機會真正釋放。

x86 的反擊:功耗優勢不再專屬 Arm

另一方面,Intel 與 AMD 也持續強化 x86 架構的能效表現。從當時 Lunar Lake 發表時展示了 x86 處理器在低功耗領域的潛力來看,市場當時普遍認為 Arm 架構是低功耗的關鍵,但 Lunar Lake 證明 x86 架構同樣能達到 MacBook 級別的續航,顛覆了過去的認知,這也意味著,續航差距更多來自製程與架構設計,而非指令集本身。

Intel 在 CES 2026 發表了 Panther Lake 處理器,為首款採用 Intel 18A 工藝的產品,首次引入 GAA 晶體管工藝與 PowerVia 背面供電技術。CPU 部分,Intel 18A 工藝比採用台積電 N3B 工藝更上一層樓,GPU 方面的遊戲及能效表現也非常優秀。對企業用戶而言,若 x86 已能提供相似功耗表現,加上既有軟體相容優勢,轉向 Arm 的誘因將大幅降低。

未來展望:更多巨頭加入,Arm 生態有望加速成熟,x86 與 Arm PC 並存

Arm PC 不再只有 Microsoft 與 Qualcomm 單打獨鬥。目前 Windows on Arm 生態系有可能迎來一波爆發期,因為其他晶片巨頭也正大舉進軍這個市場:

- Nvidia 正與聯發科共同開發進軍 PC 領域的 Arm 架構處理器,分別 N1X 及 N1,預計採用台積電的 3nm 製程,挾帶強大的 GPU 技術切入市場,該主機板配備 128GB LPDDR5X 記憶體與 8+6+2 相供電設計,顯示 N1 的功耗應該不低,且更針對高性能專業場景使用,而非低功耗文書處理。

一份洩漏運輸清單顯示 Dell XPS 筆電已搭載 N1 工程樣品。資料來源:X Olrak29_

- AMD 將跨入 Arm-Based 領域開發處理器。

值得注意的是,NVIDIA 的 PC 佈局不是只有 Arm 筆電 SoC。去年 9 月 Nvidia 入股 Intel,也表示將與 Intel 正在進行一項合作計畫,將開發整合 NVIDIA RTX GPU 小晶片的 x86 系統 SoC。

顯示不管是 Microsoft、Nvidia 還是 AMD,本質上都希望同時掌握 Arm 與 x86 兩大平台的機會,盡可能在不同生態系中分一杯羹。

結論(PC 市場)

Arm 架構一直以來難以取代 x86,主要原因在於既有軟體生態與企業使用習慣的高度黏著性。未來更可能的發展,是隨著 Arm 生態系逐步完善,以及 x86 架構透過先進製程與架構優化縮小功耗差距,過去以指令集(RISC vs. CISC)作為性能與功耗差異的核心來源,正逐漸失去其決定性影響力。現代處理器的實際表現,更多取決於製程技術(process node)與微架構設計(microarchitecture),而非指令集本身。換言之,無論是 Arm 還是 x86,其競爭力是取決於誰能在晶片設計、功耗管理、以及軟硬體生態系整合上做得更好。

Arm Holdings 與資料中心 CPU 市場

以 Intel 與 AMD 為代表的 x86 架構長期主導 CPU 市場,近年來也開始出現變化,強調性價比與可客製化的 Arm 架構逐漸嶄露頭角。從 AWS 自研的 Graviton,到各大雲端與晶片廠積極投入,Arm 在資料中心的滲透率正穩步提升。雖然目前整體市佔仍不及 x86 陣營,但其成長速度使其逐漸成為不可忽視的第三勢力。

Server CPU 市占率。資料來源:IDC

Arm 宣布推出首款直接銷售給客戶的矽晶片:Arm AGI CPU

Arm 進軍晶片市場的理由為 Agentic AI 帶動 CPU 需求爆發,由於 Agentic AI,AI 資料中心對 CPU 的需求增加了四倍,從每 GW 3,000 萬核心增至 1.2 億核心。啟動合作夥伴包括 Meta、Cerebras、Cloudflare、F5、OpenAI、Positron、Rebellions、SAP 及 SK Telecom。

Arm Everywhere event 發表 Arm AGI CPU。資料來源:Arm

Arm AGI CPU 效能

Arm AGI CPU 配備 136 顆 Neoverse v3 核心,每顆核心擁有專屬 2MB L2 快取,支援最高 3.7GHz,具備 96 條 PCIe Gen 6 與 CXL 3 通道,並提供每核心高達 6GB/s 的記憶體頻寬。此晶片採用台積電 3 奈米製程,熱設計功耗(TDP)為 300W,記憶體延遲低於 100 奈秒。

Arm 宣稱 AGI CPU 在每瓦效能(performance per watt)上約為 x86 同級產品的兩倍,能在相同 36kW 機架功率下實現雙倍效能,並有望在每 GW 數據中心容量節省高達 100 億美元的資本支出。管理層認為,這些優勢來自於其「專為 AI 設計」的架構,避免了 x86 的歷史包袱與額外負擔。Arm 雲端 AI 執行副總裁 Mohamed Awad 甚至直言,Arm 不需如 x86 為了相容 Lotus Notes 等舊軟體而保留負擔,而是專注效能與效率。

軟體兼容性(資料中心)

AWS 早期透過大幅折扣來誘使客戶將程式移植到 Arm 生態系,相較於進展緩慢的一般企業市場,雲端業者已經能快速調整其內部工作負載以適應自研 Arm 晶片。軟體兼容性在早期是主要阻礙,但隨著雲端服務商的強力推動,目前在超大規模資料中心環境中已不再是核心問題。

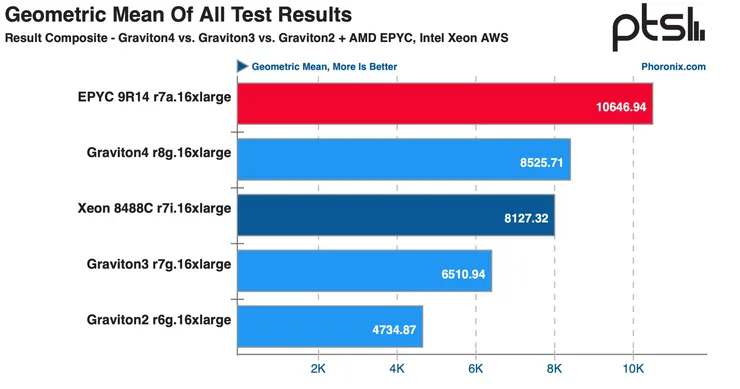

但實際上目前 AMD 整體性能仍領先

根據 Phoronix 實際評比 AMD 第 4 代 EPYC(Genoa 架構)、Intel 第 4 代 Xeon(Sapphire Rapids)及基於 Arm 架構的 AWS Graviton 2、3、4,結果顯示在整體綜合性能(約數百個測試平均)下,AMD 目前整體性能仍領先。

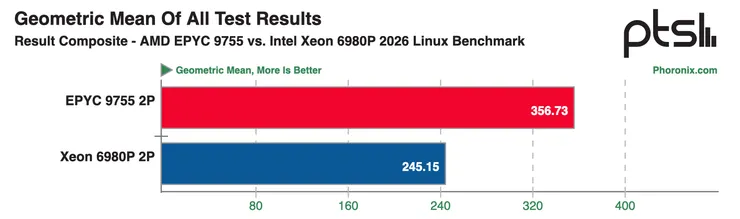

Phoronix 進一步比較 AMD 第 5 代 EPYC 及 Intel 第 6 代 Xeon(Granite Rapids 架構),AMD EPYC 9755 2P 的性能達到 Intel Xeon 6980P 2P 的 1.45 倍。在兩者皆為每顆處理器 128 核心/256 執行緒的情況下,第五代 AMD EPYC 持續展現出明顯的性能領先優勢。

x86 與 Arm 架構的優劣

資料中心 CPU 規格與架構比較。資料來源:自行整理

Arm 架構:性價比與可客製化程度高

- 優勢:

- 具備極佳的性價比(Performance per Dollar)電力效率,適合雲端原生(Cloud-Native)的高吞吐量任務。

- 可客製化程度高,Arm 的授權模式讓 AWS、Google、Microsoft、NVIDIA、甚至 Arm 自己都能針對需求設計 SoC、chiplet、記憶體/IO 佈局。

- Hyperscalers 可以透過自研晶片(如 Graviton)省去購買 Intel Xeon 的昂貴成本並提高毛利。

- 劣勢:

- 單核效能不及 x86,且標準化的 Neoverse 核心可能存在分支預測瓶頸,這也是為什麼 Nvidia 決定在 Vera CPU 中捨棄標準 Arm Neoverse IP,轉而採用自研 Olympus 核心的核心原因,並引入 SMT(同步多執行緒),使 Vera CPU 能夠以 88 核心達成 176 執行緒。

x86 架構:極致效能與成熟生態

- 優勢:

- 高單核性能,AMD 長期採用 SMT,SemiAnalysis 預測 AMD 的 Venice 在 2026 年將在每核性能上持續領先。Intel 未來預計在 2028/2029 年的 Coral Rapids 重新採用 SMT。

- 軟體生態成熟。

- 劣勢:

- Intel 面臨先進封裝(Foveros)良率問題與研發延遲。

- 對 Hyperscalers 來說,成本不一定最佳。

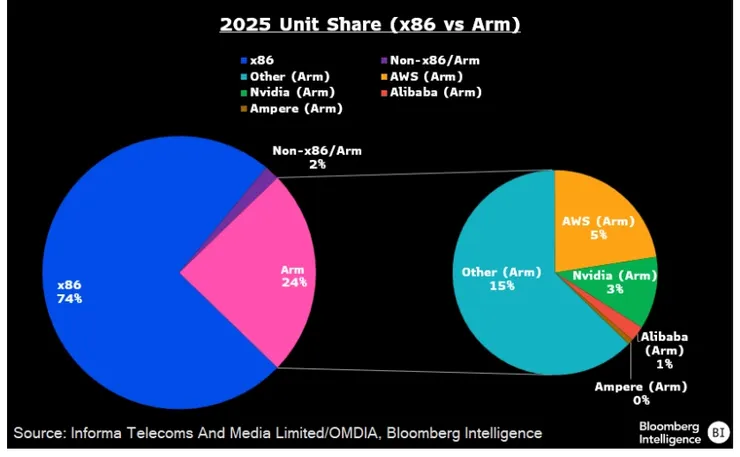

x86 仍占主導,但 Arm 在 AI 伺服器滲透率正在上升

x86 架構仍主導伺服器 CPU 市場,市佔約 75-80%。隨著 Agentic AI 推論提升調度與 head-node 需求,進一步支撐了資料中心需求與短期展望,特別是 AMD 表現更為強勁,而 Intel 仍處於復甦初期,並持續改善執行能力。同時,Arm 的競爭正在加速,包括 Nvidia 的 Grace CPU 和 Vera CPU,還有 AWS 等 Hyperscalers 的自研晶片以及 Arm 的 AGI CPU 進入市場,Arm 架構的市佔預計將從目前約 20-25% 持續提升。

資料來源:Omdia、Bloomberg

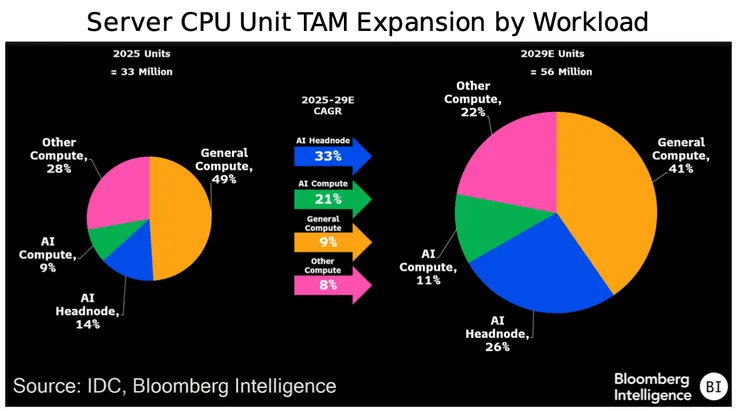

CPU 的市場再擴大,x86 跟 Arm 都在成長

Amazon Web Services 與 Microsoft 正在大規模建設其自有的 Graviton 與 Cobalt CPU,同時也購買更多 x86 伺服器,以應對這種呈倍數成長的網路流量。整體 CPU TAM 將擴大至接近 1,000 億美元。

資料來源:IDC、Bloomberg

Arm 比較像「高效率、好客製、適合大規模雲端與特定用途」;x86 比較像「相容性最好、單核強、企業/HPC 傳統軟體最穩」。

SMT 補充說明

Spectre 與 Meltdown 安全問題是什麼?

這是在 2018 年發現的硬體漏洞,主要與 CPU 的 分支預測(Branch Prediction) 功能有關:

- 運作原理:後果:為了提升性能,CPU 會預先猜測並執行指令。攻擊者可以利用這一機制,在同一個物理核心上的兩個邏輯執行緒運行時,窺探並拼湊出另一個執行緒的數據。

- 後果:雲端供應商當時被迫關閉 SMT 以防堵漏洞,這導致性能損失高達 30%,並影響了後續 Intel 的處理器設計決策。

NVIDIA 採用 SMT 就不會有安全疑慮嗎?

來源指出,Intel 決定在 Diamond Rapids 移除 SMT 是因為其核心設計受 Spectre/Meltdown 的影響根本上比 AMD 更嚴重。NVIDIA 在 2026 年的 Vera CPU(Olympus 核心) 中選擇採用 SMT,是為了大幅提升總吞吐量(每核心可支援 2 個執行緒,總計 176 執行緒),並聲稱性能比前代提升 2 倍。來源未明確提到 NVIDIA 是否完全免於安全問題,但暗示透過「自研核心」而非使用標準 Neoverse 核心,NVIDIA 試圖在解決性能瓶頸的同時提升性能。事實上,Intel 也已意識到移除 SMT 是一個錯誤,並計畫在 2028 年後的 Coral Rapids 重新引入 SMT。

哪些 CPU 已經或預計採用 SMT?

- AMD:長期採用 SMT。最新的 Venice 與未來的 Florence 預計將持續使用此技術。

- Intel:

- 目前/已採用:傳統的 Xeon 系列。

- 移除中:針對 2026 年的 Diamond Rapids(P-core)決定移除 SMT 以節省面積並規避安全隱憂。

- 未來預計重新採用:預計在 2028/2029 年的 Coral Rapids 回歸 SMT。

- NVIDIA:2026 年的 Vera CPU(Olympus 核心)將支援 SMT(88 核心/176 執行緒)。

- 華為(Huawei):

- Kunpeng 920B:已支援 SMT(80 核心/160 執行緒)。

- Kunpeng 950:2026 年產品,將支援 SMT(192 核心/384 執行緒)。

- Kunpeng 960:2028 年產品,高性價比型號預計也將支援 SMT。

- 其他 Arm 業者:多數基於 Arm Neoverse(如 Graviton 5、Cobalt 200)的設計通常採單核心單執行緒,但 NVIDIA 與華為的例子顯示,轉向「自研核心」後,支援 SMT 已成為提升效能的趨勢。

SemiAnalysis 認為 Intel 在 Diamond Rapids 中決定移除 SMT(同步多執行緒)是一個嚴重的失策,這將使 Intel 在面對支援 SMT 並具備高 IPC 的 AMD Venice 時,在總吞吐量與競爭力上處於劣勢。

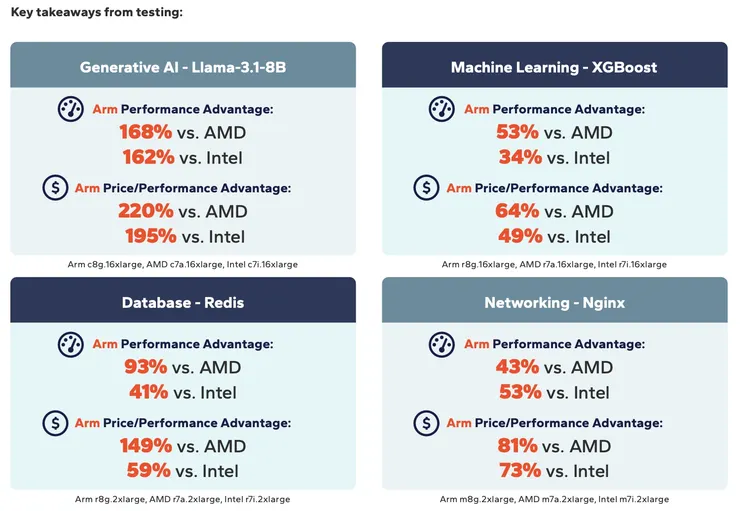

Arm 效能好

根據 Signal65 於 2025 年 8 月發布的實驗室洞察報告,該報告旨在分析基於 Arm Neoverse 架構的 AWS Graviton4 在 AWS 雲端環境中的效能與成本效率表現,並重點比較 AWS Graviton4,與最新一代 AMD 與 Intel 架構之 AWS EC2 實例之間的差異。

Signal65 針對四種具代表性的現實場景進行了測試,包括:生成式 AI(Generative AI)、資料庫(Database)、機器學習(Machine Learning)和網頁伺服器(Networking)。測試結果顯示,Graviton4 在所有測試項目中皆優於 AMD 和 Intel。

參考資料

- 林啟維|OpenClaw 安裝部署教學:硬體如何挑選?只能裝在 Mac?完整攻略一次看|經理人

- hsu hsiang|AI Chatbot 跟 AI Agent 到底差在哪?一篇文講到你懂,還教你怎麼用!

- Larksuite|OpenClaw 是什麼?2026 完整介紹與安裝教學

- SemiWiki|Arm vs x86 Server CPU Market share, per Mercury Research

- DIGITIMES|英特爾 CFO 與超微蘇姿丰同聲預示 AI 資料中心 CPU 需求強勁回歸

- DIGITIMES|超微蘇姿丰拋震撼彈 伺服器 CPU 需求爆表、供應鏈跟不上訂單增速

- DIGITIMES|評析:代理式 AI 驅動 CPU 時刻降臨 產能規劃不足卻拉警報

- Staff Writer|Supply crunch in Intel, AMD CPUs deals fresh blow to PC and server makers

- Jowi Morales|Intel, AMD server CPUs reportedly suffering from supply shortages in China

- 群聯電子 Phison Electronics|Facebook 粉絲專頁

- Artificial Analysis|Gemini 3 Flash Reasoning 定價

- Counterpoint Research|Arm-based CPUs to Capture 90% of AI ASIC Server CPU Market by 2029

- Richard 只談基本面 - Richard's Research Blog|Facebook 粉絲專頁(相關貼文)

- SemiAnalysis|CPUs Are Back: The Datacenter CPU

- Phoronix|AMD EPYC vs. Intel Xeon Benchmarks

- Signal65|Arm Neoverse Enables Leading Cloud Performance and Cost Efficiency with AWS Graviton4

- Works on WoA|Windows on Arm 原生軟體清單

- IDC、Omdia、Bloomberg:市占率與市場規模統計