我想要一天分享一點「LLM從底層堆疊的技術」,並且每篇文章長度控制在三分鐘以內,讓大家不會壓力太大,但是又能夠每天成長一點。

目前我們已經完成:

- Single-Head Attention 數學說明:AI說書 - 從0開始 - 52

- Multi-Head Attention 數學說明:AI說書 - 從0開始 - 53

- Attention 機制程式說明 - 輸入端:AI說書 - 從0開始 - 53

- Attention 機制程式說明 - Query 端:AI說書 - 從0開始 - 54

- Attention 機制程式說明 - Key 端:AI說書 - 從0開始 - 54

- Attention 機制程式說明 - Value 端:AI說書 - 從0開始 - 55

- Attention 機制程式說明 - Query 、 Key 、 Value 結果:AI說書 - 從0開始 - 56

- Attention 機制程式說明 - Attention Score 計算:AI說書 - 從0開始 - 57

- Attention 機制程式說明 - Attention Score 正規化計算:AI說書 - 從0開始 - 58

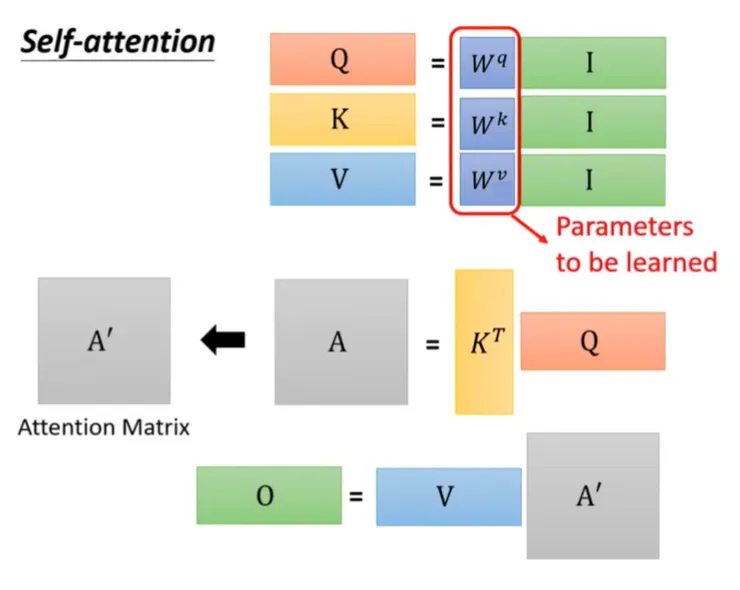

接著回顧 AI說書 - 從0開始 - 52 :

- 我們已經在 AI說書 - 從0開始 - 57 得到:

V = [ 1 2 2

2 8 6

3 0 3 ]

- 然後在 AI說書 - 從0開始 - 58 得到:

A' = [0.063 6.033e-06 2.953e-04

0.468 9.820e-01 8.805e-01

0.468 1.798e-02 1.191e-01]

僅需再執行 :

O = V @ A'