我想要一天分享一點「LLM從底層堆疊的技術」,並且每篇文章長度控制在三分鐘以內,讓大家不會壓力太大,但是又能夠每天成長一點。

在 AI說書 - 從0開始 - 74 中提到,我們想要建立「Transformer 數學」與「ChatGPT 產生的文字」兩者間的關係。

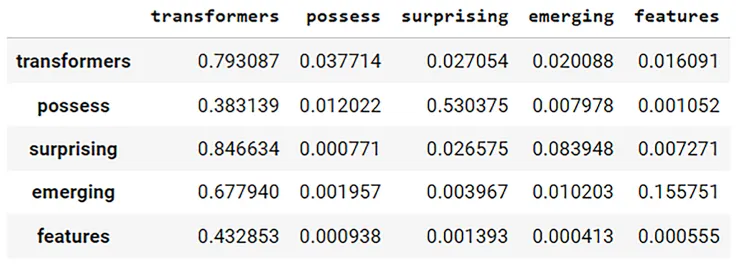

有鑑於此,我們以句子「 Transformers possess surprising emerging features 」為說明例子。

稍後提到的分數 Score ,代表 Multi-Head Attention 執行正規化後的分數 (使用 Softmax),此具機率意涵,而尚未執行此分數與向量 V 線性組合的階段,具體 Transformer 的運作細節見 AI說書 - 從0開始 - 52 。

我們來看看 Transformer 中的第一個 Layer 中的第一個 Head 的分數為何,其如:

圖片出自書籍:Transformers for Natural Language Processing and Computer Vision, Denis Rothman, 2024