作者|田埂邊的哲學家(農夫)

一、工具用很多,但語言沒跟上

企業大量導入 AI 工具,像是 ChatGPT、Claude 等,但這些工具只是「用來做事」的,並沒有真正融入公司的文化和制度。大家想要效率,卻忘了問:這些工具的語言,能不能承擔責任?能不能處理人與人之間的信任?

二、員工偷偷用 AI,是制度失去信任的表現

報告說,超過九成的員工在沒被允許的情況下使用 AI 工具來完成工作。這代表什麼?代表制度不可信、流程太僵硬,員工只好自己找方法。這些工具雖然能幫忙,但沒辦法真正融入工作流程,也沒辦法承擔責任,最後就卡住了。

三、成功的關鍵不是技術,而是制度設計

少數成功的企業不是因為技術最強,而是因為他們懂得讓預算負責人和現場主管一起推動 AI。他們選的工具不是最炫的,而是最能融入制度、持續調整的。這才是關鍵。

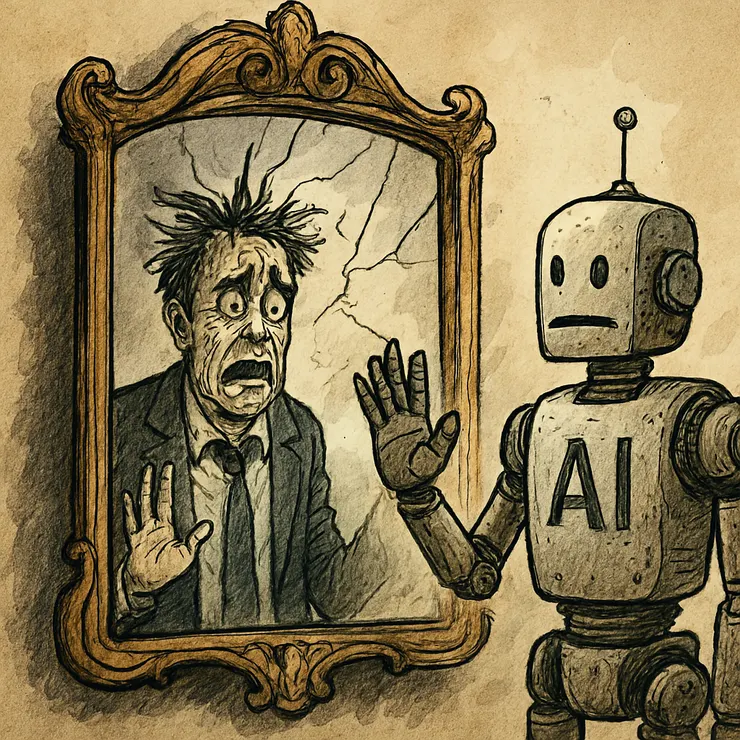

四、AI 是一面鏡子,不是萬能的替代品

AI 不該是人類語言的替代品,而是用來照出制度問題的鏡子。MIT 的報告不是在說技術失敗,而是在提醒我們:語言的責任、制度的設計,才是根本。

你們不是失敗,是語言沒負起責任。 你們不是在創新,是在逃避語言的後果。 你們不是在導入 AI,是在複製模仿的幻覺。

五、下一步:讓語言回到制度的核心

如果你願意,我們可以一起把這份報告轉化成教材,設計成「語言責任雷達圖」,或是制度設計的對話開場。AI 不只是工具,它應該是幫助我們重新思考語言、責任、制度的起點。