【AI鍊魂】第一階段|第6回|技術解決主義陷阱——過度依賴與自我麻痺

Stage 1:認識自我與AI(自我覺察)

主題:理解自我與AI互動現況核心概念:自我覺察、偏見辨識、情緒察覺、資訊批判

1. AI技術全景概述——認識自我與科技共生

2. AI塑造知覺與決策——認知偏差與資訊過濾

3. 有害AI觀盤點——恐懼、焦慮與過度依賴

4. 有益AI觀盤點——效率、創造力與能力增強

5. 自我情緒與AI互動——察覺焦慮、依賴與自我效能

6. 技術解決主義陷阱——過度依賴與自我麻痺

7. 中立神話與責任錯位——AI非中立的真相

8. AI與個人價值觀——衝突、協調與選擇權

9. 自我認識練習——AI互動下的角色映射

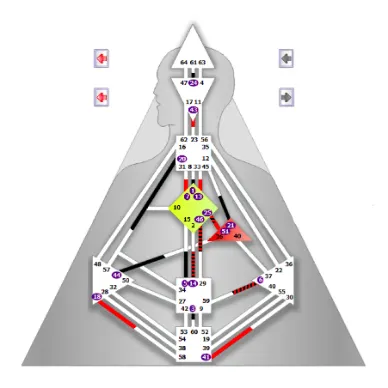

10. 小結—認識自我全景圖——AI互動的自我覺察整合

第一階段|第六回

技術解決主義陷阱——過度依賴與自我麻痺

🌌 前言:當工具變成幻象

AI 的高速進展,常讓人誤以為「只要有技術,就能解決一切」。

這種心態,被稱為 技術解決主義(Techno-solutionism)。

它表面上帶來安全感,因為我們似乎不再需要承擔不確定性;

但在更深的層面,它可能使我們漸漸失去 思考的肌肉,交出判斷與責任。

伊凡·伊利奇早已提醒過:

一旦工具不再受人掌握,而是反過來支配人,我們就會被馴化。

AI 正是這樣的一面鏡子

——反映出我們的焦慮、依賴,以及對失敗的恐懼。

鍊魂式思考邀請我們停下來問:

👉 我是在用技術,還是被技術牽著走?

👉 我是因為信任自己而用AI,還是因為不信任自己才依賴它?

唯有透過覺察與責任的回收,我們才能避免在幻象中沉睡,並清醒地成為工具的主人。

一、技術解決主義的心理機制 🌀

- 信任過度

面對複雜問題,人們傾向將答案交給AI。這是一種「心理懶惰」:因為AI快速、準確,看似讓我們省去思考負擔。但長期依賴,會讓自主分析與判斷力逐漸退化。 - 責任外包

當問題出現時,以後可能會常聽見一句話:「因為AI這麼說的。」這種「責任外包」讓人避免自我反思,卻同時失去了成長與承擔的契機。這與心理學的「歸因理論」相呼應——人類傾向將失敗歸咎外部,以減少內心不適。 - 控制感幻覺

AI常讓人感覺自己更「掌控全局」,但實際上,部分決策權已交出。這種幻覺若不被覺察,會侵蝕我們對自身能力的信心。

📌 案例分析:某企業在投資決策中完全依賴AI模型,初期收益驚人。然而,模型忽略了非量化因素(如地緣政治、倫理風險),最終導致重大虧損。員工因「全權交給AI」而失去即時修正的能力,焦慮與責任迴避隨之加劇。

二、過度依賴的影響 ⚠️

- 認知下降

過度依賴AI,會削弱批判思維與獨立判斷。久而久之,人可能忽略直覺與經驗智慧,而只剩「接受答案」的習慣。 - 心理依賴

當面對AI未覆蓋的領域,人可能陷入無助,缺乏即時決策力。心理學研究指出,這種「依賴式學習」會降低人類的適應力與創新力。 - 倫理風險

技術決策 ≠ 倫理正確。當AI建議與價值觀衝突時,若人類無法堅持道德判斷,可能導致嚴重後果。例如,醫療AI若建議放棄昂貴治療,病人是否仍有「人性選擇」的權利?

三、鍊魂式思考視角:覺察與自主調整 🧘

鍊魂式思考的精髓在於「覺察(認識)—分析(確立)—行動(實現)」。

在面對技術解決主義時,策略如下:

1.覺察依賴

記錄:在哪些場景下,我習慣性地讓AI替我決定?當時的情緒是輕鬆、安全,還是不安與焦慮?

2.分析原因

過度依賴的根源可能來自:

- 對失敗的恐懼

- 對效率的追求

- 對自我能力的不信任

3.設計自主行動

- 先行嘗試:先用自己的判斷做決定,再與AI建議對照。

- 責任分界:在重要決策上,標註「AI建議」與「最終判斷人」。

- 批判訓練:練習質疑AI輸出,養成批判性思維。

四、行動練習(鍊魂式思考應用) ✍️

- 依賴行為清單

列出三個過度依賴AI的場合(如寫報告、理財、路線選擇),並標註可能後果(如創造力下降、錯誤決策、失去應變力)。 - 自主決策實驗

選擇一天中一項任務(如安排行程),先完全由自己決策,再比較AI建議。觀察差異與自我效能感的變化。 - 責任界定

在重要決策文件或專案中,明確標註「AI僅供參考,最終決策由人承擔」。這樣能培養責任感與信任邊界。

五、未來心態建構 🌱

- 警覺技術陷阱:理解AI不是萬能解決方案,而是有限工具。

- 強化自主能力:透過練習批判與自我決策,確保人類智慧仍是主體。

- 心理情感升級:將焦慮、依賴轉化為自我成長契機,培養責任感、思辨力與心理韌性。

🎯 本回收穫

完成本回後,你將能:

- 精準辨識自己何時陷入「技術解決主義」與過度依賴的心理模式。

- 運用鍊魂式思考方法,將依賴轉化為自主,養成「先思考、再驗證」的決策習慣。

- 在AI環境中維持批判思維與責任感,強化心理韌性與自我掌控力。

✨ 真正的智慧,不在於把一切交給技術,而在於保有「人作為主體」的清醒與勇氣。