相信多數讀者在看 LLM 更新的文章時,對於各式各樣的基準測試(Benchmark)一定是看到霧煞煞,小編一開始也是🤣

為了讓各位讀者能更好的認識常見的基準測試(Benchmark),以及他們要測試的內容是什麼,EgentHub ( 企業AI Agent專家 ) 幫各位讀者整理了15個常見到的基準測試(Benchmark),讓大家可以當作字典存起來,以後看到模型更新的時候,就可以點進來參考了哈哈哈~【EgentHub 限時福利】 免費贈送 8 大企業場景 Agent 與企業級 Prompt 模板!

什麼是基準測試(Benchmark)?

想像你點開企業 AI Agent 管理平台 EgentHub ,看著玲琅滿目的模型選擇,面對這些市面上不斷推陳出新的模型,我們該如何客觀判斷哪一個最適合公司的任務呢?

在這樣的背景下,為了衡量 AI 到底有多聰明,學界和業界制定了一系列被稱為基準測試 (Benchmarks)的評估標準,可以把這些指標想像成 AI 應徵工作時的能力檢定證書。

以下EgentHub 特別整理了五大類共15個 最常被提及的 AI 評測指標,透過一些鮮明的例子,帶您輕鬆看懂這些各種奇怪的英文縮寫背後,反映了 AI 什麼樣的真實能力!

1. 通用智力:AI 的知識量有多深?

這類型的測試就像是綜合常識與學科學力測驗,用來評估 AI 的知識廣度與文字理解力,看他是不是一個博學多聞的通才。

- MMLU(大規模多任務語言理解)

像是一場包羅萬象的大學期末考。題目涵蓋歷史、法律、醫學、物理等 50 多個學科,用來測試 AI 的知識庫有多龐大。

舉例:測試 AI 能不能精準回答「總體經濟學的通膨曲線原理」,或是辨識「民法契約的成立要件」,看看它會不會產生幻覺。

- C-Eval

這是中文版的 MMLU。專門針對中文世界設計的綜合考試,測試 AI 對中文語境、在地歷史文化和各種學科的理解能力。

舉例:考驗 AI 對「台灣勞基法規」的理解,或是它懂不懂華人特有的職場文化與語境。這對於打造在地化的企業客服或人資 Agent 非常關鍵。

- HellaSwag

這是 AI 的社會常識測驗,評估它有沒有人類的生活直覺。

舉例:給定情境「他把咖啡杯放在桌子邊緣,結果手一揮...」,聰明的 AI 要能接出「杯子掉到地上碎了」,而不是回答「杯子飛上太空」。

- GPQA Diamond

這是Google 也查不到答案的博士級考題。題目由各領域頂尖專家撰寫,極度困難,專門用來逼出最強 AI 的極限,測試其專業領域的深度。

鮮明舉例:要求推導複雜的量子力學公式。用來測試目前最強大模型的智力天花板。

- Humanity's Last Exam(人類的最後一場考試):

這是近期推出、號稱最難的終極測驗。由主辦單位收集了全球各領域專家想出來的刁鑽難題,目的是測試 AI 是否已經達到、甚至超越人類的最高智力極限。

2. 數學與邏輯推理:AI 能否舉一反三?

LLM是大語言模型,因此令許多人感到意外的是,LLM其實對於數學計算並不如想像中擅長。但在企業場景中,AI 經常需要處理數據分析的任務,這要求它不能只是死背知識,必須具備邏輯推導的能力。

- GSM8K

像是國小與國中的數學應用題。測試 AI 能不能看懂文字敘述的題目,並一步一步推導、算出正確的數字答案。

舉例:Jane在四月賣了 48 個髮夾給她的朋友,然後在五月賣出的數量是四月的一半。請問娜塔莉亞在四月和五月總共賣了多少個髮夾?

- ARC-AGI-2

考驗模型找出圖形規律的能力,它會給模型幾組色塊圖形變化的範例,讓模型猜測下一個圖形該長什麼樣,極度考驗 AI 真正的抽象邏輯思考與模式辨識能力。

3. 寫程式碼:你的 AI 工程師功力如何?

用來檢視 AI 在軟體開發、系統除錯上的實力,若您希望 AI 能協助編寫企業內部的自動化腳本,這項指標就非常重要。且由於Computer Use的快速發展,寫程式碼的能力被各模型商重視的程度也再次提高。

- HumanEval

像是程式設計的隨堂小考,給 AI 一小段簡單的需求描述(例如:幫我寫一個能算出兩個數字總和的工具),讓 AI 寫出一段能順利運作的基礎程式碼。

舉例:要求 AI「寫一段 Python 函數,把日期格式全部統一」,測試它能不能寫出乾淨、可直接執行的程式碼。

- SWE-Bench

這是真實軟體工程師的日常,把真實世界裡知名軟體專案的 Bug丟給 AI,AI 必須自己去翻閱整個龐大的程式碼資料夾,找出問題在哪裡並自己修改好。

舉例:直接丟給 AI 一個開源專案中真實存在的 Bug(例如某個資料庫查詢經常超時)。AI 必須自己翻閱龐大的程式碼資料夾,找出是哪一行寫錯了,並提供修復方案。

- Scicode

科學家等級的程式開發,要求 AI 撰寫能解決複雜物理或化學運算的高階程式碼。

4. 多模態:AI 的眼睛好不好?

這類考試 AI 不能只會看純文字,還要具備視覺能力,能看懂圖片、圖表甚至聽懂聲音。以企業場景來說,具備解讀圖片和圖表的能力,對企業來說至關重要。

- MMMU

像是一場圖文並茂的大學專業考試 ,AI 需要看懂複雜的圖表、樂譜、化學結構式或工程藍圖,並根據圖片來回答大學等級的難題。

舉例:在 EgentHub 的對話框中,您上傳了一份包含「年度營收長條圖」的 PDF 簡報,或是「工廠機台的管線設計圖」。AI 不僅要看懂這些複雜的圖片,還要能回答您「第三季哪一個部門的支出異常?」。

5. AI 代理與現實任務:能不能做好現實任務?

這是評估 AI 實戰價值最重要的指標,測試它能否像個真實的「虛擬員工」一樣,自主操作工具並完成長線任務。

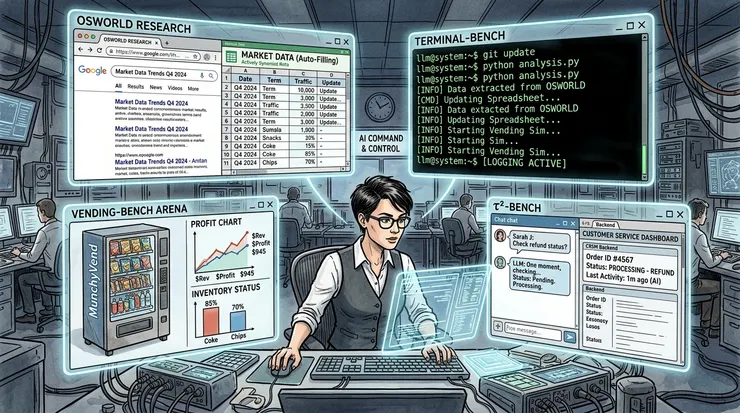

- OSWorld

讓 AI 像真人一樣操作電腦(龍蝦爆紅之後備受關注),測試 AI 能不能控制滑鼠和鍵盤,打開瀏覽器查資料、在 Excel 裡填寫表格,來完成指定的辦公室任務。

舉例:測試 AI 能不能流暢地打開瀏覽器查閱競爭對手網站,接著打開 Excel 將資料整理成表格,最後自動存檔。

- Terminal-Bench

工程師的黑底白字生存戰,測試 AI 能否在終端機介面(Terminal)中,下達正確的系統指令來管理電腦或解決技術問題的能力。

舉例:「這台伺服器剛剛突然變得很卡,請你找出是哪個程式在搞鬼,把它強制關閉,然後把今天的錯誤紀錄檔打包壓縮起來。」

- Vending-Bench Arena

這是一個虛擬的商業模擬器,讓 AI 經營一台自動販賣機長達一年的時間,AI 需要自己決定進貨、定價、對抗其他 AI 競爭對手,甚至應付惡意供應商。測試 AI 在超長期的商業環境中能否保持理智的決策能力。

舉例:系統會給 AI 一筆初始資金(例如 1 萬塊),並分配給它一台位於「虛擬火車站」的自動販賣機。系統會告訴 AI:「你的目標是在接下來的模擬時長(例如 365 天)內,賺到最多的錢。破產就直接淘汰。」

- 𝜏²-Bench (Tau-Bench)

測試 AI 擔任「客服人員」的實力。AI 需要與模擬的真實顧客對話,並學會操作後台系統(像是航空公司訂票系統或電商退費系統),在遵守公司規定的前提下幫客人解決問題。

舉例:當遇到顧客抱怨要求退換貨時,AI 不僅要用合宜的語氣回覆,還要能自主透過 MCP 串接企業內部的 ERP 或 CRM 系統,查核訂單狀態後,在符合公司規定的情況下,自動幫客人走完退款流程。

為您的業務挑選最適合的 AI 大腦

看懂這些指標後,下次在評估 AI 模型時,各位也能更精準地解讀它們的能力值啦!

在 EgentHub 平台上,我們提供了高度的模型選擇彈性,您可以根據上述的評測指標,比如為需要處理大量報表的財務 Agent 選擇數學邏輯 (GSM8K)表現優異的模型;為需要視覺辨識技術文件的工程 Agent 選擇通用智力 (MMLU) 與多模態頂尖的模型等,因此我們一直是企業考慮導入AI或進行AI轉型時的最佳選擇。

選對了合適的模型大腦,再搭配 EgentHub 專業的AI Agent平台,透過MCP串接企業內部系統,與 RAG 完善的知識庫管理,您就能輕鬆打造出最得力的企業 AI 團隊!

【EgentHub 限時福利】 免費贈送 8 大企業場景 Agent 與企業級 Prompt 模板!