我想要一天分享一點「LLM從底層堆疊的技術」,並且每篇文章長度控制在三分鐘以內,讓大家不會壓力太大,但是又能夠每天成長一點。

Vaswani 等人 2017 年解決了設計 Transformer 時最困難的 NLP 問題之一,對於我們人機智慧設計師來說,機器翻譯的人類基準似乎遙不可及,然而,這並沒有阻止 Vaswani 等人的腳步,2017 發布了 Transformer 的架構並取得了最先進的 Bilingual Evaluation Understudy (BLEU) 結果。

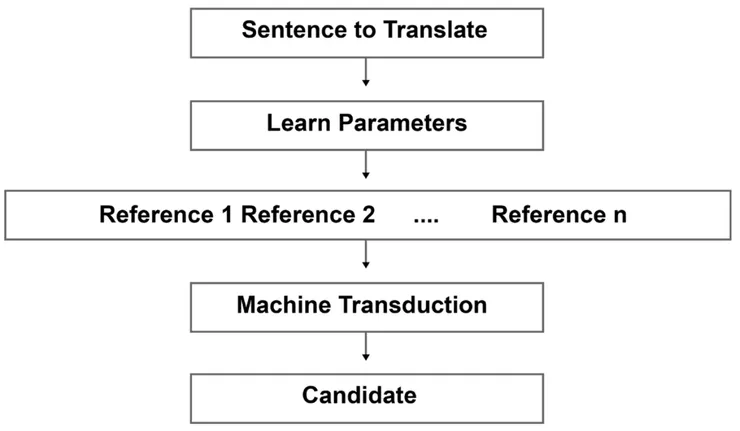

機器翻譯 (Machine Translation) 是指通過機器轉換和輸出來再現人工翻譯的過程,機器翻譯流程如下圖所示:

圖片出自書籍:Transformers for Natural Language Processing and Computer Vision, 2024

各個方框的依序說明如下:

- 選擇一個句子來翻譯

- 學習單詞之間如何通過數億個參數相互關聯

- 學習單詞之間相互查閱的多種方式

- 使用 Machine Transduction 將學到的參數應用到新序列中

- 選擇一個單詞或序列的候選翻譯

該過程總是從需要翻譯的源語言 A 的句子開始,過程的最後是輸出包含目標語言 B 的翻譯句子,中間的計算涉及轉換過程。

例如,歐洲議會的一名口譯員不會逐字逐句地翻譯一句話,逐字翻譯通常沒有意義,因為它們缺乏正確的語法結構,無法產生正確的翻譯,因為忽略了每個單詞的上下文。Human Transduction 將語言 A 中的一個句子建構成句子意義的認知表徵。歐洲議會的口譯員(口頭翻譯)或翻譯員(書面翻譯)只會將該轉換轉化為語言 B 中該句子的解釋。我們將口譯員或翻譯員在語言 B 中完成的翻譯稱為參考句子 (Reference Sentence)。

在現實生活中,人類翻譯員不會將句子 A 多次翻譯成句子 B,而僅會翻譯一次,然而,在現實生活中可能會有多位翻譯員將句子 A 翻譯成句子 B,例如,你可以找到多個翻譯員將蒙田的《隨筆》的法文版本翻譯成英文,如果從原始的法文版本中選取一個句子 A,你會發現多個句子 B 的版本,分別標註為參考 1 到 n。

如果有一天你去歐洲議會,你可能會注意到口譯員只會進行有限時間翻譯,例如兩個小時,然後,另一個口譯員接替繼續,沒有兩個口譯員有相同的風格,就像作家有不同的風格一樣,例如,源語言中的句子 A 可能會由同一人在一天內多次重複,但被翻譯成多個參考句子 B 的版本,機器必須找到一種與人類翻譯員思考相同的方式。