我想要一天分享一點「LLM從底層堆疊的技術」,並且每篇文章長度控制在三分鐘以內,讓大家不會壓力太大,但是又能夠每天成長一點。

以下陳述任務 (Task)、模型 (Model)、微調 (Fine-Tuning)、GLUE (General Language Understanding Evaluation) 和 SuperGLUE 等關鍵字間的關係:

- 任務可以是產生訓練模型的預訓練任務

- 同樣的任務可以是另一個模型的下游任務,該模型將對其進行微調

- SuperGLUE 的目標是證明給定的 Natural Language Understanding (NLU) 模型可以透過微調執行多個下游任務

- 多任務模型是證明 Transformer 思考能力的模型

- 任何 Transformer 的強大之處在於它能夠使用預訓練模型執行多項任務,然後將其應用於微調的下游任務

- 原始 Transformer 模型及其變體現在廣泛出現在所有 GLUE 和 SuperGLUE 任務的頂級排名中

回顧 AI說書 - 從0開始 - 87 中說:Wang 等人 2019 年的論文,提供了合理答案的選擇 (Choice of Plausible Answers, COPA) 任務,Transformer 必須選擇問題的最合理的答案,資料集提供了前提,Transformer 模型必須找到最合理的答案。

以下繼續介紹 Wang 等人 2019 年的論文所提出的其他任務:

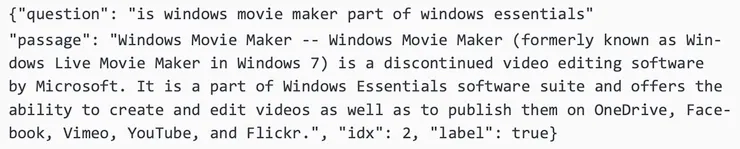

- Boolean Question Task (BoolQ):BoolQ 是 Boolean 是或否回答任務,SuperGLUE 上定義的資料集包含 15942 個自然發生的範例, train.jsonl 資料集第 3 行的原始樣本包含一段文字、一個問題和答案 (true):

圖片出自書籍:Transformers for Natural Language Processing and Computer Vision, 2024

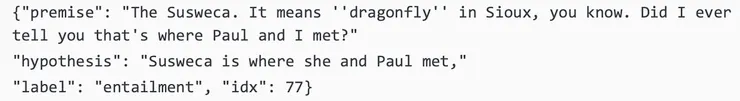

- Commitment Bank (CB):要求 Transformer 模型讀取一個前提,然後檢查基於該前提的假設,例如,假設將證實前提或反駁它,然後,Transformer 必須將假設標記為中性、蘊含或前提的矛盾等,以下範例 77 取自 train.jsonl 訓練資料集:

圖片出自書籍:Transformers for Natural Language Processing and Computer Vision, 2024