我想要一天分享一點「LLM從底層堆疊的技術」,並且每篇文章長度控制在三分鐘以內,讓大家不會壓力太大,但是又能夠每天成長一點。

我們在 AI說書 - 從0開始 - 266 | Transformer 視覺化透過 Dictionary Learning 中,介紹了 Dictionary Learning 的數學原理,其互動式 Transformer 視覺化介面可以參見:https://transformervis.github.io/transformervis/

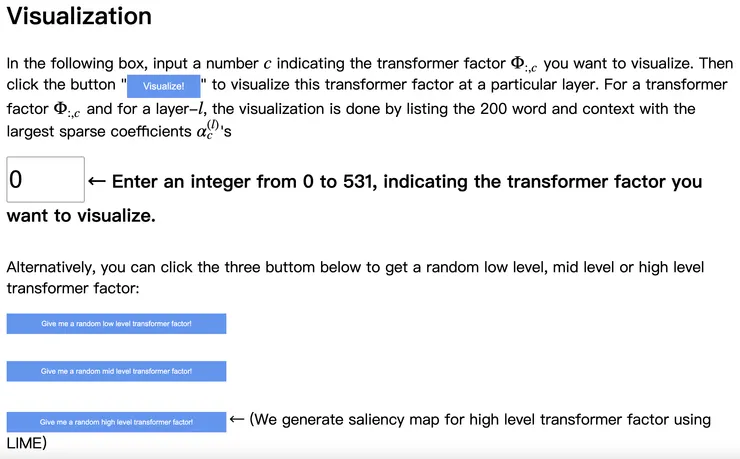

內部有 Layer 參數以及 Dictionary Learning 核心精神:Contextualized Word Embedding Vector Can Also Be Factorized as a Sparse Linear Superposition of a Set of Elementary Elements, Which We Call Transformer factors 的視覺化: