我想要一天分享一點「LLM從底層堆疊的技術」,並且每篇文章長度控制在三分鐘以內,讓大家不會壓力太大,但是又能夠每天成長一點。

Dosovitskiy 等人於 2021 年在其論文標題中概括了他們設計的視覺 Transformer 架構的本質:一張圖像相當於 16 x 16 個單詞:用於大規模圖像識別的 Transformer,論文標題概括了這個過程:圖像可以被轉換為 16 x 16 的小塊,讓我們首先概覽一下 ViT 架構的高層圖,然後再深入程式碼。

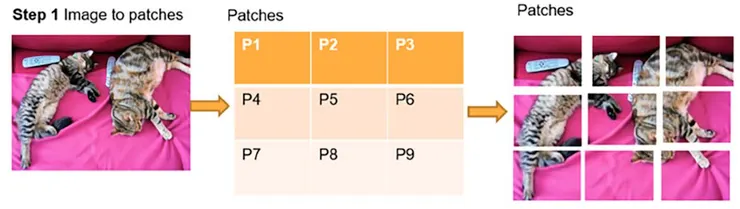

首先,圖像被分割為 n 個塊,如下圖所示,使用特徵提取器進行分割,只要所有塊具有相同的尺寸,如 16 x 16,但不限於此,並沒有規定塊的數量:

具有相同尺寸的塊,現在代表我們序列中的“單詞”,問題在於如何處理這些塊,每種類型的視覺 Transformer 都有其自己的方法,上面的圖像是概念性的,只顯示了九個塊,在接下來的程式範例中,我們將探討一個 224 x 224 像素的圖像,從而生成更多的塊。

Google Research 團隊決定使用將圖像分割後獲得的塊構成的詞彙來形成 16x16 的“單詞”,如下圖所示: