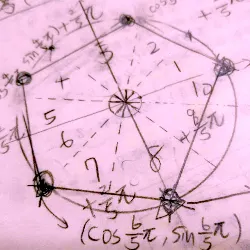

向量內積

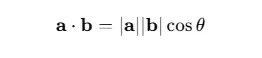

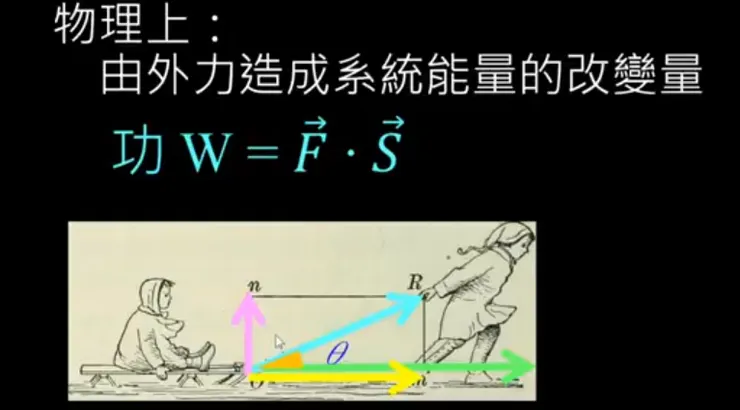

內積公式的兩種寫法,我個人喜歡用國中理化的方式理解:做功

向量內積的意義:

如果 cosθ=1,兩向量方向完全相同,內積等於向量大小的乘積。所以同向

圖片截圖自:https://youtu.be/8tTh-SIhZW0?si=zDDftp6lHIw-MoQF

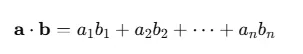

內積的計算方法

內積還可以用分量來計算:

方向導數與梯度的關係

先記住這兩個概念

想像你站在一個山丘上,周圍的地形起伏不平。計算梯度向量先看哪個最陡, 根據向量的長短,再計算該方向的變化速率。

- 生活化比喻:在地圖上梯度可以幫助你找到山坡最陡的上坡路,而方向導數告訴你沿著每個小徑的變化情況。

- 在機器學習:使用梯度下降法(Gradient Descent),我們可以找到函數的最低點(比如最佳模型參數)。

梯度向量(Gradient Vector):

- 表示函數在某一點上,往哪個方向增長最快。

- 梯度向量的大小(模長)代表增長最快時的速率,而方向則是最陡增長的方向。

方向導數(Directional Derivative):

- 表示函數在某一點,沿著某一特定方向的變化速率。

- 如果方向正好與梯度一致,方向導數就等於梯度的大小。

-----------------------------------------------------------------

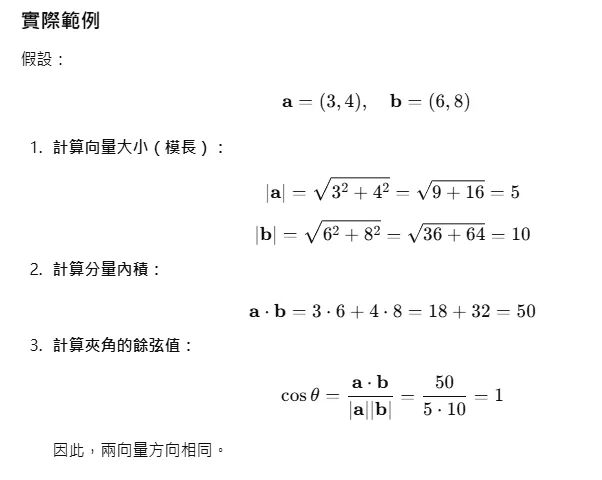

梯度的數學公式

梯度是一個向量,表示函數在每個自變數方向上的偏導數值:

- 再複習偏導數:意思是「函數 f 對 x1的變化速率」,假設其他變數 x2,x3...... 都不變。

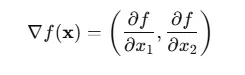

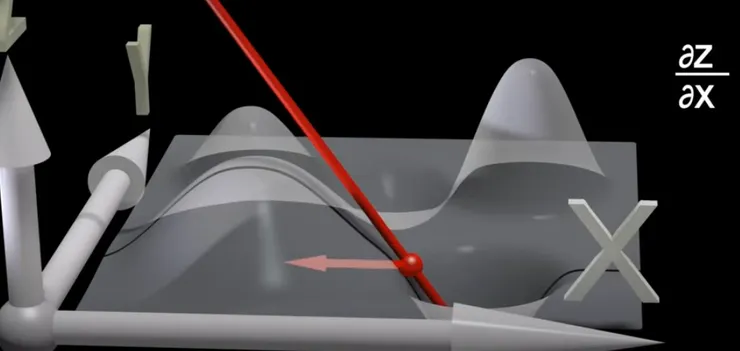

Gradients and Partial Derivatives

以這個圖來說,就是看 Z 在對 Y。

透明的線是梯度

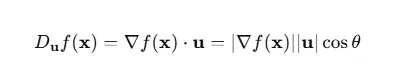

方向導數的數學公式

- u:單位方向向量,表示方向。

- cosθ:梯度方向與給定方向 u 之間的夾角的餘弦值。

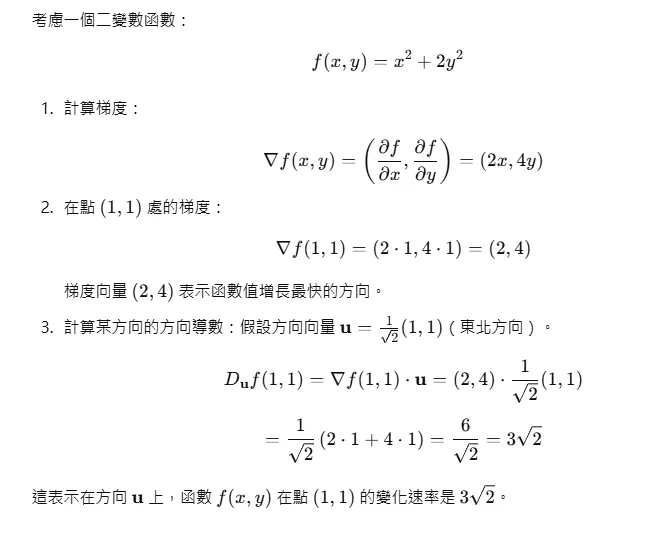

二變數函數是U型 (參考 ChatGPT)

以上是我為學習AI理論前再複習數學觀念的筆記,如有錯誤請不吝指正~