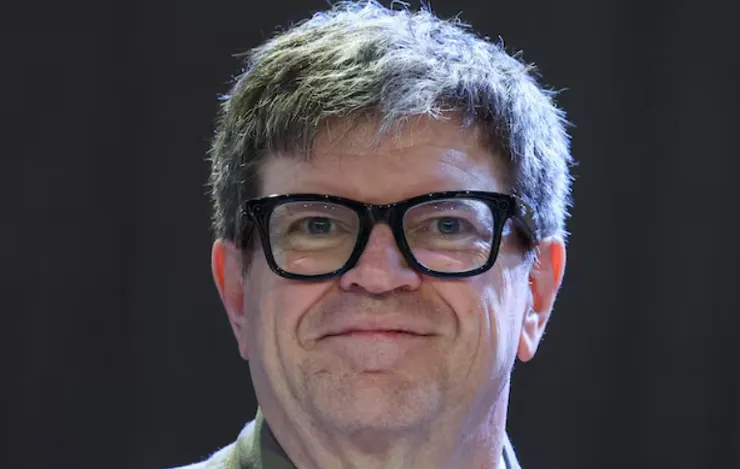

圖片來源:路透社

嗨我是 Mech Muse 👋,如果你平常有在追 ChatGPT、Llama、OpenAI、甚至 AI 股,這件事絕對值得放進你的觀察清單:

👉 深度學習三巨頭之一 Yann LeCun 宣布要離開 Meta,創立一家專注「Advanced Machine Intelligence(AMI)」的新創公司。這篇文章我會帶你搞懂:

- 他離開什麼位置?過去做了哪些事?

- 這次出走是怎麼一步一步發展的?

- AMI 到底在講什麼?跟 LLM 有什麼本質差異?

- 這整件事對產業、使用者與 AI 未來意味着什麼?

那我們直接開始——

深度學習教父離開 Meta,要做 AMI 而不是下一個 LLM 🤖

先把最關鍵的部份講清楚。

根據 Reuters、AP 等多家外媒報導,Yann LeCun 已正式對內宣布:他將在 2025 年底離開 Meta 首席 AI 科學家的職位,成立一家專注 AMI 的 AI 新創。

Meta 也公開證實了這個消息,並強調未來仍會與他的新公司維持研究合作伙伴關係。

LeCun 今年 65 歲,是深度學習領域最重要的三個人之一。2018 年,他與 Geoffrey Hinton、Yoshua Bengio 一起拿下被稱作「電腦界諾貝爾獎」的 圖靈獎,主要貢獻包括:

- 早期的卷積神經網路(CNN)

- 深度學習在影像辨識與實務上的推廣

這些技術今天已是生成式 AI 與電腦視覺的基礎。

他在 2013 年加入 Facebook(後來改名 Meta),創立 FAIR(Facebook AI Research),從早期把深度學習導入推薦系統,到後來的 Llama 開源模型,都有他的影子。

但與 Meta、OpenAI、Google 那種「放大模型、堆算力」的派系不同——

LeCun 一直講得很直接:

LLM 很厲害,但它不是人類級智慧,只是超強自動補字機。

他近年愈來愈強調 AMI(Advanced Machine Intelligence) 的重要性:

要理解世界、具備持久記憶、做分層規劃,有推理能力,並且安全性要內建在架構裡,而不是事後補 patch。

所以如果你問:「他是不是跟 Meta 翻臉?」

其實不是。 這次比較像是:

👉 把他多年想做、Meta 無法全力投入的 AMI 路線,spin-out 成一家獨立新創,全速前進。

從加入 Facebook 到 2025 的轉身:完整時間線整理 📅

如果把這 12 年當成一部紀錄片,時間線可以這樣看:

📌 2013:加入 Facebook,創立 FAIR

當時的 Facebook 想大力投入基礎研究,LeCun 親自帶 FAIR,目標不是做產品,而是拉高整家公司在 AI 的競爭力。

📌 2013–2017:深度學習全面進入 Facebook 系統

這幾年他們帶來的改變包括:

- 更強的影像辨識與內容理解

- 更精準的推薦演算法(FB、IG、Reels 的演算法基礎)

- 早期大規模語言模型、自監督學習的研究成果

這些全都成為 2020 年後 Meta 能穩住競爭力的重要底層技術。

📌 2018:拿下圖靈獎,轉為 Chief AI Scientist

他卸下 FAIR 的日常管理,改成主導技術方向與對外交流,把更多時間投入 AI 長期架構的思考。

📌 2020–2023:LLM 熱潮來臨,他選擇唱反調 🗣️

在全世界都著迷於「模型做大就變聰明」時,他公開提出:

LLM 缺乏世界模型,因此永遠無法真正理解。

同時提出 JEPA、V-JEPA,試著讓 AI 學會物理世界,而不是只學 token。

📌 2024–2025:AMI 路線逐漸成形

他的講座和論文愈來愈聚焦在:

- 世界模型

- 長期記憶

- 分層規劃

- 安全性內建架構

他很明確地把 AMI 定位為「下一代 AI 架構」。

📌 2025/11:傳聞 → 內部 memo → 正式出走

- 11 月初:Financial Times 爆料他正在找投資人籌備新創

- 接著 Bloomberg、WSJ 跟進,指出他開始找團隊

- 11/19(UTC 晚間):Reuters、AP 揭露他已對內宣布離職計畫

Meta 則表示會持續合作。

➜ 這不是衝動離職,而是準備已久的「研究路線拆分」。

AMI 是什麼?為什麼 LeCun 認為 LLM 是「死胡同的一部分」?🧠

這段是本文最重要也是讀者最常困惑的地方——

AMI 到底跟 LLM 有什麼不同?

根據 LeCun 在哈佛、VivaTech 等演講的定義,AMI 有四大核心能力:

1️⃣ 世界模型(World Model)🌍

AI 不能只依靠文字,要能從影像、聲音、環境裡學會:

- 物理規律

- 因果關係

- 物體如何互動

這是現在 LLM 比較做不到的部分。

2️⃣ 持久記憶(Persistent Memory)🧩

LLM 對話斷掉就失憶,AMI 要能:

- 記住長期目標

- 維持內部狀態

- 不因 session 結束就忘記重要資訊

像是在打造更「有持續人格」的智慧。

3️⃣ 推理與分層規劃(Reasoning & Hierarchical Planning)🗺️

不是回答一句漂亮的話,而是能:

- 分解目標

- 管理多步驟任務

- 適應環境變化

這更接近我們期待的「真正會思考」。

4️⃣ 安全與可控(Safety by Design)🔐

不是先做出模型再補安全,而是:

在架構裡就考慮可控性。

那,他為什麼說 LLM 是「死胡同」的一部分?🤨

不是說 LLM 沒用,而是:

- LLM 過度依賴語言世界

- 不具備 內建世界模型

- 推理與規劃能力有限

- 很容易出現 hallucination

- 規模越大、成本越高,但沒有本質性突破

換句話說:

放大 LLM 只能換更順的 ChatGPT,不會換到真正理解世界的 AI。

因此,他的新創很可能會往這些方向走:

- V-JEPA 為基礎的世界模型

- 更貼近真實世界互動(具身 AI、機器人)

- 設計「長期記憶」的架構

- 把推理與規劃當主軸,而非附加功能

這不是「做另一個 ChatGPT」,而是想打造:

👉「會理解、會記住、會自己想辦法達成目標」的 AI。

這場「教父轉身」代表什麼?📝

最後,我們不用把這件事情看成戲劇化的「Meta AI 要出事!」,但它的確值得記上一筆。

1️⃣ 技術路線之爭,從口水戰變成真金白銀的賭注

過去兩年大家都在談:

「LLM 跟世界模型,到底哪條路更有未來?」

LeCun 用自己的職涯直接下注 AMI。

這會迫使整個 AI 產業必須更認真面對這個議題。

2️⃣ 大公司 × 獨立實驗室的模式會更普遍

Meta 選擇:

- 不切割

- 不翻臉

- 反而轉成合作夥伴

這種「spin-out 加速研究」的模式,未來可能會在 Google、OpenAI、Microsoft 都看到。

3️⃣ AI 的戰場會從「模型分數」轉到「架構差異」

未來幾年真正的勝負很可能在:

- 誰先把世界模型整合進產品

- 誰能做出具身 AI 這類高複雜度應用

- 誰能把記憶、推理、規劃做出系統化

如果你是投資人,這類方向可以多留心。

4️⃣ 這是長期觀察的起點

這件事短期內不會帶來新產品,但從歷史角度看,這很可能是未來回頭看時會被框起來的年份:

2025:Yann LeCun 離開 Meta,AMI 時代開場。

接下來可以持續追蹤:

- 新創名字

- 誰投資

- 第一個產品是什麼

- 是否延伸到機器人或具身 AI

- Meta 的角色會更深或更淡?

這些都是值得觀察的指標。

收尾一下 👋

以上,就是這次的整理。

如果你也喜歡這類 AI、大模型、機器人、半導體的分析,

歡迎追蹤我 Mech Muse!

我會持續當你的科技情報導航,下次見~~ 🚀

延伸閱讀:

【Mech系列】 美國人型機器人公司總覽|開場篇:含各公司詳細介紹🤖

【Mech系列】美國小型核能新勢力大揭密:8 大公司完整解析

【Mech 系列】全球機器人補助與政策總覽|各國政策解析方向

【Mech系列】人形機器人核心硬體全解析:從零件開始的下一場科技革命