我想要一天分享一點「LLM從底層堆疊的技術」,並且每篇文章長度控制在三分鐘以內,讓大家不會壓力太大,但是又能夠每天成長一點。

回顧 AI說書 - 從0開始 - 87 說:Wang 等人 2019 年的論文,提供了合理答案的選擇 (Choice of Plausible Answers, COPA) 任務,Transformer 必須選擇問題的最合理的答案,資料集提供了前提,Transformer 模型必須找到最合理的答案。

在 AI說書 - 從0開始 - 88 介紹了:

- Boolean Question Task (BoolQ):BoolQ 是 Boolean 是或否回答任務

- Commitment Bank (CB):要求 Transformer 模型讀取一個前提,然後檢查基於該前提的假設,Transformer 必須將假設標記為中性、蘊含或前提的矛盾等

在 AI說書 - 從0開始 - 89 介紹了:

- Multi-Sentence Reading Comprehension (MultiRC):要求模型閱讀文本並從多個可能的選項中進行選擇,模型包含一段文字、幾個問題以及帶有 0(假)或 1(真)標籤的每個問題的可能答案

在 AI說書 - 從0開始 - 90 介紹了:

- Reading Comprehension with Commonsense Reasoning Dataset (ReCoRD):該資料集包含來自 70000 多篇新聞文章的 120000 多個查詢, Transformer 必須使用常識推理來解決這個問題

以下繼續介紹 Wang 等人 2019 年的論文所提出的其他任務:

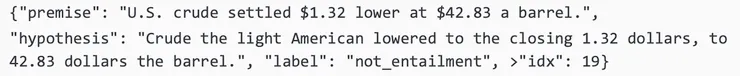

- Recognizing Textual Entailment (RTE):Transformer 模型必須讀取前提、檢查假設並預測蘊涵假設狀態的標籤,看一下 train.jsonl 資料集的樣本 19:

圖片出自書籍:Transformers for Natural Language Processing and Computer Vision, 2024

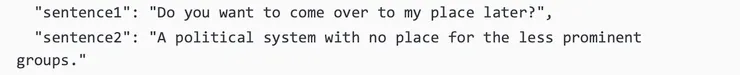

- WiC:測試模型處理歧義單字的能力,在 WiC 中,多任務 Transformer 必須分析兩個句子並確定目標單字在兩個句子中是否具有相同的意思,讓我們看一下 train.jsonl 資料集的第一個樣本:

首先目標字詞先被指定爲:

圖片出自書籍:Transformers for Natural Language Processing and Computer Vision, 2024

然後待判斷的兩個句子為:

圖片出自書籍:Transformers for Natural Language Processing and Computer Vision, 2024

結果為:

圖片出自書籍:Transformers for Natural Language Processing and Computer Vision, 2024