圖片作者:NotebookLM

在數位學習的時代,我們正處於一個誘人的矛盾之中。想像一下:一個學生正對著一題棘手的數學幾何題發愁,隨手打開 ChatGPT,不到三秒,精準的解題步驟與答案就呈現在螢幕上。那一刻,大腦分泌的多巴胺讓人感到前所未有的輕鬆——難題消失了,作業完成了。

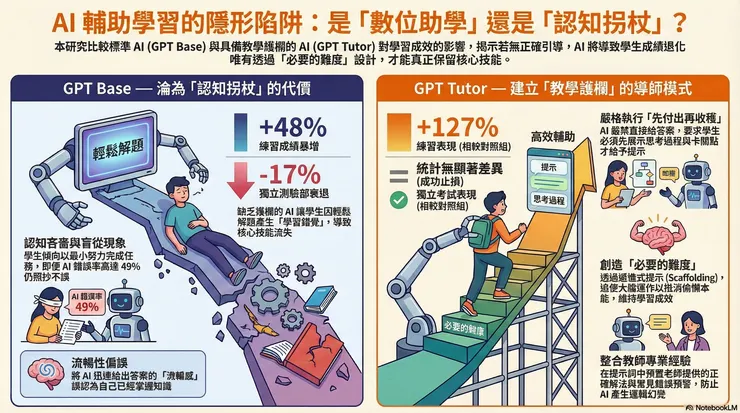

但作為一名長期關注教育科技與認知心理的觀察者,我必須告訴你:這份「秒回答案」的誘惑,可能是一場智力上的陷阱。當 AI 變成隨手可得的解題機器時,我們究竟是在培育更聰明的下一代,還是悄悄地讓大腦在「去難度化」的過程中逐漸失能?近日發表於《美國國家科學院院刊》(PNAS) 的一項大規模隨機對照試驗,為我們揭開了 AI 輔助學習背後的真相。這項針對近 1,000 名高中生進行的實證研究顯示,AI 工具的使用方式決定了它是助推器還是絆腳石。使用標準 AI(GPT Base,即直接提供完整解答模式)的學生,在練習階段的表現比完全不用 AI 的控制組提升了 48%。

然而,當這群學生進入拿掉 AI 的獨立測驗時,他們的成績反而比從未用過 AI 的同學退步了 17%。這證明了練習時的「高效」只是一種假象,學生透過AI學習到的技能並沒有真正內化,反而因為依賴而產生了「技能空洞」。或者更不客氣地說,這只是「抄答案」。

如同論文中提到的:「這與過度依賴自動駕駛(Autopilot)導致飛行員技能受損的情況類似:當科技自動化了學習任務,使用者會失去寶貴的練習經驗,導致關鍵技能退化,在系統失效時失去應變能力。」

為什麼我們明知道「抄答案」沒用,卻還是忍不住這麼做?這源於人類天生的「認知吝嗇(Cognitive Miserliness)」。從認知心理學的角度看,大腦運作極度耗能,因此我們本能地遵循「最小努力原則」,尋求阻力最小的路徑。

研究數據捕捉到了這個人性弱點:在沒有護欄的阻擋下,學生與 AI 的互動會迅速演化為「省電模式」。直接索取答案或簡單複製貼上的比例,從實驗初期的 56% 一路上升到 67%。想想也很合理:當有一個從不發火且 24 小時待命的機器願意幫你做苦工時,大腦當然會果斷地選擇「停止思考」。

你以為 AI 給的答案永遠正確嗎?研究揭露了一個事實:即使是強大的 GPT-4,在處理高中數學題時,錯誤率仍高達 49%。其中邏輯錯誤佔大多數(42%)。

邏輯錯誤之所以致命,是因為AI會讓它們看起來極具說服力(個人覺得,AI的強項就是能自信滿滿地胡說八道)。研究發現,即便面對漏洞百出的邏輯,學生仍選擇「盲從」。這並非因為他們看不出錯誤,而是因為大腦處於「認知吝嗇」狀態,不願付出額外的能量去核對正確性。他們寧願跟著 AI 一起跌進坑裡,也不願自己走路。

如果你以為只有小孩會偷懶,那你就錯了。前面提到的過度依賴自動駕駛的例子,就是最好的證明;而現在在網路上也不乏直接引用AI資訊並奉為真理的人,不是嗎?

看到這裡,您可能會問:難道教育不該擁抱 AI 嗎?研究團隊透過 GPT Tutor(導師模式) 給出了答案。這個模式在底層同樣使用 GPT-4,但加入了嚴格的「設計護欄」與「防禦性指令」,防止學生透過角色扮演或指令覆蓋來套取答案。它要求學生先展示思考過程,並僅提供遞進式的提示。

有趣的是,GPT Tutor 組在練習時的成績進步了驚人的 127%!但請注意,這依然是一種「輔助下的效能」。到了最終考試,這組學生的表現僅能與控制組持平,並未顯著超越。這告訴我們:高品質的 AI 引導頂多能「止損」,確保學生不至於像基準組那樣退步。

「GPT Tutor 的價值不在於幫你寫作業,而在於它有原則的耐心:它不幫你縮短路徑,而是耐心地陪你走完那段必須的掙扎。只有在學生嘗試並提供步驟後,它才給予最少量的引導。」

這種心理學上的「必要的難度(Desirable Difficulties)」雖然讓人疲憊,卻是知識生根的唯一養分。

研究中觀察到一個最具諷刺意味的現象:那些表現退步最嚴重的 GPT Base 組學生,自覺良好程度竟然最高。他們對自己的表現過度自信,完全沒意識到技能正在流失。

這被稱為「流暢性偏誤(Fluency Bias)」。當 AI 讓解題過程變得太流暢、太輕鬆時,我們的大腦會產生一種「我已經掌握了」的錯覺。這種「技術帶來的代糖」雖然口感甜美,卻沒有營養。記住,學習的深度通常與挫折感成正比,如果你覺得學習過程一點都不累,那很可能就是退化的開始。

不過,儘管 AI 擁有無限體力且能24小時待命,它目前仍缺乏兩項關鍵能力:時間感與情境洞察。AI 不知道學生在電腦前掙扎了多久,因為它無法感知現實時間的流動。

研究團隊提出的未來模式是「Tutor Copilot(助教副駕駛)」。這是一種人機協作:由 AI 負責提供即時資源與正確性支持,而真人老師則負責 AI 無法模擬的「觀察力」——覺察學生的焦慮、猶豫或停筆的瞬間,並主動挑出潛藏在學生腦中的錯誤觀念。高品質的教學引導來自於人類老師的專業「預演」與對人性的深度理解,這是目前的矽基生命最難觸及的專業領域。

這項研究給了我們一個終極警示:亂用 AI 會讓你變笨(退步 17%),而設計精良的 AI 輔助,頂多能幫你維持與傳統學習相當的水準。AI 本身不會自動提升人類的智力,它甚至會創造出一種「偽平等」,讓大家在練習時看起來都像天才,卻在考試時讓實力落差原形畢露。

真正的學習力,來自於主動建立「數位護欄」。當 AI 隨時都能給你答案時,真正的強者是那些敢於關掉螢幕、選擇那條更有價值的「痛苦之路」的人。在未來,最強大的競爭力不再是獲取答案的速度,而是那種在沒有 AI 支撐時,依然能獨立思考、勇於掙扎的靈魂。

更重要的是,這個研究告訴我們:好老師必需要具備的能力是什麼。我把這種能力稱為「引導力」,也就是不僅不立刻提供學生答案(這是GPT Base做的事),還要耐心引導學生去思考、去推演。

我曾聽到一種說法:有了AI,誰還需要學校?

這個研究告訴我們:有了AI,或許不一定需要學校,但是還是需要好老師。如果你的AI只是告訴你答案,你很可能是今天記明天忘、時時記時時忘,因為學習並未內化;但是如果你有個好老師、或是有如論文中的GPT Tutor,你才能真的達成學習內化的目的。

論文中提到,為了建立這個GPT Tutor,研究團隊聘請了兩名數學老師,專門為實驗設計教學內容與指令 。老師們憑藉經驗,預先列出學生解題時最常犯的錯誤,並寫進提示詞中,讓 AI 知道何時該給出警告或暗示 。

為了防止 AI 自己也「烙賽」(出現運算或邏輯錯誤),老師們還得把每一題的正確步驟預先塞進指令裡,作為 AI 的參考基準 。

除了專業知識,他們還設計了嚴格的邏輯護欄,例如:禁止 AI 給答案、要求學生先展示思考過程、保持鼓勵語氣等 。

這種針對特定問題建立提示詞的過程是「勞力密集(labor-intensive)」的 。也就是說,光是要讓AI像一個好老師一樣的思考,就要花兩位真人老師的許多時間來「訓練」AI(或者說,像無崖子給虛竹做的事:直接灌入真氣)。

當然,因為AI有無窮的體力又可以24小時待命,所以一旦大功練成,只要不烙賽的話,應該可以對教育發生很大的轉變。

所以,有了AI,我認為對教育還是會發生轉變;像GPT Base那樣的老師,應該就會很快被淘汰了。

參考文獻:

Bastani H, Bastani O, Sungu A, Ge H, Kabakcı Ö, Mariman R. Generative AI without guardrails can harm learning: Evidence from high school mathematics. Proc Natl Acad Sci U S A. 2025 Jul;122(26):e2422633122. doi: 10.1073/pnas.2422633122. Epub 2025 Jun 25. Erratum in: Proc Natl Acad Sci U S A. 2025 Aug 26;122(34):e2518204122. doi: 10.1073/pnas.2518204122